Seedance 2.0 리뷰: 기능, 프롬프트, 2026년 대안 총정리

Seedance 2.0 총정리: @ 태그 워크플로, PixVerse 6개 프롬프트, 즉몽·글로벌 접근, V6·Kling·Veo와 비교.

Seedance 2.0은 2026년 2월 초에 출시되어 48시간 만에 X와 Reddit을 장악했습니다. 크리에이터들이 공유한 클립은 AI 모델의 결과물이 아니라 전문 스튜디오에서 나온 것처럼 보였습니다. 벤치마크 결과도 이 열풍을 뒷받침했습니다. 텍스트→비디오 ELO 1,269, 이미지→비디오 ELO 1,351을 기록하며 출시 당시 Kling 3.0, Veo 3, Runway Gen-4.5를 앞섰습니다.

두 달이 지난 지금, 열기가 어느 정도 가라앉았습니다. 저희는 수 주에 걸쳐 Seedance 2.0을 다양한 시나리오——시네마틱 장면, 제품 광고, 인물 촬영, 판타지 시퀀스——에서 테스트하고 수백 건의 커뮤니티 게시물을 분석하여, 실제로 작동하는 것과 데모에서만 그럴싸해 보이는 것을 구분했습니다. 이 리뷰에서는 모델이 잘 하는 것, 부족한 것, 실제 사용자들의 평가, 이전 버전 및 경쟁 모델과의 비교, 그리고 지금 바로 테스트할 수 있는 6가지 유스케이스와 프롬프트를 다룹니다.

핵심 요약:

- Seedance 2.0은 최대 12가지 혼합 입력(텍스트, 이미지, 비디오, 오디오)을 지원하며, 최대 2K 해상도에 네이티브 오디오가 포함된 4~15초 클립을 생성합니다.

- 카메라 동작, 캐릭터 일관성, 손/팔다리 렌더링이 Seedance 1.0 대비 눈에 띄게 개선되었습니다.

- 중국 외 지역에서의 접근성은 여전히 문제입니다. 과도한 콘텐츠 심사와 일반 사용자에게 높은 학습 곡선이 주요 불만 사항입니다.

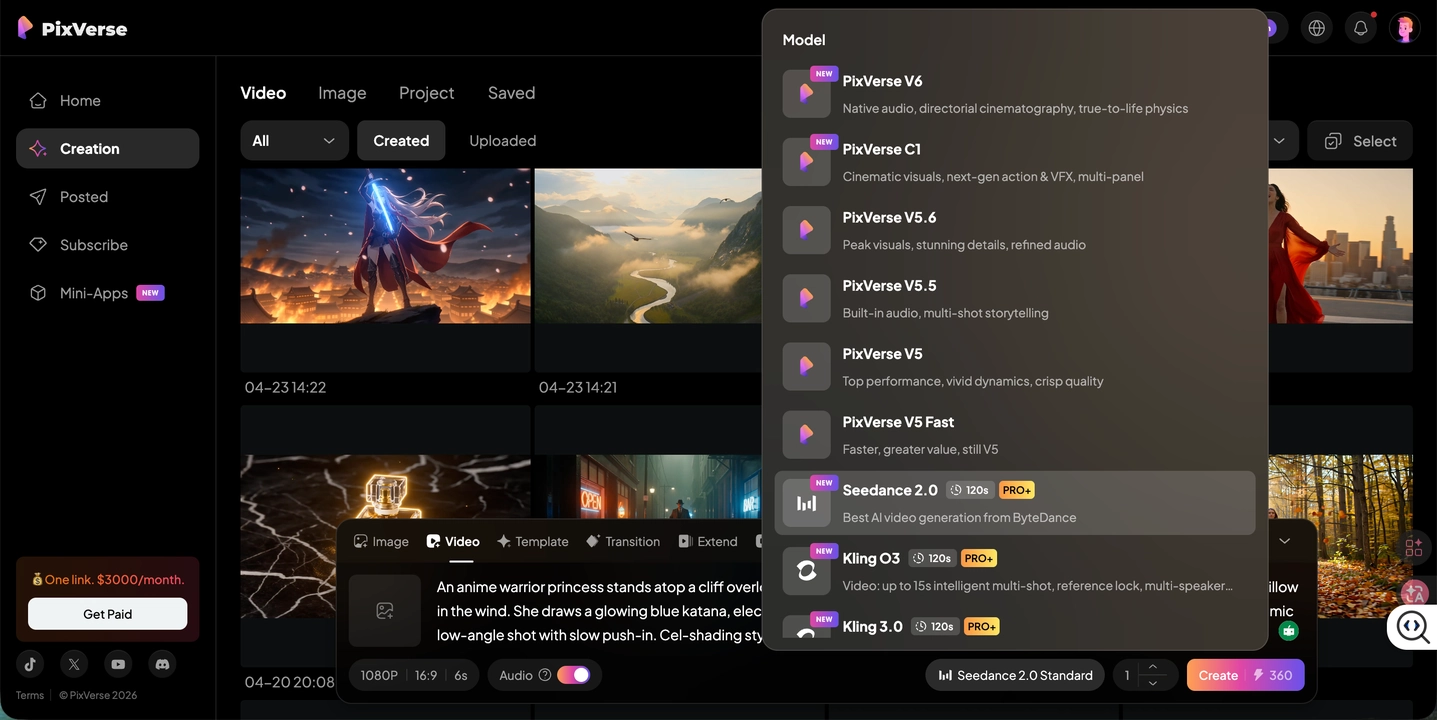

- Seedance 2.0은 이제 PixVerse에서 사용 가능하며, 플랫폼을 전환하지 않고도 PixVerse V6, Kling, Veo 등 다른 모델과 함께 사용해볼 수 있습니다.

Seedance 2.0이란?

Seedance 2.0은 ByteDance가 개발한 멀티모달 AI 비디오 모델입니다. 2026년 2월 7일에 출시되었으며, Seedance 1.0의 점진적 업데이트가 아닌 완전한 재설계 버전입니다.

이전 버전은 텍스트와 이미지를 별도의 파이프라인으로 처리했습니다. Seedance 2.0은 이를 통합 멀티모달 확산 트랜스포머(Unified Multimodal Diffusion Transformer)로 대체하여 텍스트, 이미지, 오디오, 비디오를 공유 표현 공간에 인코딩합니다. 실제로는 텍스트 프롬프트, 캐릭터 참조 사진, 원하는 카메라 이동을 보여주는 비디오 클립, 오디오 트랙을 모두 결합하여 하나의 출력물로 생성할 수 있다는 의미입니다.

모델은 1회 생성당 최대 12개의 참조 에셋을 지원합니다: 이미지 9개, 비디오 3개, 오디오 파일 3개. 프롬프트에서 @ 구문(@image1, @video1 등)으로 태그를 달아 각 참조를 적용할 위치를 정확히 지정할 수 있습니다.

출력 사양: 최대 2K 해상도에서 4~15초 비디오, 네이티브 스테레오 오디오가 영상과 동시에 생성됩니다.

Seedance 2.0의 강점: 잘 하는 것들

멀티모달 입력과 @Reference 시스템

참조 시스템이 핵심 기능입니다. 모든 것을 텍스트로 설명하고 모델이 올바르게 해석하기를 바라는 대신, 원하는 것을 직접 보여줄 수 있습니다. 얼굴 사진을 업로드하고 프롬프트에서 @image1로 태그를 달고, 원하는 카메라 궤적을 보여주는 비디오 클립을 추가하고, 배경 음악 트랙을 포함시킵니다. 모델이 각 참조를 읽고 지정한 위치에 적용합니다.

이는 여러 번 생성에 걸쳐 캐릭터 일관성을 유지하는 데 특히 효과적입니다. 동일한 얼굴 참조를 업로드하면 캐릭터의 외모가 유지됩니다——대부분의 경쟁 모델에서는 아직 우회 방법이 필요한 기능입니다.

시네마틱 카메라 동작

Seedance 2.0은 테스트한 대부분의 모델보다 카메라 움직임을 더 자연스럽게 처리합니다. 트래킹 샷, 푸시인, 슬로 오비트는 무작위가 아닌 부드럽고 의도적인 느낌을 줍니다. 한 Reddit 사용자는 드라마 Severance의 카메라 무브를 “놀랍도록 정확하게” 재현했다고 보고했습니다.

모델은 프롬프트의 구체적인 카메라 언어에 잘 반응합니다. “미디엄 샷에서 클로즈업으로의 슬로우 달리인” 또는 “로우앵글 트래킹 샷”은 예측 가능한 결과를 냅니다. “시네마틱” 같은 모호한 지시로는 제어가 어렵지만 그래도 출력물은 합리적인 수준을 유지합니다.

네이티브 오디오-비디오 동기화

Seedance 2.0은 조인트 확산을 통해 오디오와 비디오를 동시에 생성합니다. 여기에는 다음이 포함됩니다.

- 7개 이상의 언어로 립싱크된 대화

- 화면 동작에 타이밍을 맞춘 효과음

- 시각적 분위기에 맞는 앰비언트 사운드스케이프와 배경 음악

테스트에서 립싱크 품질은 강력했습니다——후반 작업 더빙 도구보다 눈에 띄게 우수합니다. 완벽하지는 않지만 대부분의 경우 별도의 오디오 파이프라인이 필요 없어집니다.

시간적 일관성과 물리적 사실성

캐릭터와 물체는 프레임 간에 형태를 유지하며 깜박임이 최소화됩니다. 손 렌더링——역사적으로 AI 비디오의 약점——은 1.0 대비 상당히 개선되었습니다. 손가락 개수가 올바르게 유지되는 빈도가 높아졌고, 팔다리 움직임이 떠있는 느낌이 아닌 무게감 있게 보입니다.

천의 드레이핑, 물의 거동, 충돌 물리는 모두 더 사실적으로 느껴집니다. 이는 추상적인 비주얼 이외의 모든 콘텐츠에 중요합니다. 제품 광고나 캐릭터 중심의 내러티브를 생성한다면, 믿음직한 물리 표현이 “인상적인 AI 데모”와 “실제 사용 가능한 영상” 사이의 차이를 만듭니다.

멀티샷 스토리텔링

프롬프트를 타임라인으로 구조화할 수 있습니다——0–4s: 넓은 확립 샷, 4–8s: 미디엄 트래킹 샷 등——모델이 각 세그먼트를 일관된 시퀀스로 생성합니다. 캐릭터는 일관성을 유지하고, 샷 간 전환도 어색하지 않고 부드럽습니다.

이는 실질적인 워크플로 전환입니다. 이전 모델은 샷을 개별적으로 생성하고 후반 작업에서 이어 붙여야 했습니다. Seedance 2.0은 시퀀스 처리를 기본으로 지원합니다.

비디오 내 편집

전체 클립을 재생성하지 않고 기존 비디오의 캐릭터나 물체를 교체할 수 있습니다. 캐릭터의 의상을 바꾸거나 배경을 교체해야 할 때, 모델이 대상 요소만 수정하고 나머지는 그대로 유지합니다. 대부분의 경쟁 모델에서는 제공되지 않는 기능으로, 반복 작업 시간을 크게 절약할 수 있습니다.

Seedance 2.0 한눈에 보기

| 사양 | 세부 내용 |

|---|---|

| 개발사 | ByteDance |

| 출시일 | 2026년 2월 7일 |

| 아키텍처 | 통합 멀티모달 확산 트랜스포머 |

| 입력 | 텍스트 + 최대 9개 이미지 + 3개 비디오 + 3개 오디오 파일 |

| 최대 해상도 | 2K |

| 영상 길이 | 4~15초 |

| 네이티브 오디오 | 있음 (대화, 효과음, 앰비언트, 음악) |

| 립싱크 언어 | 7개 이상 |

| 비디오 내 편집 | 있음 (캐릭터/오브젝트 교체) |

Seedance 2.0의 한계

어떤 모델도 트레이드오프 없이 출시되지는 않습니다. 중요한 것들을 살펴보겠습니다.

지역 접근이 제한됩니다. Seedance 2.0은 주로 ByteDance의 중국 생태계(즉몽 앱)를 통해 출시되었습니다. 해외 사용자들은 인증 지연, 지역 잠금, 결제 장벽에 직면합니다. 가장 간단한 해결책은 PixVerse를 통해 접근하는 것으로, 지리적 장벽을 완전히 제거합니다.

콘텐츠 심사가 과도합니다. 여러 사용자들이 문제없는 콘텐츠의 프롬프트가 차단됐다고 보고합니다. 얼굴 관련 생성은 특히 필터를 트리거하기 쉽습니다. 한 Reddit 댓글은 이렇게 요약했습니다: “검열이 Seedance 2.0을 망쳤다.” 일관된 출력이 필요한 상업 크리에이티브 작업에서 실질적인 병목입니다.

학습 곡선이 가파릅니다. 한 문장을 입력하고 비디오를 받기를 원한다면, Seedance 2.0이 가장 쉬운 출발점은 아닙니다. @reference 시스템, 타임라인 프롬프팅, 멀티모달 입력은 강력하지만——배우는 데 시간이 필요합니다. 리뷰어들은 일관되게 전문가에게는 높은 점수(8.5/10), 일반 사용자에게는 낮은 점수(5/10)를 부여합니다.

API는 아직 베타 단계입니다. 안정적인 프로그래매틱 접근이 필요한 기업 팀은 호환성 변경과 속도 제한 이슈에 대비해야 합니다.

비디오 내 텍스트 렌더링이 불안정합니다. 장면에 화면 텍스트——표지판, 타이틀 카드, 제품 라벨——가 포함되면 일관성 없는 결과를 예상해야 합니다. 이는 2026년 대부분의 비디오 모델에 공통된 약점이지만 주목할 만합니다.

LoRA 지원 없음. 커스텀 데이터셋으로 모델을 파인튜닝할 수 없습니다. 기본 모델이 커버하지 못하는 특정 비주얼 스타일이나 브랜드 룩이 필요하다면, 프롬프트 엔지니어링과 참조 이미지에 의존해야 합니다.

클립당 최대 15초. SNS 콘텐츠와 광고에는 충분하지만, 내러티브 작업에는 짧습니다. 멀티샷 프롬프팅이 도움이 되지만, 1회 생성에서 여전히 15초가 상한선입니다.

커뮤니티의 반응

크리에이터 및 전문가 피드백

전문 크리에이터——영화 감독, 뮤직비디오 제작자, 광고 에이전시——가 가장 열성적인 사용자 그룹입니다. 멀티모달 참조 시스템과 타임라인 프롬프팅은 그들이 이미 제작을 생각하는 방식——텍스트 설명이 아니라 샷, 참조, 시퀀스 관점——과 일치합니다.

한 리뷰는 세밀한 제어가 필요한 크리에이티브 전문가들에게 Seedance 2.0을 8.5/10으로 평가했습니다. X의 초기 테스터는 이렇게 말했습니다: “공동 창업자가 이 효과를 내기 위해 하루 종일 시도했습니다. Seedance 2.0은 5분 만에 해냈습니다.”

이 모델은 “감독처럼 생각하는” 것으로 묘사됩니다——프롬프트에 어렴풋이 맞는 것을 생성하는 게 아니라, 샷 레벨의 지시에 반응합니다. 이미 프리프로덕션 워크플로에서 작업하는 팀에게는 의미 있는 전환입니다.

소셜 미디어 및 포럼 반응

Reddit 커뮤니티(r/SeedanceAI_Lab, r/Seedance_v2)는 활발하고 성장하고 있습니다. 가장 많이 공유된 출력물은 일반적인 AI 비디오보다 실사 영상에 더 가까운 시네마틱 클립들입니다.

소셜 미디어의 공통 불만 사항은 저희 조사 결과와 일치합니다: 중국 외 지역에서의 접근 어려움, 심사 오탐지, 프롬프트 시스템을 익히는 데 필요한 시간 투자입니다. 여러 스레드에서 “강력한 카메라를 가지고 있지만 좋은 샷을 찍으려면 수동 모드를 배워야 한다”는 비유가 사용됩니다.

저작권 논란

출시 며칠 만에 디즈니는 ByteDance에 중단 통보서를 보내, Seedance 2.0이 훈련 데이터에서 디즈니 캐릭터를 생성하고 있다고 주장했습니다. 미국 영화협회와 SAG-AFTRA도 공식 성명을 발표했습니다. AI가 생성한 유명인 외모의 바이럴 비디오가 논란을 더욱 키웠습니다.

이는 AI 비디오 분야 전체에서 진행 중인 법적 문제이며, Seedance 2.0만의 문제가 아닙니다. 하지만 인식 가능한 캐릭터나 초상이 포함된 상업 작업에 이 모델을 사용할 계획이라면 지속적으로 주시할 필요가 있습니다.

Seedance 2.0 vs. Seedance 1.0: 무엇이 바뀌었나

1.0에서 2.0으로의 전환은 완전한 아키텍처 재구축입니다. 비교를 살펴보겠습니다.

| 기능 | Seedance 1.0 | Seedance 2.0 |

|---|---|---|

| 아키텍처 | 텍스트와 이미지 별도 파이프라인 | 통합 멀티모달 확산 트랜스포머 |

| 텍스트 입력 | 있음 | 있음 |

| 이미지 입력 | 단일 선택 이미지 | 최대 9개, @tag 제어 포함 |

| 비디오 입력 | 없음 | 최대 3개 참조 비디오 |

| 오디오 입력 | 없음 | 최대 3개 오디오 파일 |

| 네이티브 오디오 출력 | 없음 | 있음 (대화, 효과음, 앰비언트, 음악) |

| 최대 해상도 | 1080p | 2K |

| 영상 길이 | 5~10초 | 4~15초 |

| 멀티샷 | 기본적 | 크로스샷 일관성이 있는 타임라인 스토리보드 |

| 손/팔다리 품질 | 잦은 아티팩트 | 눈에 띄게 개선 |

| 비디오 내 편집 | 없음 | 있음 (캐릭터/오브젝트 교체) |

| 사용 가능한 출력 비율 | ~60% | 첫 시도에서 90% 이상 |

일상 사용에서 가장 큰 두 가지 업그레이드는 네이티브 오디오(1.0에는 없었음)와 멀티모달 참조 시스템(1.0은 단일 선택 이미지에 제한됨)입니다. 1.0을 써보고 넘어갔다면, 2.0은 근본적으로 다른 도구입니다.

Seedance 2.0 유스케이스: 6가지 실측 프롬프트

가장 일반적인 크리에이티브 요구를 커버하는 6가지 시나리오에서 Seedance 2.0을 테스트했습니다. 아래의 각 프롬프트는 바로 복사해서 테스트할 수 있습니다. 각각에 대해 실제로 받은 결과, 소요 시간, 효과적이었던 것과 그렇지 않았던 것을 설명합니다.

별도 언급이 없는 한 모든 테스트는 PixVerse에서 Seedance 2.0 Standard, 720p, 5~8초, 16:9 종횡비로 실행했습니다.

시네마틱 영화 장면

이 프롬프트는 어둡고 고대비 조건에서의 카메라 동작, 분위기, 캐릭터 렌더링을 테스트합니다——모션 아티팩트가 빠르게 드러나는 유형의 장면입니다.

프롬프트:

A retired detective in a long dark coat walks through a rain-soaked alley at night. Neon signs reflect red and blue on the wet cobblestones. He pauses, lights a cigarette, and glances over his shoulder. Slow push-in from wide shot to medium close-up. Film noir style, anamorphic lens flare, teal-orange color grading, film grain.

실제 결과: 카메라 푸시인이 흔들림이나 갑작스러운 점프 없이 부드럽고 안정적이었습니다. 자갈 위의 빗물 반사는 설득력 있었고, 네온 색상이 젖은 표면에 스며드는 방식이 실제와 같았습니다. 형사의 코트는 걸을 때 자연스럽게 움직였고, 담배에 불을 붙이는 동작도 손 왜곡 없이 처리되었습니다. 앰비언트 오디오에는 빗소리와 멀리서 들려오는 도시 소음이 포함되어 장면과 잘 어울렸습니다. Standard 모드에서 약 70초가 걸렸습니다. 전반적으로, 많은 후반 작업 없이 무드 릴이나 단편 영화 피치에 바로 활용할 수 있는 수준의 출력물입니다.

제품 광고

제품 샷은 물리 시뮬레이션의 실용적인 테스트입니다: 빛이 표면에 올바르게 닿는가, 회전이 기계적으로 부드럽게 느껴지는가, 소재가 본래 모습처럼 보이는가?

프롬프트:

A luxury perfume bottle rotates slowly on a black marble surface. Golden liquid catches the light as it turns. Soft particles of gold dust float in the air around it. Macro close-up, slow 360-degree orbit camera. Studio lighting with warm rim light, high-end commercial photography style.

실제 결과: 병 내부의 유리 굴절과 액체 거동이 놀랍도록 정확했습니다. 금색 입자들은 자연스러운 속도로 떠다녔고, 대리석 표면에는 눈에 보이는 그레인 텍스처가 있었습니다. 오비트 카메라는 전체 회전 동안 부드러웠습니다. 빛이 올바른 각도로 유리에 닿아, 실제 스튜디오 세팅에서 기대할 수 있는 코스틱 하이라이트를 만들어냈습니다. 총 생성 시간: 약 65초. 제품 컨셉 비디오의 초안으로는 3D 렌더링 세팅과 비교해 수 시간을 절약할 수 있습니다.

뮤직비디오

뮤직비디오는 풍부한 표현적 움직임, 극적인 조명 변화, 동적인 움직임 속에서 캐릭터의 외모를 유지하는 능력을 요구합니다. 이것이 시간적 일관성이 혹독하게 테스트되는 곳입니다.

프롬프트:

A female singer in a flowing red silk dress performs on a rooftop at sunset. City skyline stretches behind her. Wind blows her hair and dress dramatically. She sings with emotional intensity, arms spread wide. Dynamic tracking shot circling around her. Golden hour backlighting, lens flare, vibrant warm tones.

실제 결과: 드레스 물리가 가장 돋보였습니다——붉은 실크가 절차적이 아닌 물리적으로 보이는 방식으로 바람과 빛 속에서 움직였습니다. 가수 주변을 도는 트래킹 오비트는 유동적이었고, 전체 회전 동안 얼굴의 일관성이 유지되었습니다. 머리카락 움직임은 자연스럽고 드레스의 바람 방향과 일치했습니다——많은 모델들이 틀리는 디테일입니다. 네이티브 오디오가 그녀의 움직임 템포에 맞는 앰비언트 뮤직 트랙을 생성했습니다. 생성: 약 75초. 음악 프로젝트의 무드보드나 컨셉 비디오를 만든다면, 1회 생성으로 80%의 완성도를 얻을 수 있습니다.

움직이는 인물 포트레이트

섬세한 동작은 대부분의 비디오 모델에서 극적인 액션보다 더 어렵습니다. 작은 제스처——머리를 돌리거나, 손으로 물체를 살피는——는 빠르게 움직이는 장면이 숨길 수 있는 시간적 불안정성을 드러냅니다.

프롬프트:

An elderly Japanese craftsman in a traditional wooden workshop, morning light streaming through paper screens. He slowly lifts a hand-forged ceramic tea bowl, examining it with quiet pride. His weathered hands rotate the bowl gently. Close-up of his hands, then slow tilt up to reveal his face. Wabi-sabi aesthetic, warm natural light, documentary portrait quality.

실제 결과: 이것이 테스트에서 가장 강력한 결과 중 하나였습니다. 손——보통 AI 비디오에서 가장 약한 부분——이 올바른 손가락 개수와 자연스러운 관절 움직임으로 클립 전체에서 안정적이었습니다. 손에서 얼굴로의 카메라 틸트는 부드러웠고, 초점 전환이 실제 렌즈 랙처럼 느껴졌습니다. 장지 너머로 들어오는 아침 빛이 부드럽고 균일한 그림자를 만들었습니다. 모델이 자체적으로 작업장의 희미한 앰비언트 사운드를 추가했습니다: 멀리서 들려오는 새소리, 도자기의 부드러운 소리. 풍화된 손의 피부 텍스처가 과도한 샤프닝 없이 사실적으로 보였습니다. 생성: 약 80초. 다큐멘터리 스타일 콘텐츠나 브랜드 스토리텔링에서 이러한 수준의 섬세함이 바로 필요한 것입니다.

자연과 풍경

항공 및 풍경 샷은 대규모 일관성을 테스트합니다: 모델이 수 초에 걸친 이동 카메라를 통해 일관된 환경을 유지할 수 있는가?

프롬프트:

Aerial drone shot gliding over a misty mountain valley at sunrise. Layers of fog roll between emerald green peaks. A winding river reflects the golden morning light below. Eagles soar through the frame at eye level. Smooth forward tracking with slight descent. Epic landscape, volumetric fog, golden hour lighting.

실제 결과: 안개 층이 독립적으로 각각 다른 속도로 움직여, 평평한 매트 페인팅이 아닌 실제 깊이감을 장면에 부여했습니다. 카메라가 전진함에 따라 강의 반사가 올바르게 업데이트되었습니다——모델의 공간 인식이 필요한 디테일입니다. 전체 색상 팔레트——따뜻한 금색이 차가운 블루-그린 산에 닿는——가 잘 처리되었고, 볼류메트릭 포그가 입체적으로 느껴졌습니다. 오디오에는 환경에 맞는 바람 소리와 멀리서 들려오는 새소리가 포함되어 있었습니다. 이 배치에서 가장 빠른 생성이기도 했습니다: 약 55초. 출력물은 여행 비용 없이 전문 드론 촬영에서 얻을 수 있는 것에 가깝습니다.

애니메이션과 판타지

스타일화된 콘텐츠는 포토리얼리즘과 다른 도전입니다. 모델이 믿음직한 움직임을 생성하면서 일관된 아트 스타일(셀 셰이딩, 스피드 라인, 플랫 컬러)을 유지해야 합니다.

프롬프트:

An anime warrior princess stands atop a cliff overlooking a burning medieval city at night. Her long silver hair and crimson cape billow in the wind. She draws a glowing blue katana, electricity crackling along the blade. Cherry blossom petals swirl around her. Dynamic low-angle shot with slow push-in. Cel-shading style, vibrant neon accents, dramatic speed lines.

실제 결과: 셀 셰이딩이 클립 전체에서 일관되게 유지되었습니다——다른 모델에서 흔히 보이는 애니메이션과 포토리얼리스틱 스타일의 혼합이 없었습니다. 검을 뽑는 동작이 유동적이었고, 날을 따라 흐르는 전기 효과가 일반적인 발광 오버레이가 아닌 실제 애니메이션 작품에 속하는 것처럼 보였습니다. 벚꽃 꽃잎이 독립적으로 움직이며 일부는 아래 불타는 도시의 불빛을 받았습니다. 오디오에는 검을 뽑는 동작에 정확히 타이밍을 맞춘 극적인 휘파람 소리가 포함되어 있었습니다. 생성: 약 70초. 스타일 일관성은 AI 생성 애니메이션에서 가장 어려운 부분인데, Seedance 2.0은 테스트한 대부분의 모델보다 더 잘 처리했습니다.

Seedance 2.0 대안: 2026년 최고의 AI 비디오 생성기 비교

Seedance 2.0은 강력한 모델이지만 유일한 선택지가 아닙니다——필요에 따라 최적의 선택이 아닐 수도 있습니다. 주요 대안들을 비교해 보겠습니다.

PixVerse V6 — 그리고 PixVerse에서의 Seedance 2.0

개별 모델을 비교하기 전에, 실질적인 문제를 먼저 다룰 필요가 있습니다: 각 모델은 자체 계정, 가격, 워크플로가 있는 별도의 플랫폼에 존재합니다. 제품 광고에서 Seedance 2.0과 Kling 3.0을 비교 테스트하려면 보통 두 개의 계정과 두 세트의 크레딧이 필요합니다.

PixVerse가 이를 해결합니다. Seedance 2.0은 2026년 4월 13일에 PixVerse에 출시되어, Kling O3, Veo 3.1, Sora 2 등의 모델에 합류했습니다. 하나의 계정, 하나의 크레딧 잔액으로 나란히 비교할 수 있습니다.

PixVerse의 Seedance 2.0은 두 가지 티어로 제공됩니다:

| 티어 | 480p | 720p | 1080p |

|---|---|---|---|

| Standard | 15 크레딧/초 | 30 크레딧/초 | 이용 가능 |

| Fast | 10 크레딧/초 | 20 크레딧/초 | N/A |

720p Standard에서 5초 클립은 150 크레딧. 동일 클립의 Fast는 100 크레딧입니다. Pro, Premium, Ultra 멤버가 Seedance 2.0에 접근할 수 있습니다. Ultra 멤버는 모든 생성에 40% 크레딧 할인을 받습니다.

써드파티 모델 호스팅 외에, PixVerse V6 자체도 강력한 대안입니다. 다른 접근 방식을 취합니다——Seedance 2.0이 멀티 참조 정밀도에서 뛰어난 반면, PixVerse V6는 카메라 제어와 멀티샷 제작에 집중합니다.

| 기능 | PixVerse V6 | Seedance 2.0 |

|---|---|---|

| 최대 길이 | 15초 | 15초 |

| 카메라 제어 | 20개 이상 파라미터화 컨트롤 (달리, 크레인, 오비트, 트래킹) | 프롬프트 기반 설명 |

| 네이티브 오디오 | 있음 | 있음 (7개 이상 언어 립싱크) |

| 입력 유형 | 텍스트 + 이미지; 멀티샷 엔진 | 텍스트 + 9개 이미지 + 3개 비디오 + 3개 오디오 |

| 비디오 내 편집 | 없음 | 있음 |

| 멀티샷 | 네이티브 오디오가 있는 단일 프롬프트 영화 | 타임라인 스토리보드 |

| 접근 방법 | 웹, 모바일, API, CLI | 즉몽(중국) 또는 PixVerse |

| 비용 (1080p, 초당) | 14 크레딧 (~$0.07) | 30 크레딧 Standard (~$0.15) |

V6를 선택해야 할 때: 정밀한 카메라 무브, 개발자 워크플로 CLI 통합(Claude Code, Codex, Cursor와 호환), 또는 제한 없는 글로벌 접근이 필요할 때.

Seedance 2.0을 선택해야 할 때: 멀티 참조 입력 제어, 더 높은 해상도 출력, 또는 비디오 내 편집이 필요할 때.

두 모델 모두 PixVerse에서 이용 가능하므로 하나를 고집할 필요가 없습니다.

Sora 2 (OpenAI)

Sora 2는 내러티브 스토리텔링과 물리 시뮬레이션에서 가장 강합니다. 프롬프트 준수도가 높고, 감정적인 장면——대화 중심의 순간, 섬세한 캐릭터 상호작용——처리가 대부분의 경쟁자보다 우수합니다. ChatGPT Plus ($20/월) 또는 Pro ($200/월) 구독이 필요합니다. API 가격은 해상도에 따라 초당 $0.10~$0.50입니다. 최대 출력: 1080p, 최대 20초.

Veo 3 (Google)

Veo 3는 해상도 챔피언입니다: 60fps 옵션과 공간 오디오가 있는 네이티브 4K 출력. Google Cloud 워크플로에 부드럽게 통합되어 이미 해당 에코시스템에 있는 기업 팀에게 매력적입니다. 트레이드오프는 길이——클립이 8초로 제한되어 내러티브 콘텐츠에서의 유용성이 제한됩니다. Lite 티어 가격은 초당 $0.05부터.

Kling 3.0 (Kuaishou)

Kling 3.0은 클립당 최고의 가치를 제공합니다. 60fps 네이티브 4K, 다국어 립싱크, 그리고 단일 15초 생성에서 최대 6번의 카메라 컷을 처리하는 멀티샷 AI 디렉터. Element Binding이 샷 간에 캐릭터와 오브젝트를 일관되게 유지합니다. 플랜은 월 $10부터. 무료 티어가 있지만 Kling 2.0으로 제한됩니다.

Runway Gen-4.5

Runway는 가장 성숙한 편집 툴킷을 보유하고 있습니다. Motion Brush로 비디오의 특정 영역이 어떻게 움직이는지를 프레임 레벨에서 제어할 수 있습니다. After Effects나 DaVinci Resolve를 사용하는 포스트 프로덕션 파이프라인에서 이미 작업한다면 Runway가 자연스럽게 맞습니다. 단점: 최대 해상도 720p, 10초 클립 제한. API 가격은 초당 약 $0.12.

Hailuo AI (MiniMax)

Hailuo는 속도 옵션입니다. 생성 시간은 클립당 30~90초——이 비교에서 가장 빠릅니다. WorldModelBench 물리 시뮬레이션에서 1위를 기록하며 애니메이션과 스타일화된 콘텐츠를 잘 처리합니다. 최대 해상도는 1080p이지만 클립은 10초로 제한됩니다. 플랜은 월 $9.99부터.

Luma Ray3 (Dream Machine)

Ray3는 전문 포스트 프로덕션을 타겟으로 합니다. HDR이 있는 네이티브 1080p, 색상 그레이딩 파이프라인용 16비트 EXR 프레임 출력, 빠른 프로토타이핑을 위해 5배 빠르고 5배 저렴하게 생성하는 Draft Mode. Modify Video 기능으로 18초까지 연장됩니다. 플랜은 월 $9.99부터.

전체 비교표

| 모델 | 최대 길이 | 네이티브 오디오 | 시작 가격 | 최적 용도 |

|---|---|---|---|---|

| Seedance 2.0 | 15s | 있음 | PixVerse에서 ~150 크레딧/클립 | 멀티 참조 제어, 시네마틱 내러티브 |

| PixVerse V6 | 15s | 있음 | ~70 크레딧/클립 | 카메라 제어, 멀티샷 영화, CLI 워크플로 |

| Sora 2 | 20s | 없음 | $0.10/s | 스토리텔링, 물리 시뮬레이션 |

| Veo 3 | 8s | 있음 (공간) | $0.05/s | 4K 포토리얼리즘, 엔터프라이즈 |

| Kling 3.0 | 15s | 있음 | $10/월 | 가성비, 장편, 멀티샷 |

| Runway Gen-4.5 | 10s | 없음 | ~$0.12/s | Motion Brush, 영화 제작 도구 |

| Hailuo AI | 10s | 없음 | $9.99/월 | 속도, 저예산, 물리 시뮬레이션 |

| Luma Ray3 | ~10.5s | 없음 | $9.99/월 | HDR 워크플로, 포스트 프로덕션 |

자주 묻는 질문

Seedance 2.0이란 무엇인가요?

Seedance 2.0은 ByteDance가 2026년 2월에 출시한 멀티모달 AI 비디오 모델입니다. 네이티브 오디오가 포함된 최대 2K 해상도의 4~15초 비디오 클립을 생성합니다. 텍스트, 이미지, 비디오, 오디오를 결합한 입력을 받아들이며 1회 생성당 최대 12개의 참조 에셋을 지원합니다.

Seedance 2.0은 무료인가요?

Seedance 2.0은 네이티브 플랫폼에서 무료 및 유료 티어를 제공합니다(최대 $49.99/월). PixVerse에서는 Pro, Premium, Ultra 멤버가 이용 가능하며 크레딧으로 청구됩니다——720p Standard 5초 클립은 150 크레딧. Ultra 멤버는 모든 Seedance 2.0 생성에 40% 할인을 받습니다.

Seedance 2.0은 Seedance 1.0과 어떻게 비교되나요?

마이너 업데이트가 아닌 완전한 재구축입니다. 주요 업그레이드: 네이티브 오디오 생성 (1.0에는 없었음), 최대 12개 에셋의 멀티모달 입력 (1.0은 텍스트와 선택적 이미지 하나만 지원), 더 높은 해상도 (2K 대 1080p), 더 나은 손/팔다리 렌더링, 첫 시도에서 90% 이상의 사용 가능한 출력 비율.

중국 외 지역에서 Seedance 2.0을 사용할 수 있나요?

즉몽 앱을 통한 직접 접근에는 중국 전화번호와 결제 수단이 필요해 해외 사용자에게 마찰이 생깁니다. 더 쉬운 방법은 PixVerse를 통해 Seedance 2.0을 사용하는 것입니다——지역 제한 없음, 별도 계정 필요 없음.

Seedance 2.0의 최적 프롬프트 구조는 무엇인가요?

[주체] + [동작] + [배경] + [스타일] + [카메라] + [조명]으로 시작합니다. 카메라 방향은 구체적으로 (“미디엄 샷에서 클로즈업으로의 슬로우 달리인”) 지정하고, 시각 에셋이 있을 때는 @image1 / @video1 참조 구문을 사용해 출력을 유도합니다. 멀티샷 시퀀스에는 타임라인 표기법을 사용합니다: 0–4s: 와이드 샷, 4–8s: 트래킹 샷 등.

Seedance 2.0과 PixVerse V6 중 어떤 것을 사용해야 하나요?

프로젝트에 따라 다릅니다. PixVerse V6는 20개 이상의 파라미터화된 카메라 컨트롤, 개발자 워크플로를 위한 CLI 접근, 그리고 간편한 글로벌 가용성을 제공합니다. Seedance 2.0은 더 풍부한 멀티모달 입력(12개 에셋), 더 높은 해상도(2K), 비디오 내 편집을 제공합니다. 두 모델 모두 PixVerse에 있으므로 나란히 테스트할 수 있습니다.

Seedance 2.0이 오디오를 생성하나요?

네. 비디오와 동일한 과정에서 대화(7개 이상 언어로 립싱크), 효과음, 앰비언트 오디오를 생성합니다. 별도의 오디오 프로덕션 단계가 필요 없습니다. 오디오는 기본으로 켜져 있으며, 비주얼 트랙만 필요한 경우 비활성화할 수 있습니다.

Seedance 2.0의 주요 한계점은 무엇인가요?

지역 접근 장벽(주로 중국 플랫폼에 연결됨), 과도한 콘텐츠 심사, 베타 단계 API, LoRA 또는 파인튜닝 지원 없음, 비디오 내 텍스트 렌더링 불안정, 가파른 학습 곡선, 최대 클립 길이 15초.

최종 평가

Seedance 2.0은 AI 비디오 생성의 진정한 진보입니다——특히 멀티모달 프롬프트 시스템을 배우는 데 시간을 투자할 의향이 있는 크리에이터에게. 참조 기반 워크플로, 네이티브 오디오, 타임라인 기반 멀티샷 생성은 이를 신기한 장난감보다 프로덕션 도구에 더 가깝게 만듭니다.

모두에게 맞는 것은 아닙니다. 한 줄 프롬프트로 빠른 클립을 얻고 싶다면 Hailuo AI나 PixVerse V6가 더 적은 마찰로 더 빨리 도달하게 해줍니다. 4K 출력이 필요하다면 Veo 3나 Kling 3.0이 더 적합합니다. 카메라 제어가 우선순위라면 PixVerse V6가 현재 Seedance 2.0의 프롬프트 기반 접근보다 더 정밀하고 파라미터화된 옵션을 제공합니다.

지금 Seedance 2.0을 시도하는 가장 강력한 이유는 하나의 모델만 선택할 필요가 없다는 것입니다. PixVerse에서 동일한 컨셉을 Seedance 2.0, V6, Kling, Veo로 먼저 돌린 뒤, ai video generator 랭킹에 오른 각 플래그십과 한 줄로 대조해 보세요——결과를 비교하고, 각 샷에 가장 효과적인 것을 활용하세요. 그 유연성이 어떤 단일 모델의 벤치마크 점수보다 중요합니다.