Seedance 2.0 : Avis, Prompts et Alternatives en 2026

Seedance 2.0 : flux @, six prompts PixVerse, accès Jimeng, place face à V6, Kling, Veo.

Seedance 2.0 est sorti début février 2026 et a envahi X et Reddit en moins de 48 heures. Les créateurs publiaient des extraits qui semblaient provenir d’un studio de production — et non d’un modèle d’IA. Les benchmarks confirmaient l’engouement : ELO 1 269 en texte-vers-vidéo et 1 351 en image-vers-vidéo, le plaçant devant Kling 3.0, Veo 3 et Runway Gen-4.5 au lancement.

Deux mois plus tard, la poussière est retombée. Nous avons passé des semaines à tester Seedance 2.0 dans différents scénarios — scènes cinématographiques, publicités produit, portraits, séquences fantastiques — et à lire des centaines de publications communautaires pour distinguer ce qui fonctionne vraiment de ce qui ne brille que dans une démo. Cet avis couvre ce que le modèle fait bien, ses lacunes, ce que les utilisateurs en pensent, comment il se compare à son prédécesseur et à ses concurrents, ainsi que six cas d’usage avec des prompts que vous pouvez tester immédiatement.

Points clés :

- Seedance 2.0 accepte jusqu’à 12 entrées mixtes (texte, images, vidéo, audio) et génère des clips de 4 à 15 secondes en résolution jusqu’à 2K avec audio natif.

- Le comportement de la caméra, la cohérence des personnages et le rendu des mains/membres sont nettement meilleurs que dans Seedance 1.0.

- L’accès en dehors de la Chine reste problématique. La modération agressive des contenus et la courbe d’apprentissage prononcée pour les utilisateurs occasionnels sont des plaintes récurrentes.

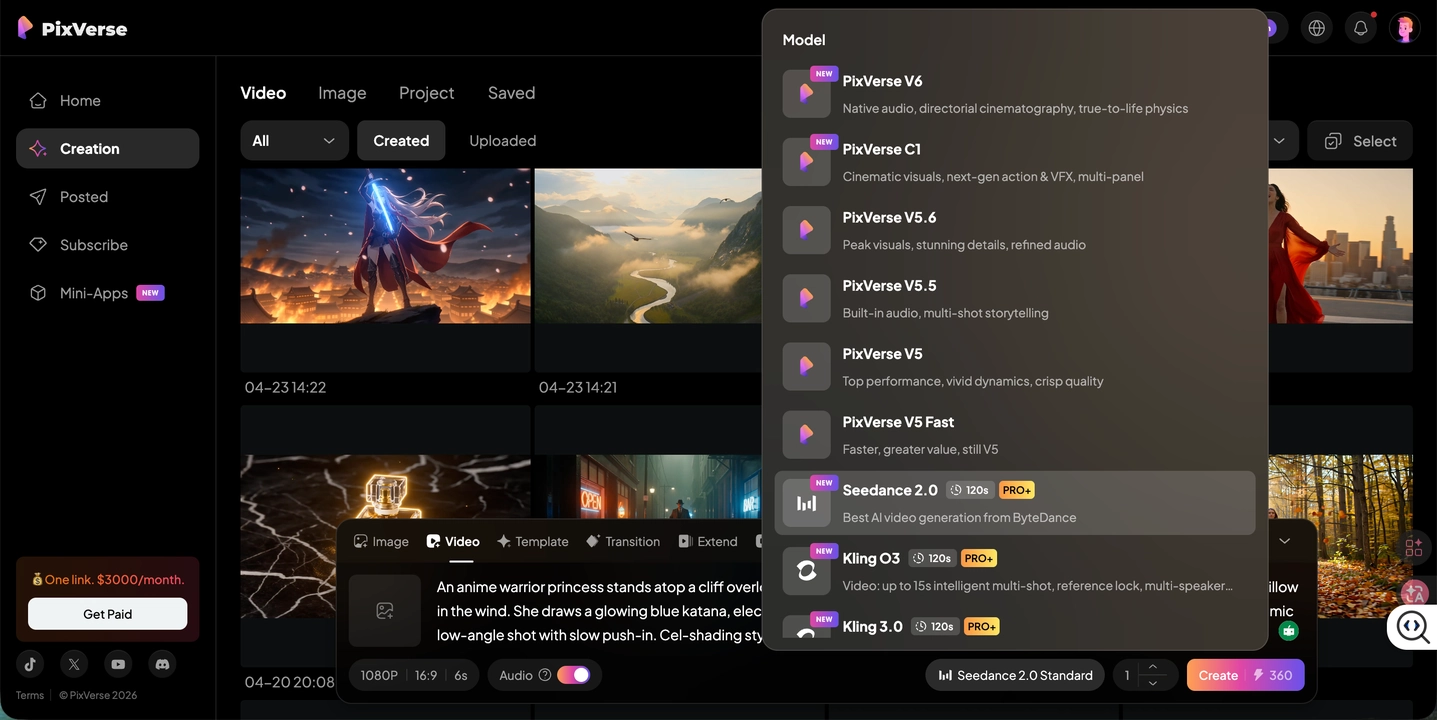

- Seedance 2.0 est désormais disponible sur PixVerse, vous pouvez donc le tester aux côtés de PixVerse V6, Kling, Veo et d’autres modèles sans changer de plateforme.

Qu’est-ce que Seedance 2.0 ?

Seedance 2.0 est un modèle vidéo IA multimodal conçu par ByteDance. Il a été lancé le 7 février 2026 en tant que reconstruction complète — et non une mise à jour incrémentale de Seedance 1.0.

La version précédente traitait le texte et les images via des pipelines séparés. Seedance 2.0 les remplace par un Transformateur de Diffusion Multimodale Unifié qui encode le texte, l’image, l’audio et la vidéo dans un espace de représentation partagé. En pratique, cela signifie que le modèle peut prendre un prompt textuel, une photo de référence de votre personnage, un clip vidéo montrant le mouvement de caméra souhaité, et une piste audio — puis combiner tout cela en une seule sortie.

Le modèle prend en charge jusqu’à 12 ressources de référence par génération : 9 images, 3 vidéos et 3 fichiers audio. Vous les balisez dans votre prompt avec une syntaxe @ (@image1, @video1, etc.) pour indiquer au modèle exactement où chaque référence doit s’appliquer.

Spécifications de sortie : 4 à 15 secondes de vidéo en résolution jusqu’à 2K, avec un audio stéréo natif généré dans le même temps que les visuels.

Points forts de Seedance 2.0 : Ce qu’il fait bien

Entrée multimodale et le système @Référence

Le système de référence est la fonctionnalité phare. Au lieu de tout décrire en texte et d’espérer que le modèle l’interprète correctement, vous pouvez lui montrer ce que vous voulez. Téléchargez une photo de visage et balisez-la comme @image1 dans votre prompt, ajoutez un clip vidéo montrant la trajectoire de caméra souhaitée, et incluez une piste musicale de fond. Le modèle lit chaque référence et l’applique là où vous l’avez spécifié.

Cela fonctionne particulièrement bien pour la cohérence des personnages sur plusieurs générations. Téléchargez la même référence de visage et le personnage conserve son apparence — ce qui nécessite encore des contournements sur la plupart des modèles concurrents.

Comportement cinématographique de la caméra

Seedance 2.0 gère les mouvements de caméra plus naturellement que la plupart des modèles que nous avons testés. Les plans de suivi, les zooms avant et les orbites lentes paraissent fluides et intentionnels plutôt qu’aléatoires. Un utilisateur Reddit a signalé avoir recréé des mouvements de caméra de la série Severance avec des résultats « remarquablement précis ».

Le modèle répond bien aux instructions caméra spécifiques dans les prompts : « lent dolly avant d’un plan moyen vers un gros plan » ou « plan de suivi en contre-plongée » produisent des résultats prévisibles. Les instructions vagues comme « cinématographique » offrent moins de contrôle, mais la sortie reste raisonnable par défaut.

Synchronisation audio-vidéo native

Seedance 2.0 génère l’audio et la vidéo simultanément par diffusion conjointe. Cela inclut :

- Des dialogues avec lip-sync en 7+ langues

- Des effets sonores synchronisés avec les actions à l’écran

- Des ambiances sonores et de la musique de fond correspondant à l’atmosphère visuelle

La qualité du lip-sync est excellente dans nos tests — nettement supérieure aux outils de doublage en post-production. Ce n’est pas parfait, mais cela élimine le besoin d’un pipeline audio séparé dans la plupart des cas.

Cohérence temporelle et réalisme physique

Les personnages et les objets conservent leur forme d’une image à l’autre avec un scintillement minimal. Le rendu des mains — historiquement le point faible de la vidéo IA — est considérablement amélioré par rapport à la version 1.0. Les doigts gardent le bon nombre plus souvent, et les mouvements des membres semblent avoir du poids plutôt que de flotter.

Le drapé des tissus, le comportement de l’eau et la physique des collisions sont tous plus crédibles. Cela compte pour tout ce qui va au-delà des visuels abstraits. Si vous générez une publicité produit ou un récit centré sur des personnages, une physique convaincante fait la différence entre « impressionnante démo IA » et « footage utilisable ».

Narration multi-plans

Vous pouvez structurer votre prompt comme une timeline — 0–4s : plan large d'établissement, 4–8s : plan moyen de suivi, etc. — et le modèle génère chaque segment comme une séquence cohérente. Les personnages restent cohérents, et les transitions entre les plans sont fluides plutôt que brusques.

Il s’agit d’un véritable changement de workflow. Les modèles précédents vous obligeaient à générer les plans individuellement et à les assembler en post-production. Seedance 2.0 gère le séquençage nativement.

Édition dans la vidéo

Vous pouvez remplacer des personnages ou des objets dans une vidéo existante sans régénérer l’intégralité du clip. Besoin de changer la tenue de votre personnage ? Remplacer le fond ? Le modèle modifie l’élément ciblé et laisse tout le reste intact. Cette fonctionnalité n’est pas disponible sur la plupart des modèles concurrents et économise un temps d’itération considérable.

Seedance 2.0 en un coup d’œil

| Spécification | Détail |

|---|---|

| Développeur | ByteDance |

| Date de lancement | 7 février 2026 |

| Architecture | Transformateur de Diffusion Multimodale Unifié |

| Entrées | Texte + jusqu’à 9 images + 3 vidéos + 3 fichiers audio |

| Résolution maximale | 2K |

| Durée | 4–15 secondes |

| Audio natif | Oui (dialogue, effets, ambiance, musique) |

| Langues lip-sync | 7+ |

| Édition dans la vidéo | Oui (remplacement de personnage/objet) |

Les limites de Seedance 2.0

Aucun modèle n’arrive sans compromis. Voici ceux qui comptent.

L’accès régional est limité. Seedance 2.0 a été lancé principalement via l’écosystème chinois de ByteDance (l’application Jimeng). Les utilisateurs internationaux font face à des délais de vérification, des blocages régionaux et des frictions de paiement. Le contournement le plus simple est d’y accéder via PixVerse, qui supprime entièrement les barrières géographiques.

La modération du contenu est agressive. Plusieurs utilisateurs signalent que des prompts bénins sont signalés. Les générations liées aux visages sont particulièrement susceptibles de déclencher des filtres. Un commentaire Reddit résumait bien : « La censure a tout simplement gâché Seedance 2.0. » C’est un vrai goulot d’étranglement pour le travail créatif commercial où vous avez besoin d’une sortie cohérente.

La courbe d’apprentissage est prononcée. Si vous souhaitez simplement taper une phrase et obtenir une vidéo, Seedance 2.0 n’est pas le point de départ le plus accessible. Le système @référence, le prompting en timeline et les entrées multimodales sont puissants — mais ils demandent du temps à apprendre. Les avis lui attribuent systématiquement une note élevée pour les professionnels (8,5/10) et basse pour les utilisateurs occasionnels (5/10).

L’API est encore en bêta. Les équipes d’entreprise ayant besoin d’un accès programmatique stable doivent anticiper des changements de rupture et des surprises de limitation de débit.

Le rendu de texte dans la vidéo est peu fiable. Si votre scène inclut du texte à l’écran — un panneau, un carton de titre, une étiquette produit — attendez-vous à des résultats incohérents. C’est une faiblesse partagée par la plupart des modèles vidéo en 2026, mais elle mérite d’être mentionnée.

Pas de support LoRA. Vous ne pouvez pas affiner le modèle sur des ensembles de données personnalisés. Si vous avez besoin d’un style visuel spécifique ou d’une identité de marque que le modèle de base ne couvre pas, vous êtes limité à l’ingénierie des prompts et aux images de référence.

Maximum 15 secondes par clip. Suffisant pour le contenu social et les publicités, mais court pour le travail narratif. Le prompting multi-plans aide, mais vous êtes toujours limité à 15 secondes par génération.

Ce que dit la communauté

Retours des créateurs et des professionnels

Les créateurs professionnels — cinéastes, producteurs de clips musicaux, agences publicitaires — sont le groupe d’utilisateurs le plus enthousiaste. Le système de référence multimodale et le prompting en timeline correspondent à leur façon de penser la production : en termes de plans, de références et de séquences plutôt que de descriptions textuelles.

Un avis notait Seedance 2.0 à 8,5/10 pour les créatifs professionnels qui ont besoin d’un contrôle granulaire. Un testeur précoce sur X notait : « Mon co-fondateur a passé une journée entière à essayer d’obtenir cet effet. Seedance 2.0 l’a fait en 5 minutes. »

Le modèle est décrit comme quelque chose qui « pense comme un réalisateur » — il répond aux directions au niveau du plan plutôt que de générer simplement quelque chose qui correspond vaguement à votre prompt. Pour les équipes déjà travaillant dans des workflows de pré-production, c’est un changement significatif.

Réactions sur les réseaux sociaux et les forums

Les communautés Reddit (r/SeedanceAI_Lab, r/Seedance_v2) sont actives et en croissance. Les sorties les plus partagées tendent à être des clips cinématographiques qui ressemblent davantage à des prises de vue en direct qu’à de la vidéo IA classique.

Les plaintes courantes sur les réseaux sociaux correspondent à nos propres conclusions : difficulté d’accès en dehors de la Chine, faux positifs de modération, et l’investissement en temps nécessaire pour apprendre le système de prompts. Plusieurs fils de discussion comparent l’expérience à « avoir un appareil photo puissant mais devoir apprendre le mode manuel avant d’obtenir de bonnes photos ».

La controverse sur le droit d’auteur

Dans les jours suivant le lancement, Disney a envoyé à ByteDance une mise en demeure, alléguant que Seedance 2.0 généraient des personnages Disney à partir de ses données d’entraînement. La Motion Picture Association et SAG-AFTRA ont publié des déclarations. Des vidéos virales de sosies de célébrités générées par IA ont alimenté le débat.

Il s’agit d’une question juridique en cours dans l’ensemble de l’espace vidéo IA, et pas spécifique à Seedance 2.0. Mais elle mérite d’être suivie si vous prévoyez d’utiliser le modèle pour des travaux commerciaux impliquant des personnages ou des sosies reconnaissables.

Seedance 2.0 vs. Seedance 1.0 : Ce qui a changé

Le passage de la 1.0 à la 2.0 est une reconstruction architecturale complète. Voici comment ils se comparent :

| Fonctionnalité | Seedance 1.0 | Seedance 2.0 |

|---|---|---|

| Architecture | Pipelines texte et image séparés | Transformateur de Diffusion Multimodale Unifié |

| Entrée texte | Oui | Oui |

| Entrée image | Image optionnelle unique | Jusqu’à 9 images avec contrôle @tag |

| Entrée vidéo | Non | Jusqu’à 3 vidéos de référence |

| Entrée audio | Non | Jusqu’à 3 fichiers audio |

| Sortie audio native | Non | Oui (dialogue, effets, ambiance, musique) |

| Résolution maximale | 1080p | 2K |

| Durée | 5–10 secondes | 4–15 secondes |

| Multi-plans | Basique | Storyboard en timeline avec cohérence entre plans |

| Qualité mains/membres | Artefacts fréquents | Nettement améliorée |

| Édition dans la vidéo | Non | Oui (remplacement de personnage/objet) |

| Taux de sortie utilisable | ~60% | 90%+ au premier essai |

Les deux plus grandes améliorations dans l’usage quotidien sont l’audio natif (absent dans la 1.0) et le système de référence multimodale (limité à une seule image optionnelle dans la 1.0). Si vous avez essayé la 1.0 et êtes passé à autre chose, la 2.0 est un outil fondamentalement différent.

Cas d’usage de Seedance 2.0 : Six prompts testés

Nous avons testé Seedance 2.0 sur six scénarios couvrant les besoins créatifs les plus courants. Chaque prompt ci-dessous est prêt à être copié et testé. Pour chacun, nous décrivons ce que nous avons obtenu, le temps que cela a pris, et ce qui a fonctionné ou non.

Tous les tests ont été effectués sur PixVerse avec Seedance 2.0 Standard en 720p, 5–8 secondes, format 16:9 sauf indication contraire.

Scène de film cinématographique

Ce prompt teste le comportement de la caméra, l’atmosphère et le rendu des personnages dans des conditions sombres et à fort contraste — le type de scène qui expose rapidement les artefacts de mouvement.

Prompt :

A retired detective in a long dark coat walks through a rain-soaked alley at night. Neon signs reflect red and blue on the wet cobblestones. He pauses, lights a cigarette, and glances over his shoulder. Slow push-in from wide shot to medium close-up. Film noir style, anamorphic lens flare, teal-orange color grading, film grain.

Ce que nous avons obtenu : Le zoom avant de la caméra était fluide et stable — sans saccades ni sauts brusques. Les reflets de pluie sur les pavés étaient convaincants, avec les couleurs néon se fondant dans la surface mouillée comme il se doit. Le manteau du détective bougeait naturellement pendant sa marche, et le geste d’allumer la cigarette était rendu sans distorsion des mains. L’audio ambiant incluait de la pluie et des bruits de ville lointains, bien adaptés à la scène. La génération a pris environ 70 secondes en Standard. Dans l’ensemble, c’est le type de sortie que vous pourriez intégrer dans un mood reel ou une présentation de court-métrage sans grand travail de post-production.

Publicité produit

Les plans produit sont un test pratique de la simulation physique : la lumière frappe-t-elle correctement la surface, la rotation paraît-elle mécaniquement fluide, et le matériau ressemble-t-il à ce qu’il est censé être ?

Prompt :

A luxury perfume bottle rotates slowly on a black marble surface. Golden liquid catches the light as it turns. Soft particles of gold dust float in the air around it. Macro close-up, slow 360-degree orbit camera. Studio lighting with warm rim light, high-end commercial photography style.

Ce que nous avons obtenu : La réfraction du verre et le comportement du liquide à l’intérieur du flacon étaient étonnamment précis. Les particules dorées dérivaient à un rythme naturel, et la surface en marbre avait une texture de grain visible. La caméra en orbite était fluide sur toute la rotation. La lumière frappait le verre aux bons angles, produisant le type de reflets caustiques que l’on attendrait d’un vrai studio. Temps de génération total : environ 65 secondes. Pour un premier jet de vidéo concept produit, cela économise des heures par rapport à la mise en place d’un rendu 3D.

Clip musical

Les clips musicaux exigent un mouvement expressif, des changements d’éclairage dramatiques, et la capacité à maintenir l’apparence d’un personnage à travers un mouvement dynamique. C’est là que la cohérence temporelle est mise à rude épreuve.

Prompt :

A female singer in a flowing red silk dress performs on a rooftop at sunset. City skyline stretches behind her. Wind blows her hair and dress dramatically. She sings with emotional intensity, arms spread wide. Dynamic tracking shot circling around her. Golden hour backlighting, lens flare, vibrant warm tones.

Ce que nous avons obtenu : La physique de la robe était le point fort — la soie rouge captant le vent et la lumière d’une manière qui semblait physique, et non procédurale. L’orbite de suivi autour de la chanteuse était fluide, et son visage restait cohérent tout au long de la rotation complète. Le mouvement des cheveux semblait naturel et correspondait à la direction du vent sur la robe, un détail que beaucoup de modèles ratent. L’audio natif générait une piste musicale ambiante correspondant au tempo de ses mouvements. Génération : environ 75 secondes. Si vous construisez un mood board ou une vidéo concept pour un projet musical, cela vous amène à 80% du résultat en une seule génération.

Portrait de personnage en mouvement

Le mouvement subtil est plus difficile que l’action dramatique pour la plupart des modèles vidéo. Les petits gestes — un mouvement de tête, des mains examinant un objet — exposent une instabilité temporelle que les scènes à mouvement rapide peuvent masquer.

Prompt :

An elderly Japanese craftsman in a traditional wooden workshop, morning light streaming through paper screens. He slowly lifts a hand-forged ceramic tea bowl, examining it with quiet pride. His weathered hands rotate the bowl gently. Close-up of his hands, then slow tilt up to reveal his face. Wabi-sabi aesthetic, warm natural light, documentary portrait quality.

Ce que nous avons obtenu : C’était l’un des résultats les plus solides de nos tests. Les mains — typiquement le maillon faible de la vidéo IA — sont restées stables avec le bon nombre de doigts et un mouvement naturel des articulations tout au long du clip. L’inclinaison de la caméra des mains au visage était fluide, et la transition de mise au point semblait être un vrai rack de mise au point. La lumière matinale à travers les écrans en papier projetait des ombres douces et uniformes. Le modèle a ajouté de lui-même de légers sons d’ambiance de l’atelier : un oiseau au loin, le léger tintement de la céramique. La texture de la peau sur les mains vieillies semblait réaliste sans sur-netteté. Génération : environ 80 secondes. Pour le contenu de style documentaire ou la narration de marque, ce niveau de subtilité est exactement ce dont vous avez besoin.

Nature et paysage

Les plans aériens et de paysage testent la cohérence à grande échelle : le modèle peut-il maintenir un environnement cohérent sur une caméra en mouvement pendant plusieurs secondes ?

Prompt :

Aerial drone shot gliding over a misty mountain valley at sunrise. Layers of fog roll between emerald green peaks. A winding river reflects the golden morning light below. Eagles soar through the frame at eye level. Smooth forward tracking with slight descent. Epic landscape, volumetric fog, golden hour lighting.

Ce que nous avons obtenu : Les couches de brouillard se déplaçaient indépendamment et à des vitesses différentes, ce qui donnait à la scène une véritable profondeur plutôt qu’un aspect de peinture mate plate. Le reflet de la rivière se mettait à jour correctement au fur et à mesure que la caméra avançait — un détail qui nécessite une conscience spatiale du modèle. La palette de couleurs globale — ors chauds frappant des montagnes bleu-vert froid — était bien rendue, et le brouillard volumétrique semblait tridimensionnel. L’audio incluait du vent et des appels d’oiseaux au loin correspondant à l’environnement. C’était aussi la génération la plus rapide de notre série : environ 55 secondes. Le résultat est proche de ce que vous obtiendriez d’une prise de vue drone professionnelle, sans le budget voyage.

Anime et fantaisie

Le contenu stylisé est un défi différent du photoréalisme. Le modèle doit maintenir un style artistique cohérent (cel-shading, lignes de vitesse, couleur plate) tout en générant un mouvement crédible.

Prompt :

An anime warrior princess stands atop a cliff overlooking a burning medieval city at night. Her long silver hair and crimson cape billow in the wind. She draws a glowing blue katana, electricity crackling along the blade. Cherry blossom petals swirl around her. Dynamic low-angle shot with slow push-in. Cel-shading style, vibrant neon accents, dramatic speed lines.

Ce que nous avons obtenu : Le cel-shading était maintenu de manière cohérente tout au long du clip — aucune fusion entre le style anime et le photoréaliste, ce qui est un problème courant avec d’autres modèles. Le dégainement du katana était fluide, et l’effet d’électricité le long de la lame semblait appartenir à un vrai anime plutôt qu’à une simple superposition lumineuse générique. Les pétales de cerisier se déplaçaient indépendamment, certains captant la lueur de feu de la ville en flammes en dessous. L’audio incluait un dramatique sifflement pour le dégainement de l’épée qui correspondait parfaitement au mouvement. Génération : environ 70 secondes. La cohérence de style est la chose la plus difficile à obtenir dans l’anime généré par IA, et Seedance 2.0 l’a mieux géré que la plupart des modèles que nous avons testés.

Alternatives à Seedance 2.0 : Comparaison des meilleurs générateurs vidéo IA en 2026

Seedance 2.0 est un modèle solide, mais ce n’est pas la seule option — et selon vos besoins, ce n’est peut-être pas le meilleur choix. Voici comment les principales alternatives se comparent.

PixVerse V6 — et Seedance 2.0 sur PixVerse

Avant de comparer les modèles individuels, il vaut la peine d’aborder un problème pratique : chaque modèle vit sur sa propre plateforme avec son propre compte, sa tarification et son workflow. Si vous voulez tester Seedance 2.0 contre Kling 3.0 pour une publicité produit, vous avez normalement besoin de deux comptes et de deux ensembles de crédits.

PixVerse résout ce problème. Seedance 2.0 a été lancé sur PixVerse le 13 avril 2026, rejoignant Kling O3, Veo 3.1, Sora 2 et d’autres modèles. Un seul compte, un seul solde de crédits, comparaison côte à côte.

Seedance 2.0 sur PixVerse est disponible en deux niveaux :

| Niveau | 480p | 720p | 1080p |

|---|---|---|---|

| Standard | 15 crédits/s | 30 crédits/s | Disponible |

| Rapide | 10 crédits/s | 20 crédits/s | N/A |

Un clip de 5 secondes en 720p Standard coûte 150 crédits. Rapide revient à 100 crédits pour le même clip. Les membres Pro, Premium et Ultra peuvent accéder à Seedance 2.0. Les membres Ultra bénéficient d’une remise de 40% sur les crédits pour toutes les générations.

Au-delà de l’hébergement de modèles tiers, PixVerse V6 est une alternative solide à part entière. Il adopte une approche différente — là où Seedance 2.0 excelle dans la précision multi-référence, PixVerse V6 se concentre sur le contrôle de la caméra et la production multi-plans.

| Fonctionnalité | PixVerse V6 | Seedance 2.0 |

|---|---|---|

| Durée maximale | 15 secondes | 15 secondes |

| Contrôle caméra | 20+ contrôles paramétrés (dolly, grue, orbite, suivi) | Description basée sur le prompt |

| Audio natif | Oui | Oui (lip-sync en 7+ langues) |

| Types d’entrée | Texte + image ; moteur multi-plans | Texte + 9 images + 3 vidéos + 3 audio |

| Édition dans la vidéo | Non | Oui |

| Multi-plans | Film à prompt unique avec audio natif | Storyboard en timeline |

| Accès | Web, mobile, API, CLI | Jimeng (Chine) ou PixVerse |

| Coût (1080p, par seconde) | 14 crédits (~0,07$) | 30 crédits Standard (~0,15$) |

Choisissez V6 quand : vous avez besoin de mouvements de caméra précis, d’une intégration CLI pour les workflows développeur (fonctionne avec Claude Code, Codex, Cursor), ou d’un accès mondial sans restrictions.

Choisissez Seedance 2.0 quand : vous avez besoin d’un contrôle d’entrée multi-référence, d’une sortie en haute résolution, ou d’une édition dans la vidéo.

Les deux sont disponibles sur PixVerse, vous n’avez donc pas à vous engager sur l’un ou l’autre.

Sora 2 (OpenAI)

Sora 2 est le plus performant pour la narration et la simulation physique. L’adhérence aux prompts est élevée, et le modèle gère les scènes émotionnelles — moments pilotés par le dialogue, interactions subtiles entre personnages — mieux que la plupart des concurrents. Il nécessite un abonnement ChatGPT Plus (20$/mois) ou Pro (200$/mois). La tarification API varie de 0,10 à 0,50$ par seconde selon la résolution. Sortie maximale : 1080p, jusqu’à 20 secondes.

Veo 3 (Google)

Veo 3 est le champion de la résolution : sortie native 4K avec une option 60fps et audio spatial. Il s’intègre parfaitement dans les workflows Google Cloud, ce qui le rend attrayant pour les équipes d’entreprise déjà dans cet écosystème. Le compromis est la durée — les clips sont limités à 8 secondes, ce qui limite son utilité pour le contenu narratif. La tarification commence à 0,05$/s pour le niveau Lite.

Kling 3.0 (Kuaishou)

Kling 3.0 offre le meilleur rapport qualité-prix par clip. 4K natif à 60fps, lip-sync multilingue, et un Multi-Shot AI Director qui gère jusqu’à six coupes de caméra dans une seule génération de 15 secondes. Element Binding maintient la cohérence des personnages et des objets entre les plans. Les abonnements commencent à 10$/mois. Le niveau gratuit existe mais est limité à Kling 2.0.

Runway Gen-4.5

Runway dispose de la boîte à outils d’édition la plus mature. Motion Brush vous donne un contrôle au niveau de la frame sur la façon dont des régions spécifiques de votre vidéo se déplacent. Si vous travaillez déjà dans un pipeline de post-production avec After Effects ou DaVinci Resolve, Runway s’intègre naturellement. L’inconvénient : résolution maximale de 720p et plafond de 10 secondes par clip. La tarification API est d’environ 0,12$ par seconde.

Hailuo AI (MiniMax)

Hailuo est l’option rapide. Les temps de génération varient de 30 à 90 secondes par clip — les plus rapides de cette comparaison. Il se classe n°1 sur WorldModelBench pour la simulation physique et gère bien le contenu anime et stylisé. La résolution maximale est de 1080p, mais les clips sont limités à 10 secondes. Les abonnements commencent à 9,99$/mois.

Luma Ray3 (Dream Machine)

Ray3 cible la post-production professionnelle. 1080p natif avec HDR, sortie de frames EXR 16 bits pour les pipelines d’étalonnage colorimétrique, et un Draft Mode qui génère 5x plus vite à 5x moins cher pour le prototypage rapide. La fonctionnalité Modify Video étend jusqu’à 18 secondes. Les abonnements commencent à 9,99$/mois.

Tableau de comparaison complet

| Modèle | Durée max | Audio natif | Prix de départ | Idéal pour |

|---|---|---|---|---|

| Seedance 2.0 | 15s | Oui | ~150 crédits/clip sur PixVerse | Contrôle multi-référence, récits cinématographiques |

| PixVerse V6 | 15s | Oui | ~70 crédits/clip | Contrôle caméra, films multi-plans, workflows CLI |

| Sora 2 | 20s | Non | 0,10$/s | Narration, simulation physique |

| Veo 3 | 8s | Oui (spatial) | 0,05$/s | Photoréalisme 4K, entreprise |

| Kling 3.0 | 15s | Oui | 10$/mois | Valeur, longue durée, multi-plans |

| Runway Gen-4.5 | 10s | Non | ~0,12$/s | Motion Brush, outils cinéastes |

| Hailuo AI | 10s | Non | 9,99$/mois | Rapidité, budget, physique |

| Luma Ray3 | ~10,5s | Non | 9,99$/mois | Workflows HDR, post-production |

Foire aux questions

Qu’est-ce que Seedance 2.0 ?

Seedance 2.0 est un modèle vidéo IA multimodal de ByteDance, sorti en février 2026. Il génère des clips vidéo de 4 à 15 secondes en résolution jusqu’à 2K avec audio natif. Le modèle accepte le texte, les images, la vidéo et l’audio comme entrées combinées — jusqu’à 12 ressources de référence par génération.

Seedance 2.0 est-il gratuit ?

Seedance 2.0 propose des niveaux gratuits et payants sur sa plateforme native (jusqu’à 49,99$/mois). Sur PixVerse, il est disponible pour les membres Pro, Premium et Ultra, facturé en crédits — un clip Standard de 5 secondes en 720p coûte 150 crédits. Les membres Ultra bénéficient d’une remise de 40% sur toutes les générations Seedance 2.0.

Comment Seedance 2.0 se compare-t-il à Seedance 1.0 ?

C’est une reconstruction complète, pas une mise à jour mineure. Les principales améliorations : génération audio native (absente dans la 1.0), entrée multimodale avec jusqu’à 12 ressources (la 1.0 ne supportait que du texte plus une image optionnelle), résolution supérieure (2K vs. 1080p), meilleur rendu des mains/membres, et un taux de sortie utilisable de 90%+ au premier essai.

Puis-je utiliser Seedance 2.0 en dehors de la Chine ?

L’accès direct via l’application Jimeng nécessite des numéros de téléphone et des moyens de paiement chinois, ce qui crée des frictions pour les utilisateurs internationaux. La solution la plus simple est d’utiliser Seedance 2.0 via PixVerse — sans restrictions régionales, sans compte séparé nécessaire.

Quelle est la meilleure structure de prompt pour Seedance 2.0 ?

Commencez par : [Sujet] + [Action] + [Cadre] + [Style] + [Caméra] + [Éclairage]. Soyez précis avec les directions de caméra (« lent dolly avant d’un plan moyen vers un gros plan ») et utilisez la syntaxe de référence @image1 / @video1 lorsque vous avez des ressources visuelles pour guider la sortie. Pour les séquences multi-plans, utilisez la notation timeline : 0–4s : plan large, 4–8s : plan de suivi, etc.

Seedance 2.0 vs. PixVerse V6 — lequel utiliser ?

Cela dépend du projet. PixVerse V6 offre 20+ contrôles de caméra paramétrés, l’accès CLI pour les workflows développeur, et une disponibilité mondiale simple. Seedance 2.0 propose des entrées multimodales plus riches (12 ressources), une résolution supérieure (2K), et l’édition dans la vidéo. Les deux modèles sont sur PixVerse, vous pouvez donc les tester côte à côte.

Seedance 2.0 génère-t-il de l’audio ?

Oui. Il génère des dialogues (avec lip-sync en 7+ langues), des effets sonores et de l’audio ambiant dans le même passage que la vidéo. Aucune étape de production audio séparée n’est nécessaire. L’audio est activé par défaut et peut être désactivé si vous avez uniquement besoin de la piste visuelle.

Quelles sont les principales limites de Seedance 2.0 ?

Barrières d’accès régionales (principalement liées aux plateformes chinoises), modération agressive du contenu, API en phase bêta, absence de support LoRA ou de fine-tuning, rendu de texte peu fiable dans la vidéo, courbe d’apprentissage prononcée, et durée maximale de clip de 15 secondes.

Verdict final

Seedance 2.0 représente une véritable avancée pour la génération vidéo IA — particulièrement pour les créateurs prêts à investir du temps dans l’apprentissage de son système de prompts multimodal. Le workflow basé sur les références, l’audio natif et la génération multi-plans basée sur une timeline le rapprochent davantage d’un outil de production que d’un générateur gadget.

Ce n’est pas pour tout le monde. Si vous souhaitez qu’une seule ligne de prompt produise un clip rapide, des modèles comme Hailuo AI ou PixVerse V6 vous y amèneront plus vite avec moins de friction. Si vous avez besoin d’une sortie 4K, Veo 3 ou Kling 3.0 sont de meilleurs choix. Et si le contrôle de la caméra est votre priorité, PixVerse V6 offre actuellement des options plus précises et paramétrées que l’approche basée sur les prompts de Seedance 2.0.

L’argument le plus fort pour essayer Seedance 2.0 maintenant est que vous n’avez pas à choisir un seul modèle. Sur PixVerse, vous pouvez d’abord faire tourner le même concept dans Seedance 2.0, V6, Kling et Veo, puis le confronter à chaque modèle phare de notre classement ai video generator — comparer les résultats, et utiliser ce qui fonctionne le mieux pour chaque plan. Cette flexibilité compte plus que le score de benchmark de n’importe quel modèle.