Sora vs Veo vs PixVerse: guia profissional 2026 para stacks de vídeo IA

O Sora 2 encerrou em março de 2026. O guia cobre o legado do Sora e os acessos ao Veo 3.1, depois o PixVerse V6, com notas breves sobre R1 e Mini Apps.

O Sora 2 ficou offline em 24 de março de 2026. A OpenAI citou custos de computação e pressão regulatória. Ambos contribuíram para o que o tornou um referencial da categoria e, por fim, insustentável. Três semanas depois, o PixVerse V6 foi lançado. O Google já tinha disponibilizado o Veo 3.1 em outubro de 2025.

Em seis meses, a stack de vídeo IA se reorganizou. Uma ferramenta saiu de cena. Outras duas entraram em produção. Este artigo dedica mais espaço ao Sora 2 (histórico) e ao Veo 3.1 (o que o Google entrega hoje) do que a uma visão única de fornecedor e, em seguida, resume o PixVerse no mesmo quadro comparativo — o V6 para paridade direta texto-vídeo, mais notas mais curtas sobre o R1 e as Mini Apps quando a sua tarefa não é um único clip.

Como abordámos o tema: Onde as ferramentas ainda estavam disponíveis, executámos o mesmo prompt de teste em cada uma e descrevemos o que observámos. Os exemplos de clientes abaixo ilustram como as equipas integram um modelo num pipeline, e não uma promessa de que os seus resultados serão idênticos.

Conclusões principais (abril de 2026)

- O Sora 2 já não tem aplicação pública nem API; trate-o como uma era de referência para geração com ênfase em física e planeie a migração se ainda tiver fluxos de trabalho no estilo Sora.

- O Veo 3.1 é o caminho ativo do Google: forte adequação ao ecossistema se o senhor ou a senhora já trabalha em Gemini, Vertex AI ou entrega ao estilo Shorts; os clips predefinidos têm 8 segundos, e a extensão de cena é a principal forma de aumentar a duração.

- O PixVerse V6 é a opção paralela para clips mais longos num único passe, multi-plano no mesmo plano e controlo mais forte ao nível de lente — avalie-o com base nos seus próprios briefings, não só nos nossos.

- O R1 (mundos em tempo real) e as Mini Apps (por exemplo, produto para anúncio) só importam se o requisito não for um ficheiro de vídeo padrão para download — nesse caso, avance para essas subsecções.

Resposta rápida: Para trabalho corrente de texto para vídeo, a escolha em produção é Veo 3.1 ou PixVerse V6. Escolha o Veo quando a contratação na Google Cloud, o Gemini ou a integração com o Vertex já definir a sua stack. Escolha o PixVerse V6 quando quiser saída mais longa num único passe, multi-plano integrado numa só geração e parâmetros de câmara mais diretos — e só acrescente o R1 ou as Mini Apps se o caso de uso corresponder ao que esses produtos fazem.

Tabela comparativa: Sora 2, Veo 3.1 e PixVerse V6

Os três modelos visam a mesma função: transformar um prompt de texto num vídeo concluído com áudio sincronizado. A tabela abaixo compara-os nas especificações que mais importam ao escolher uma ferramenta de geração para trabalho criativo ou de produção. Integração empresarial, acesso por API e casos de implementação são abordados na secção dedicada a cada modelo mais abaixo.

| Sora 2 | Veo 3.1 | PixVerse V6 | |

|---|---|---|---|

| Desenvolvedor | OpenAI | PixVerse | |

| Estado | ⛔ Offline desde 24 de março de 2026 | ✅ Activo | ✅ Activo (lançado a 30 de março de 2026) |

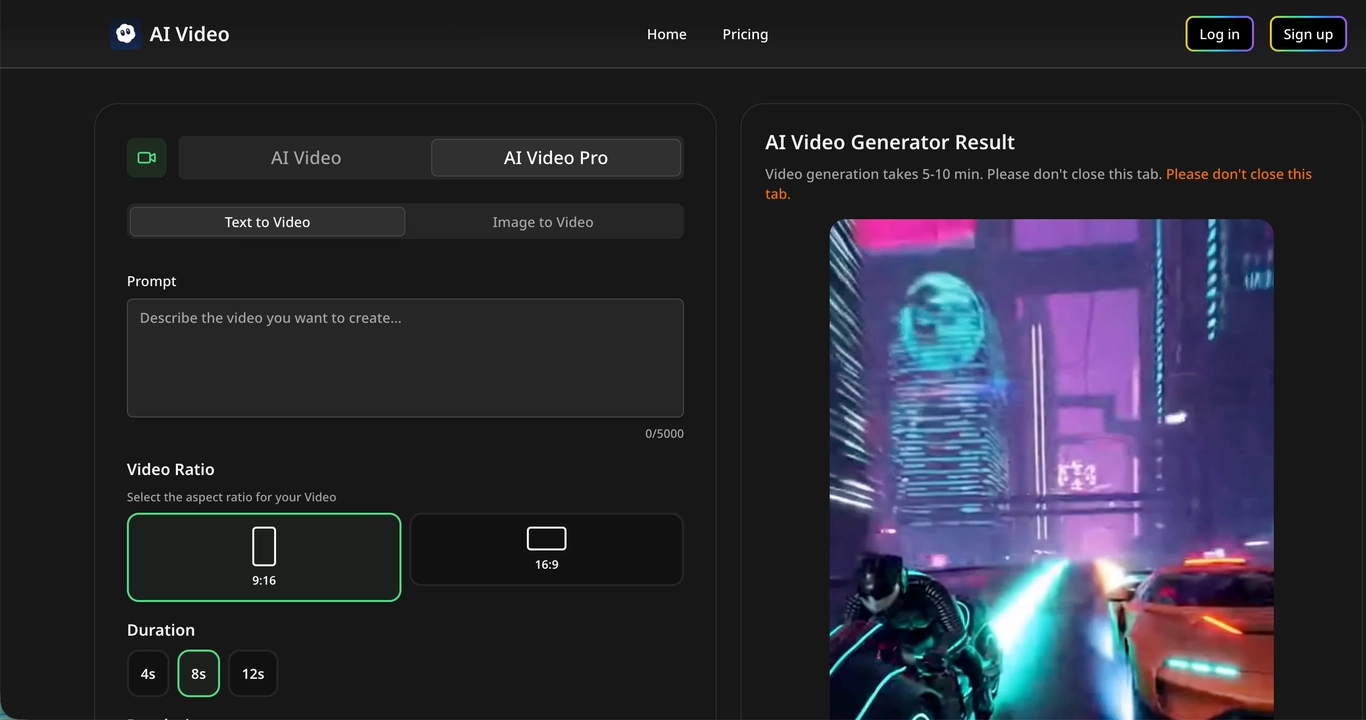

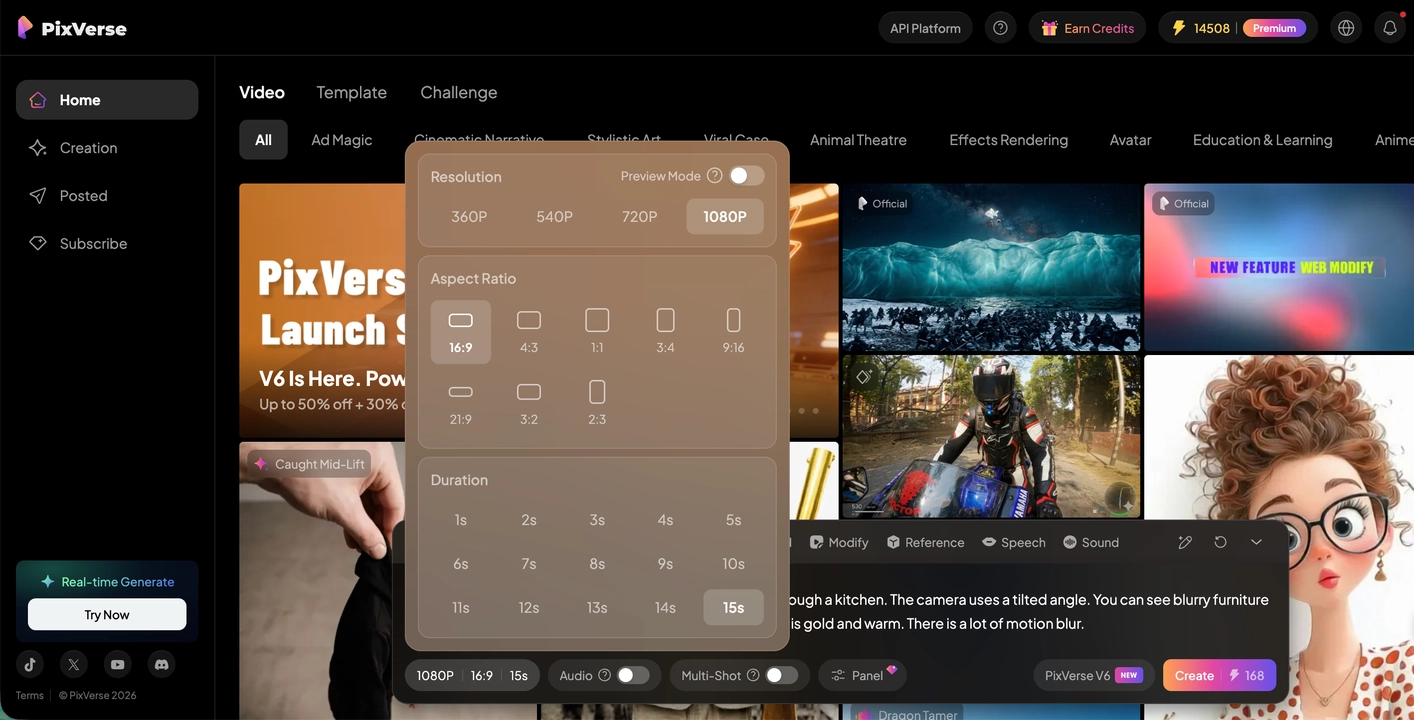

| Resolução máxima | 1080p (nível Pro) | 720p / 1080p / 4K | 1080p |

| Duração num único passe | Até 12 s | 8 s | Até 15 s |

| Motor multi-plano | Prompting manual | Extensão sequencial | Integrado (uma geração) |

| Áudio nativo | Fala sincronizada, efeitos | Diálogo, efeitos, ambiente | Gerado com o movimento num único passe |

| Texto no vídeo | Limitado | Limitado | Multilingue, estável ao movimento |

| Controlos cinematográficos | Básicos | Básicos | Mais de 20 parâmetros de lente |

| Créditos diários gratuitos | Nenhuns (Pro 200 $/mês) | API paga | Sim (dependente da plataforma) |

| Acesso para programadores / API | Roadmap de API (agora offline) | API Gemini, Vertex AI | CLI + API, compatível com agentes |

O Sora 2 estabeleceu um referencial com ênfase em física, mas já não está disponível. O Veo 3.1 lidera nas opções de resolução (até 4K) e na adequação a equipas padronizadas no Google. O PixVerse V6 enfatiza duração maior num único passe, multi-plano dentro de uma geração e controlos de lente mais granulares a 1080p. Com o Sora offline, a maioria dos compradores compara Veo 3.1 e PixVerse V6 para fluxos baseados em ficheiro; o R1 e as Mini Apps são formatos de produto distintos e são abordados brevemente mais adiante.

Qual ferramenta de vídeo IA escolher em 2026?

Se o objetivo é um fluxo padrão de texto para vídeo, a comparação real já não é Sora versus Veo versus PixVerse em pé de igualdade. O Sora 2 faz parte do referencial histórico, mas a decisão de compra ativa situa-se entre o Veo 3.1 e o PixVerse V6.

Escolha o Veo 3.1 se a sua equipa já opera dentro da Google Cloud, precisa de integração com Gemini ou Vertex AI e valoriza mais opções 4K e uma stack empresar familiar do que saída mais longa num único passe.

Escolha o PixVerse V6 se precisar de até 15 segundos num só passe, geração multi-plano integrada, controlos cinematográficos mais fortes e um fluxo que possa ir do teste à produção sem juntar várias extensões de cena.

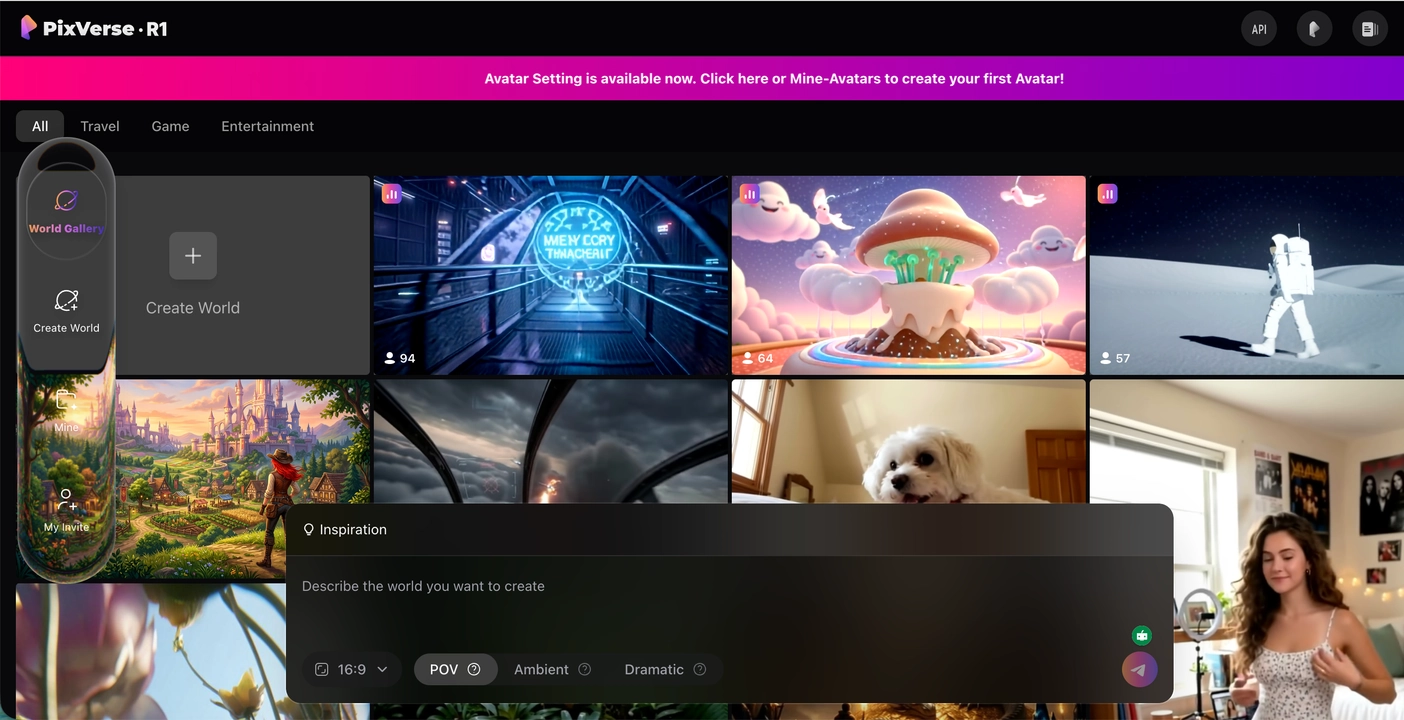

Escolha o PixVerse R1 se o caso de uso não for um ficheiro de vídeo acabado, mas um mundo interativo em tempo real que responde aos utilizadores em direto. Essa é uma categoria de produto diferente do Sora 2 e do Veo 3.1.

Escolha as Mini Apps PixVerse se a tarefa real for criação automática de anúncios a partir de ativos de produto e não cinema guiado por prompts. Nesse caso, a comparação relevante é com fluxos tradicionais de produção publicitária, não só com geradores de vídeo de propósito geral.

Teste lado a lado: 3 geradores de vídeo IA comparados

As especificações descrevem potencial. O mesmo prompt executado nas três ferramentas mostra como cada modelo se comporta sob pressão.

Prompt de teste:

Um plano fechado realista de uma abelha a voar muito depressa por uma cozinha. A câmara usa um ângulo inclinado. Vê-se mobiliário desfocado e um frasco de mel partido numa mesa. A iluminação é dourada e quente. Há muito desfoque de movimento.

O prompt foi escolhido para stressar três aspetos ao mesmo tempo: movimento rápido do sujeito, detalhe de material fino (vidro, mel, metal) e geometria espacial tipo olho-de-peixe. Avaliámos cada saída quanto à consistência espacial, estabilidade temporal e precisão do áudio nativo.

Sora 2

A cozinha ficou bela. Graduação quente, profundidade cinematográfica, luz ambiente forte que parecia pensada e não apenas procedural. Onde o Sora 2 falhou foi na fidelidade ao prompt no sujeito principal. O espaço tinha prioridade; a abelha estava presente, mas subvalorizada. Pedir «muito depressa» produziu uma deriva a velocidade normal na maioria das gerações. O detalhe cibernético que especificámos na abelha não se registou de forma fiável. Obter uma tomada comercialmente utilizável exigiu regenerações repetidas — a 200 $/mês, isso acumula-se depressa. O Sora 2 permaneceu referência para narrativa de ambiente; para movimento guiado pelo sujeito, deixou trabalho por fazer.

Veo 3.1

Cor e nitidez ficaram bem. A cena da cozinha tinha geometria limpa e resposta de materiais correta em superfícies planas. Onde o Veo 3.1 falhou foi na fidelidade do movimento: a instrução «muito depressa» produziu uma deriva lenta, não voo. A reprodução também mostrou soluços notáveis no nosso ficheiro. O áudio estava presente e incluía tom ambiente de cozinha, mas a sincronização com o movimento mais rápido no ecrã parecia aproximada e não travada. Para um prompt que insiste em velocidade e energia, o Veo 3.1 entregou um resultado competente, mas visualmente passivo.

PixVerse V6

A geometria tipo olho-de-peixe manteve-se ao longo de todo o passe. À medida que a abelha se movia junto aos electrodomésticos, a distorção da lente seguia a posição do sujeito frame a frame sem deriva. O mel âmbar no frasco partido mostrou viscosidade plausível e refracção de luz à medida que a câmara passava. O áudio do batimento das asas foi gerado no mesmo passe que o vídeo, e o zumbido seguiu o arco de voo da entrada à saída sem passo de sincronização separado. O corte da cozinha em plano largo para o macro no frasco de mel leu-se como movimento contínuo, não como costura. A estabilidade temporal manteve-se a 1080p ao longo dos 15 segundos completos.

Para saída de vídeo completa de cada ferramenta e o benchmark alargado a dez modelos, consulte o artigo 2026 AI Video Generator.

OpenAI Sora 2

O Sora 2 foi o modelo de geração de vídeo e áudio da OpenAI: visava simular consequência física (um lançamento de basquetebol falhado rebate no tabelaço) em vez de apenas interpolar fotogramas plausíveis. Esse enquadramento importou para como as equipas julgaram o «realismo» em 2025 — menos como polimento, mais como consequência.

Capacidades

O Sora 2 foi lançado a 30 de setembro de 2025 como sistema de propósito geral. No nível Pro suportava até 12 segundos a 1080p. Movimento complexo — desporto, acrobacias, diálogo com várias personagens — mostrava frequentemente maior plausibilidade física do que ferramentas de consumo anteriores. O áudio era nativo num único passe: fala, efeitos e ambiente em conjunto.

O pipeline Characters permitia a utilizadores aprovados colocar uma pessoa real numa cena com semelhança e voz após passos de identidade e consentimento. O comportamento multi-plano podia manter ambiente e iluminação entre cortes quando os prompts pediam continuidade.

Onde falhou na prática

O Sora 2 não era determinístico. Prompts precisos ainda derivavam em rostos, guarda-roupa e adereços pequenos; mãos e manipulação fina eram pontos de falha frequentes. Equipas à procura de uma performance de herói específica pagavam em volume de regenerações: o preço Pro de 200 $/mês importava menos do que o imposto de iteração — muitas passagens para um único clip entregável. Briefings com movimento rápido do sujeito mais detalhe fino (o nosso teste da abelha está nessa família) eram especialmente propensos a consumir orçamento sem retorno garantido.

Encerramento e quem teve de migrar

A OpenAI removeu a aplicação Sora e a API a 24 de março de 2026, citando custo de computação e pressão em torno de média sintética. À data deste texto não existe ponto final público para o Sora 2.

O impacto foi desigual: integrações de API e fluxo de trabalho quebraram de imediato; utilizadores de subscrição perderam uma ferramenta de produção de um dia para o outro; equipas que usavam Characters ou distribuição ao estilo social tiveram de substituir tanto geração como pressupostos de conformidade. Para um mapa prático de substituição, consulte Sora alternatives.

Como pensar na migração (neutro face aos fornecedores)

Não está a escolher «o próximo Sora». Está a alinhar restrições: precisa de contratação nativa Google e clips curtos em escala? De governação classe Vertex? De ficheiros mais longos num único passe? De automatização produto para anúncio? Ordene essas prioridades e execute os seus próprios prompts nas listas curtas — o nosso teste lado a lado é um ponto de dados, não um ranking universal.

Historicamente, o Sora 2 definiu uma referência para narrativa com ênfase em física contra a qual modelos posteriores ainda são medidos — mesmo quando diferem em preço, acesso ou risco de encerramento.

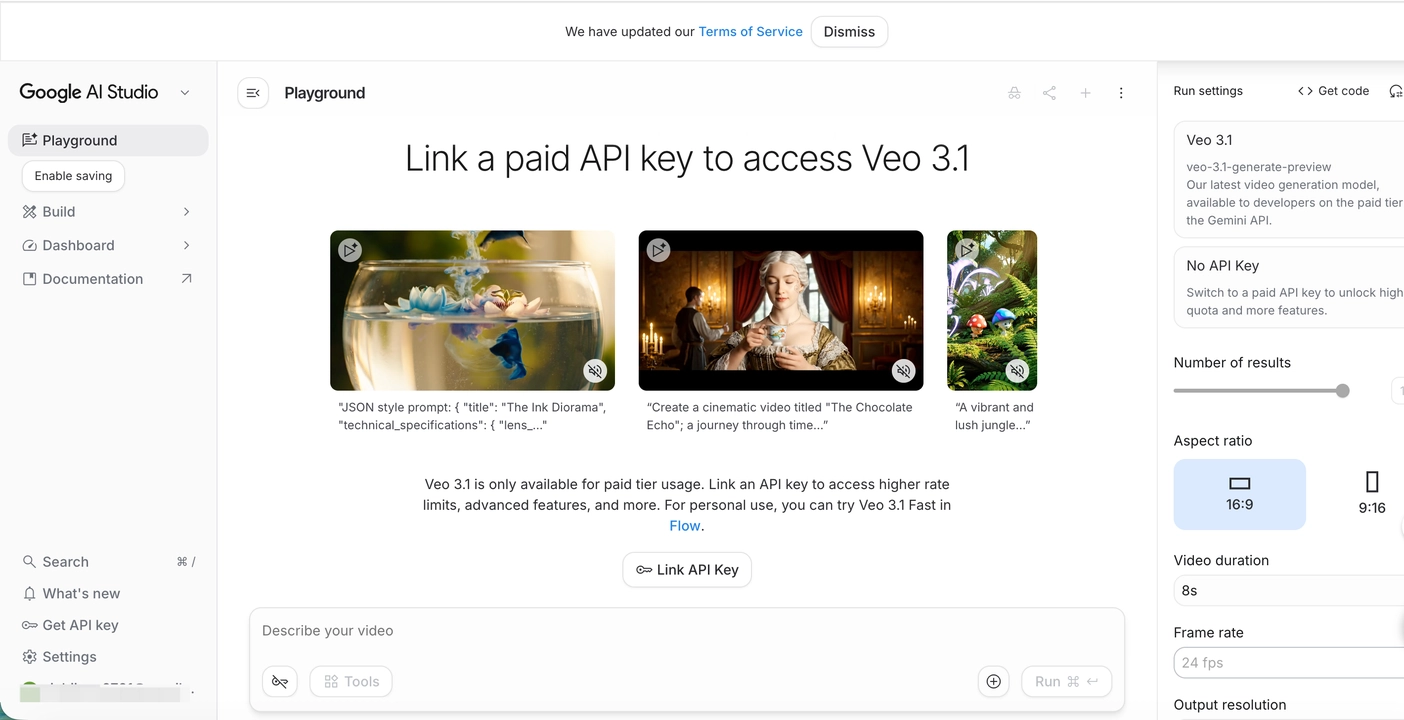

Google Veo 3.1

O Veo 3.1 é o modelo de vídeo generativo do Google para transformar prompts (e algumas âncoras visuais) em clips curtos com áudio nativo. Através da API Gemini (desde outubro de 2025) liga-se ao Google AI Studio, ao Vertex AI e a superfícies de consumo como Flow, a aplicação Gemini e YouTube Shorts — assim, «Veo» pode significar desde um teste rápido na app até uma implementação empresarial governada.

Capacidades

O Veo 3.1 suporta 720p, 1080p e 4K em 16:9 e 9:16. A geração predefinida é de 8 segundos — adequada a ritmos ao estilo Shorts e iteração rápida, mas uma restrição estrutural para peças narrativas.

A extensão de cena é a principal forma de ir além: cada novo segmento pode continuar a partir do último fotograma do clip anterior, pelo que sequências de vários minutos são possíveis como uma cadeia de prompts e revisões, não como um passe contínuo ininterrupto. Esse padrão favorece equipas confortáveis com storyboard, controlo de qualidade e novo prompting entre segmentos.

Ingredients to Video (até três imagens de referência) ajuda a fixar aspeto ou identidade entre gerações — útil quando já existem ativos de marca. O controlo de primeiro e último fotograma visa transições controladas entre duas imagens estáticas, com áudio na mesma geração.

O áudio (diálogo, efeitos, ambiente) é entregue com o vídeo. No nosso teste da abelha, o som estava presente, mas a sincronização passo a passo com o movimento mais rápido no ecrã nem sempre era convincente — vale validar nos seus próprios prompts com muita ação.

Vias de acesso e implicações

Nem todos os pontos de entrada são intercambiáveis:

- As aplicações de consumo (Gemini / Flow / Shorts) são a forma mais rápida de experimentar saída ao estilo Veo; termos, limites de taxa e caminhos de exportação diferem do uso por API.

- O Google AI Studio / API Gemini serve programadores a prototipar na stack Google.

- O Vertex AI é a rota empresarial: tratamento de dados, faturação e alavancas de governação importam quando o jurídico ou as compras já estão padronizados na Google Cloud.

Se a sua organização não encaminha já a produção através do Google, deve orçamentar tempo de engenharia para autenticação, faturação e revisão de políticas — não só qualidade do modelo.

Limitações

Os oito segundos predefinidos significam que narrativas mais longas são um problema de desenho de fluxo de trabalho: a extensão de cena funciona, mas não é o mesmo modelo operacional que multi-plano dentro de uma geração. Equipas que precisam de um ficheiro com cortes internos estruturados podem preferir que essa distinção fique explícita na avaliação.

Fora do ecossistema Google, a sobrecarga de integração é real: não está só a escolher um modelo — está a escolher como o vídeo se situa ao lado de armazenamento, identidade e ferramentas de conformidade que já paga.

PixVerse

A OpenAI e o Google entregam cada um um gerador de vídeo principal nesta história (Sora 2 historicamente, Veo 3.1 hoje). O PixVerse agrupa o V6 para o mesmo trabalho baseado em ficheiro e acrescenta o R1 (mundos em direto) e as Mini Apps (ferramentas de cenário como Ad Master) — úteis quando o fluxo não é um único clip renderizado.

Dica de âmbito: Se só comparar exportações texto-vídeo, leia V6 e Benchmarks; trate R1 e Mini Apps como complementos opcionais quando a interação em direto ou o débito produto-anúncio importa.

PixVerse V6

O PixVerse V6 (30 de março de 2026) é o homólogo direto da geração descarregável ao estilo Sora ou Veo no PixVerse. Para contexto além deste artigo a três vias e dez modelos, consulte 2026 AI Video Generator. Visa até 15 segundos a 1080p num único passe, com um motor multi-plano que mantém estado de mundo partilhado entre cortes internos (plano largo para macro sem tratar cada corte como geração totalmente nova). O áudio nativo é gerado com o movimento; o texto no vídeo suporta várias línguas; mais de 20 parâmetros de lente (distância focal, abertura, profundidade de campo, aberração cromática, vinheta, entre outros) expõem controlo ao estilo de câmara antes da renderização.

O tratamento de materiais e movimento é mais forte do que em gerações PixVerse anteriores para muitos briefings — ainda assim verifique nas tomadas que realmente entrega.

PixVerse R1

O PixVerse R1 não é um substituto direto do Sora 2 ou do Veo 3.1 se precisar de um MP4 acabado e mais nada. Transmite um mundo interativo persistente com baixa latência — incluindo Shared Worlds (sessões em direto multi-utilizador guiadas por prompts) e Personalized Avatars na linha de abril de 2026. Detalhe de arquitectura e roadmap está no artigo R1; o acesso hoje é em realtime.pixverse.ai.

Nota: O acesso de parceiros e por API para o R1 segue o PixVerse R1 Partner Program.

O Sora 2 e o Veo 3.1 não visam este problema de mundo em tempo real; avalie o R1 só quando a especificação do produto o exigir.

Mini Apps (Ad Master)

O Ad Master (31 de março de 2026) é uma Mini App imagem de produto para vídeo de anúncio: carregue uma foto SKU e uma descrição curta, obtenha composição, locução e legendas num passe automático — preço na ordem de 2–3 $ por vídeo conforme o plano. Compete com operações publicitárias internas, não só com geradores de propósito geral. Abrir Ad Master.

Modelos PixVerse num relance

| V6 | R1 | Mini Apps (Ad Master) | |

|---|---|---|---|

| Finalidade | Geração de vídeo cinematográfica | Mundos interactivos em tempo real | Vídeo comercial automatizado |

| Saída | Ficheiro de vídeo acabado (até 15 s 1080p) | Fluxo visual em direto persistente (1080p) | Vídeo de anúncio completo com locução |

| Entrada | Prompt de texto ou imagem de referência | Prompt de texto (em direto, multi-utilizador) | Imagem de produto + descrição |

| Áudio | Nativo, sincronizado com o movimento | Geração de ambiente em tempo real | Locução e legendas geradas automaticamente |

| Interacção | Gerar, rever, iterar | Tempo real, partilhado, contínuo | Automatizado num passo |

| Ideal para | Cineastas, agências, programadores | Envolvimento comunitário, experiências interactivas | Comércio electrónico, PME, marketing de desempenho |

| Preços | Créditos diários gratuitos + níveis de subscrição | Acesso gratuito | ~3 $/vídeo (2 $ para subscritores) |

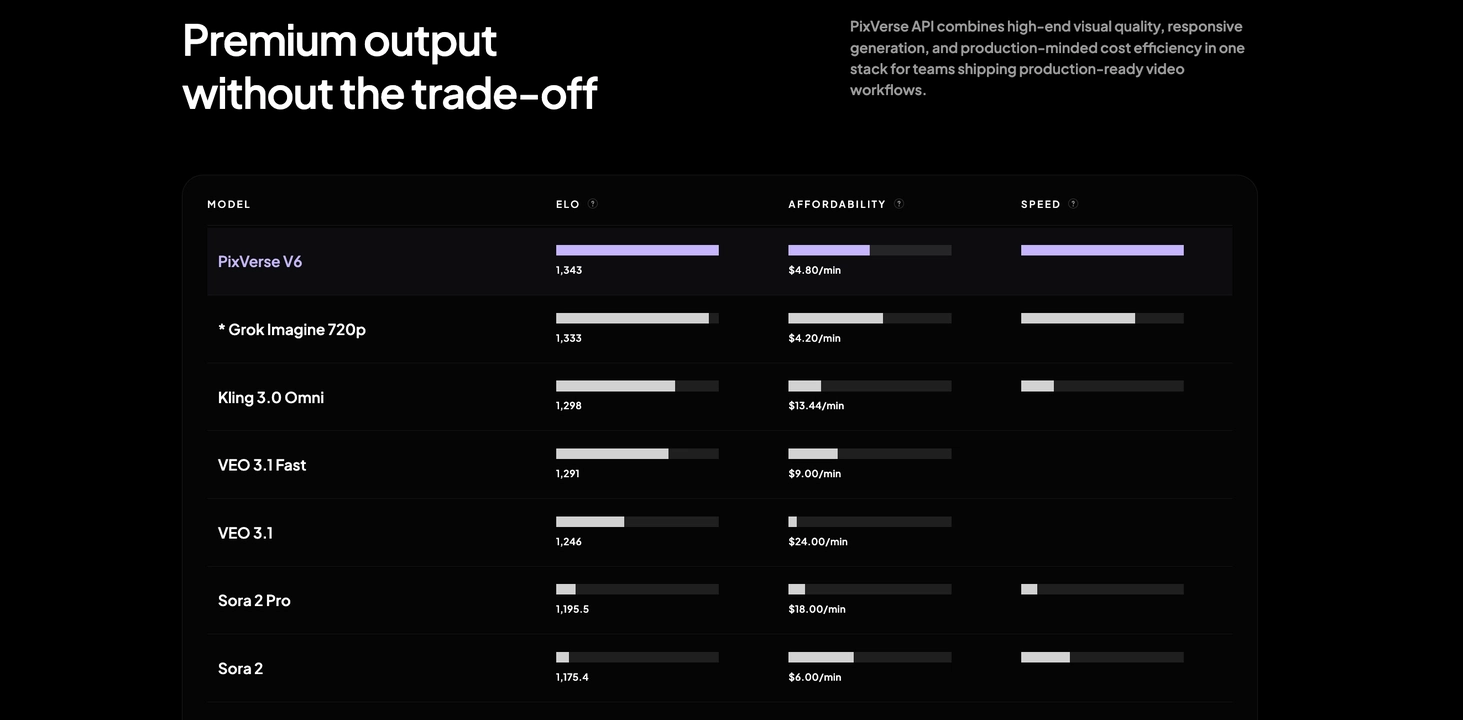

Benchmarks e instantâneo de custos

O PixVerse mantém uma tabela interna (ELO, $/minuto aproximado, velocidade). À data deste artigo, linhas indicativas incluem: PixVerse V6 com ELO 1 343 e 4,80 $/min; Veo 3.1 Fast a 1 291 / 9,00 $/min; Veo 3.1 (standard) a 1 246 / 24,00 $/min; Sora 2 Pro a 1 195,5 / 18,00 $/min; Sora 2 (standard) a 1 175,4 / 6,00 $/min. Os números do Sora são históricos — o serviço está offline. Use esta tabela como instantâneo e confirme preços e termos em vigor em cada fornecedor antes de orçamentar.

Como as equipas implementam o PixVerse na prática

Encaminhamento API: Fornecedores de inferência como a Runware expõem o PixVerse V6 junto de outros modelos para que os programadores invoquem vídeo pela mesma stack que usam para imagens — útil quando o requisito é encaminhamento multi-modelo, não uma única interface de fornecedor.

Produto incorporado: Empresas como a Perfect Corp (YouCam) integram a geração dentro de uma aplicação existente para que os utilizadores passem de fotos estáticas a vídeo curto sem sair de um fluxo familiar — útil quando a distribuição é beleza de consumo ou retalho, não só uma página de gerador autónomo.

Estes exemplos mostram onde o PixVerse frequentemente se liga; não são recomendações para todos os casos de uso.

Acesso para programadores

O V6 e as Mini Apps estão disponíveis na Web. O V6 também inclui uma CLI para fluxos de agentes de código e automação (PixVerse CLI guide). O R1 transmite em realtime.pixverse.ai; o acesso por API está descrito no artigo Partner Program.

Uso comercial e adequação operacional

Para equipas que avaliam estas ferramentas para produção paga, a decisão não depende só da qualidade de saída. Depende também da via de acesso, modelo de preços, custo de iteração, fluxo de implementação e se o produto se mapeia claramente ao trabalho que realmente precisa de ser feito.

O Veo 3.1 tende a encaixar quando compras, governação e implementação já estão na stack Google. O PixVerse V6 tende a encaixar quando o estrangulamento é saída mais longa e coerente, controlo cinematográfico ou menos passos de costura do prompt ao clip acabado. O R1 e as Mini Apps importam quando o requisito é interação em direto ou automatização produto-anúncio em vez de exportação genérica de clip. Em todos os casos, confirme uso comercial actual, moderação e tratamento de dados com cada fornecedor antes de entregar trabalho a clientes.

Onde cada ferramenta se encaixa

Clips sociais de formato curto: a saída de 8 segundos do Veo 3.1 e o suporte vertical 9:16 cobrem a maior parte das necessidades sociais com pouca sobrecarga de prompting. O PixVerse V6 trata dos mesmos formatos com 15 segundos para conteúdo que precisa de mais espaço narrativo. O Sora 2 está offline.

Vídeo herói de campanha: quando o ativo precisa de 12–15 segundos com iluminação de produto consistente ao longo de uma sequência de planos, a duração num único passe do V6 e a lógica multi-plano integrada reduzem o custo de iteração face à abordagem de extensão sequencial do Veo. Ambos produzem saída profissional; a diferença é quanto prompting manual se situa entre planos.

Narrativa multi-plano: a extensão de cena e o suporte a imagens de referência do Veo 3.1 tratam sequências mais longas. O motor multi-plano do V6 gere cortes consistentes com a personagem numa só geração e exige menos iterações de costura para narrativa estruturada.

Produção automatizada em grande volume: o Veo 3.1 via Vertex AI encaixa em equipas já padronizadas na Google Cloud. O PixVerse V6 via API ou CLI encaixa em pipelines que precisam de geração como passo dentro de automação mais ampla (ver exemplos de implementação acima). A API do Sora 2 está offline.

Comércio electrónico e anúncios de produto: o Ad Master foi concebido à volta de entradas de produto à escala SKU; o Sora 2 e o Veo 3.1 são geradores gerais, não pipelines dedicados produto-anúncio.

Experiências interactivas e envolvimento comunitário: o R1 visa mundos em direto guiados pelo público — mais próximos de uma transmissão guiada por prompts do que de renderização em lote. O Sora 2 e o Veo 3.1 não se concentram nessa forma de produto.

Beleza, retalho e visualização de produto: as equipas neste espaço frequentemente precisam que rostos, embalagens e texto no ecrã localizado permaneçam estáveis. Compare o V6 e o Veo nas suas tomadas herói; implementações de aplicações incorporadas (por exemplo fluxos de beleza) são um padrão, não uma prova universal.

FAQ

O Sora ainda está disponível?

A partir de 24 de março de 2026, a aplicação Sora e a API da OpenAI estão offline. Não há ponto final público activo para o Sora 2.

Como se compara o Veo 3.1 ao PixVerse V6 para conteúdo mais longo?

O Veo 3.1 tem por defeito 8 segundos; a extensão de cena pode atingir sequências de vários minutos como cadeia de segmentos. O PixVerse V6 gera até 15 segundos num único passe e pode estruturar vários planos dentro desse passe. Prefira o Veo quando já optimiza para beats curtos e entrega nativa Google; prefira o V6 quando quiser um ficheiro com cortes internos sem novo prompting em cada plano.

O que é o PixVerse R1?

O R1 é o modelo de mundo em tempo real do PixVerse. Em vez de apenas exportar um ficheiro acabado, mantém um ambiente visual interactivo persistente guiado por prompts em direto — incluindo sessões partilhadas multi-utilizador e avatares na linha de abril de 2026. Entrada: realtime.pixverse.ai.

Posso usar estas ferramentas para produção comercial?

O uso comercial depende do nível actual de cada plataforma, termos da API, regras de moderação e políticas regionais. Antes de campanhas pagas ou entrega a clientes, verifique direitos de uso e tratamento de dados com a OpenAI, Google e PixVerse.

Que gerador de vídeo IA devo testar primeiro?

Faça passar um brief de produção real, não demos genéricos, por Veo 3.1 e PixVerse V6. Avalie sincronização de áudio, consistência entre planos e número de iterações. Para anúncios de catálogo, cronometre o Ad Master face ao seu fluxo SKU actual.

Conclusão

O Sora 2 está offline, mas continua a importar como período de referência para clips com ênfase em física e áudio nativo num único passe. O Veo 3.1 é o caminho activo do Google: predefinições curtas, forte alcance de superfícies Google e API, e extensão de cena quando aceita produção segmentada. O PixVerse V6 é a opção paralela quando a duração num único ficheiro, o multi-plano no passe e o controlo ao nível de lente importam mais do que encaixar no pacote Google.

O PixVerse também opera R1 e Mini Apps em categorias adjacentes — mundos em direto e anúncios ao estilo SKU — onde o referencial é frequentemente a produção tradicional, não só o Sora ou o Veo.

Para vídeo descarregável padrão em 2026, a maioria das equipas pré-seleccionará Veo 3.1 e PixVerse V6, validará ambos com os seus próprios prompts e decidirá entre adequação ao ecossistema e estrutura do clip. Contexto mais alargado de modelos está no artigo 2026 AI Video Generator.