Sora vs. Veo vs. PixVerse : guide pro 2026 des stacks vidéo IA

Sora 2 a été arrêté en mars 2026. Comparez-le à Veo 3.1 et PixVerse : génération vidéo, mondes interactifs temps réel et création publicitaire automatisée.

Sora 2 a été mis hors ligne le 24 mars 2026. OpenAI a invoqué les coûts de calcul et la pression réglementaire. Les deux facteurs ont contribué à ce qui en faisait une référence de catégorie et, à terme, à son caractère non viable. Trois semaines plus tard, PixVerse V6 a été lancé. Google avait déjà livré Veo 3.1 en octobre 2025.

En six mois, la stack vidéo IA a été rebattue. Un outil a disparu. Deux autres sont passés en production. Cet article couvre les trois : ce dont Sora était capable avant son arrêt, ce que fait Veo 3.1 aujourd’hui, et ce que PixVerse livre réellement sur ses gammes V6, R1 et Mini Apps.

Réponse courte : Si vous avez besoin d’un générateur vidéo IA opérationnel aujourd’hui, le choix pratique se situe entre Veo 3.1 et PixVerse V6. Veo 3.1 convient aux équipes qui travaillent déjà dans Google Cloud et les workflows Gemini. PixVerse V6 convient aux équipes qui ont besoin de clips plus longs en une seule passe, d’une génération multi-plans intégrée et d’un contrôle accru sur le rendu cinématographique. Si votre évaluation dépasse la génération standard, PixVerse s’étend aussi avec R1 pour les mondes en temps réel et Mini Apps pour la production publicitaire automatisée.

Tableau comparatif : Sora 2, Veo 3.1 et PixVerse V6

Les trois modèles visent le même objectif : transformer un prompt texte en une vidéo finie avec audio synchronisé. Le tableau ci-dessous les compare sur les spécifications qui comptent le plus lorsque vous choisissez un outil de génération pour un travail créatif ou de production. L’intégration entreprise, l’accès API et les cas de déploiement sont abordés dans la section dédiée à chaque modèle plus bas.

| Sora 2 | Veo 3.1 | PixVerse V6 | |

|---|---|---|---|

| Éditeur | OpenAI | PixVerse | |

| Statut | ⛔ Hors ligne depuis le 24 mars 2026 | ✅ Actif | ✅ Actif (lancé le 30 mars 2026) |

| Résolution max | 1080p (offre Pro) | 720p / 1080p / 4K | 1080p |

| Durée en une passe | Jusqu’à 12 s | 8 s | Jusqu’à 15 s |

| Moteur multi-plans | Prompting manuel | Extension séquentielle | Intégré |

| Audio natif | Parole synchronisée, effets sonores | Dialogue, effets, ambiance | Simultané au mouvement |

| Texte dans la vidéo | Limité | Limité | Multilingue, stable au mouvement |

| Contrôles cinématographiques | Basiques | Basiques | Plus de 20 paramètres d’objectif |

| Crédits quotidiens gratuits | Aucun (Pro 200 $/mois) | API payante | Oui |

| Accès développeur / API | Feuille de route API (désormais hors ligne) | API Gemini, Vertex AI | CLI + API, compatible agents |

Sora 2 a fixé la référence en matière de physique mais n’est plus disponible. Veo 3.1 domine sur les options de résolution et la portée de l’écosystème au sein de Google Cloud. PixVerse V6 offre la durée la plus longue en une seule passe, les contrôles cinématographiques les plus fins et le seul moteur multi-plans intégré des trois. Avec Sora hors ligne, le choix pratique se réduit à Veo 3.1 et PixVerse V6 — et PixVerse va plus loin avec R1 et Mini Apps, que nous détaillons plus bas.

Quel outil vidéo IA choisir en 2026 ?

Si votre objectif est un workflow standard texte vers vidéo, la vraie comparaison n’est plus Sora contre Veo contre PixVerse à égalité. Sora 2 fait partie du référentiel historique, mais la décision d’achat active se situe entre Veo 3.1 et PixVerse V6.

Choisissez Veo 3.1 si votre équipe tourne déjà dans Google Cloud, a besoin d’une intégration Gemini ou Vertex AI et privilégie les options 4K et une stack entreprise familière plutôt qu’une sortie plus longue en une seule passe.

Choisissez PixVerse V6 si vous avez besoin de jusqu’à 15 secondes en une passe, d’une génération multi-plans intégrée, de contrôles cinématographiques plus poussés et d’un workflow qui passe des tests à la production sans enchaîner plusieurs extensions de scène.

Choisissez PixVerse R1 si votre cas d’usage n’est pas un fichier vidéo fini mais un monde interactif en direct qui répond aux utilisateurs en temps réel. C’est une catégorie de produit distincte de Sora 2 et Veo 3.1.

Choisissez PixVerse Mini Apps si votre travail réel est la création automatisée de publicités à partir d’assets produit plutôt que le cinéma piloté par prompts. Dans ce cas, la comparaison pertinente est avec les workflows publicitaires traditionnels, pas seulement avec les générateurs vidéo généralistes.

Test de sortie comparatif : 3 générateurs vidéo IA

Les spécifications décrivent le potentiel. Le même prompt exécuté sur les trois outils montre comment chaque modèle se comporte réellement sous contrainte.

Prompt de test :

Un gros plan réaliste d’une abeille volant très vite dans une cuisine. La caméra utilise un angle incliné. Des meubles flous et un pot de miel cassé sur une table sont visibles. L’éclairage est doré et chaud. Il y a beaucoup de flou de mouvement.

Ce prompt a été choisi pour solliciter à la fois un sujet en mouvement rapide, le détail des matériaux (verre, miel, surfaces métalliques) et une géométrie spatiale type fisheye. Nous avons noté chaque sortie sur la cohérence spatiale, la stabilité temporelle et la précision de l’audio natif.

Sora 2

La cuisine était très réussie. Teinte chaude, profondeur cinématographique, lumière d’ambiance forte qui paraissait travaillée plutôt que procédurale. Là où Sora 2 a faibli, c’est sur la fidélité au prompt pour le sujet principal : la pièce passait avant l’abeille, présente mais sous-pondérée. Demander « très vite » produisait dans la plupart des cas une dérive à vitesse normale. Le détail cybernétique que nous avions spécifié sur l’abeille ne s’imprimait pas de façon fiable. Obtenir une prise exploitable commercialement demandait des régénérations répétées, ce qui, à 200 $ par mois, finit par coûter cher. Sora 2 restait une référence pour la narration environnementale ; pour le mouvement piloté par le sujet, il laissait du travail en suspens.

Veo 3.1

Couleur et netteté étaient convaincantes. La scène de cuisine avait une géométrie propre et une réponse matériau correcte sur les surfaces planes. Là où Veo 3.1 a manqué sa cible, c’est sur la fidélité du mouvement : l’instruction « très vite » produisait une lente dérive, pas un vol. La lecture montrait aussi un saccade notable sur notre fichier de sortie. L’audio était présent et incluait une ambiance de cuisine, mais la synchronisation avec le mouvement à l’écran semblait approximative plutôt que verrouillée. Pour un prompt qui mise sur la vitesse et l’énergie, Veo 3.1 a livré un résultat compétent mais visuellement passif.

PixVerse V6

La géométrie fisheye tenait sur toute la passe. Lorsque l’abeille se déplaçait autour des électroménagers, la distorsion d’objectif suivait la position du sujet image par image sans dériver. Le miel ambré dans le pot cassé montrait une viscosité et une réfraction de la lumière plausibles lorsque la caméra le frôlait. L’audio des battements d’ailes a été généré dans la même passe que la vidéo, et le bourdonnement suivait l’arc de vol de l’entrée à la sortie sans étape de synchro séparée. Le passage du large sur la cuisine au gros plan serré sur le pot de miel se lisait comme un mouvement continu, pas comme un collage. La stabilité temporelle tenait en 1080p sur l’intégralité des 15 secondes.

Pour les vidéos complètes issues de chaque outil et le benchmark étendu sur dix modèles, voir le générateurs vidéo IA 2026.

OpenAI Sora 2

Sora 2, générateur vidéo IA, est le modèle de génération vidéo et audio d’OpenAI, conçu pour simuler des conséquences physiques plutôt qu’à interpoler des images visuellement plausibles. Dans Sora 2, si un basketteur rate un tir, le ballon rebondit sur le panneau. Sur des modèles antérieurs, il pouvait se téléporter dans le panier. Modéliser l’échec de façon crédible, c’est ce qui distinguait Sora de tout ce qui l’avait précédé.

Capacités

Sora 2 est sorti le 30 septembre 2025 comme système généraliste vidéo et audio. Il prenait en charge jusqu’à 12 secondes par génération en 1080p sur l’offre Pro. Les mouvements complexes, des triples axels aux saltos en paddleboard et aux dialogues multi-personnages, étaient modélisés avec plus d’intégrité physique que tout outil concurrent à l’époque. L’audio était natif : parole, effets sonores et ambiance en une seule passe.

La fonctionnalité Characters permettait d’insérer une personne réelle dans une scène générée avec une ressemblance et une voix fidèles, après une vérification d’identité et de consentement unique. La cohérence multi-plans était également solide. Sora 2 pouvait suivre des instructions sur plusieurs plans tout en conservant le même environnement, la même lumière et les mêmes objets.

Limites

La sortie non déterministe était le reproche le plus fréquent. Même avec des prompts précis, les détails des personnages dérivaient. Les mains étaient peu fiables. Obtenir un rendu commercial précis demandait de nombreuses régénérations. L’offre Pro était à 200 $ par mois, et le coût par minute de sortie exploitable était assez élevé pour exclure la plupart des usages indépendants.

Arrêt

OpenAI a retiré l’application Sora et l’API le 24 mars 2026. La charge de calcul et l’examen réglementaire sur les médias synthétiques ont été les motifs invoqués. Sora 2 n’a aucun point d’accès public actif à la date de rédaction.

L’arrêt a forcé une migration immédiate pour les équipes qui s’appuyaient sur l’API Sora. Si vous avez besoin d’un outil opérationnel aujourd’hui, consultez notre guide des alternatives à Sora. Le niveau de simulation physique que Sora a imposé reste la référence à laquelle on compare chaque modèle sorti depuis.

Google Veo 3.1

Veo 3.1 est le modèle vidéo génératif de Google, disponible via l’API Gemini depuis octobre 2025 et accessible par Vertex AI, Google AI Studio, Flow et l’application Gemini.

Capacités

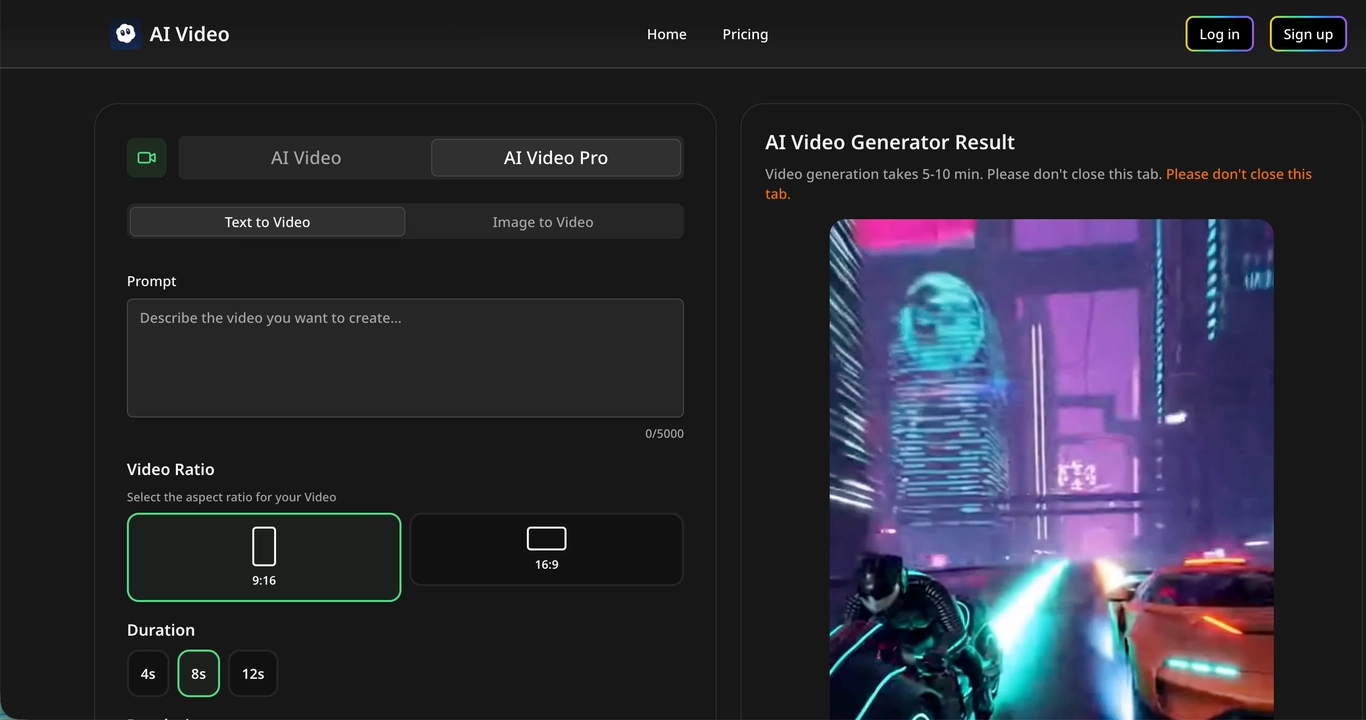

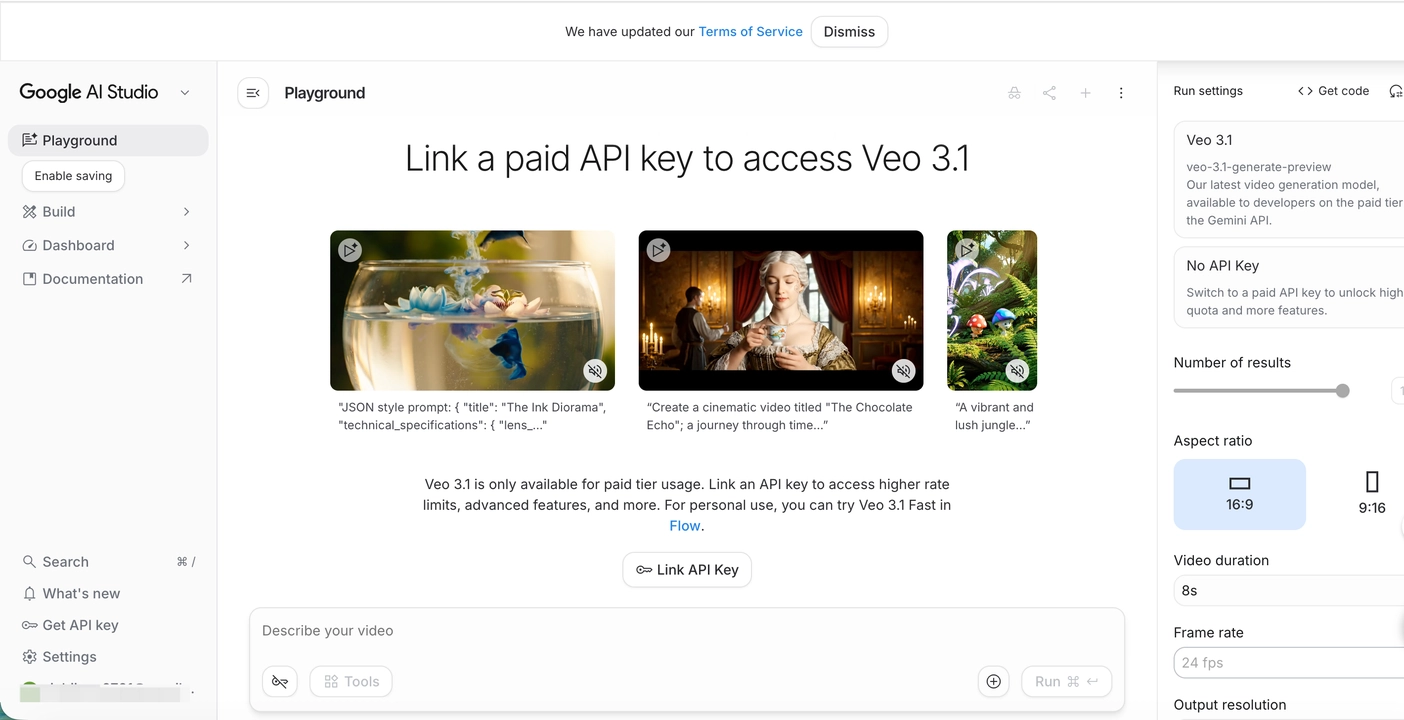

Le modèle prend en charge le 720p, le 1080p et le 4K avec des ratios 16:9 et 9:16. La durée par défaut d’un clip est de 8 secondes. L’extension de scène permet d’enchaîner des clips en séquences de plus d’une minute, chaque nouveau clip reprenant la dernière seconde du précédent.

L’audio s’est nettement amélioré par rapport aux versions antérieures de Veo. Dialogue, effets sonores et ambiance sont générés dans la même passe que la vidéo.

Ingredients to Video accepte jusqu’à trois images de référence et ancre l’identité des personnages ou le style de la scène sur plusieurs générations. Cela réduit les itérations de prompt pour les marques ou les productions qui disposent déjà d’assets visuels.

Le contrôle première et dernière image permet de définir une image de début et de fin ; Veo 3.1 génère la transition entre elles, avec audio.

Accès

Veo 3.1 est disponible via l’API Gemini (Google AI Studio, Vertex AI) et les surfaces grand public, dont l’application Gemini, Flow et YouTube Shorts. L’accès entreprise via Vertex AI inclut la gouvernance des données et des structures de SLA. Les équipes déjà sur Google Cloud ont le chemin d’intégration le plus court.

Limites

Les clips par défaut de 8 secondes sont courts. Les contenus narratifs plus longs exigent un prompting séquentiel volontaire via l’extension de scène, ce qui diffère d’une génération en une passe avec logique multi-plans intégrée. Les équipes hors écosystème Google Cloud supportent un surcoût d’intégration réel.

PixVerse

Sora et Veo sont des produits à modèle unique. PixVerse en propose trois : V6 pour la génération vidéo cinématographique, R1 pour les mondes interactifs temps réel, et Mini Apps pour la production vidéo commerciale automatisée. Chacun répond à une étape différente du pipeline de contenu.

Pour une comparaison équivalente avec Sora 2 et Veo 3.1, PixVerse V6 est la contrepartie directe. R1 et Mini Apps comptent lorsque la décision dépasse la génération standard prompt vers vidéo pour couvrir des expériences en temps réel ou des workflows commerciaux automatisés.

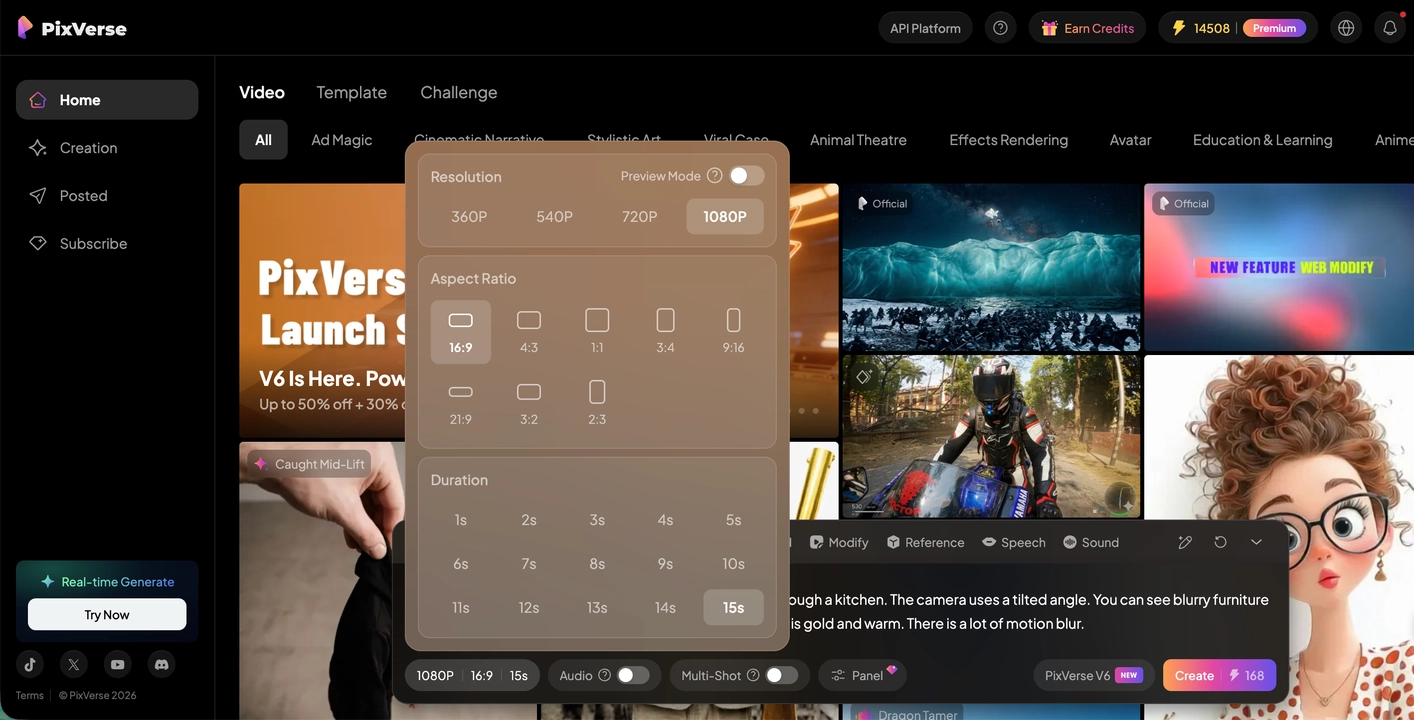

PixVerse V6

PixVerse V6 compte parmi les meilleurs générateurs vidéo IA ; il est sorti le 30 mars 2026 pour produire des clips longs et cohérents en une seule passe, sans collage.

Basé sur une architecture Diffusion Transformer, V6 génère jusqu’à 15 secondes en 1080p en une passe. La plupart des modèles en 1080p fragmentent vers 5 à 8 secondes. V6 conserve plus régulièrement la stabilité temporelle sur toute la génération.

L’audio natif est généré en même temps que la vidéo, et non superposé après coup. Le moteur multi-plans gère les transitions de scène avec un état de monde partagé : un plan d’ensemble large peut enchaîner sur un gros plan serré sans que la lumière ou les matériaux ne dérivent entre les coupes.

Le texte dans la vidéo prend en charge le rendu multilingue. Le texte à l’écran conserve les formes des caractères au fil du mouvement, ce qui lève une contrainte durable pour les marques qui mènent des campagnes localisées.

V6 embarque plus de 20 paramètres d’objectif cinématographiques : focale, ouverture, profondeur de champ, aberration chromatique et vignettage. Les définir avant la génération donne aux réalisateurs une marge de manœuvre au-delà d’un simple réglage de style générique.

Là où V6 se distingue des modèles PixVerse précédents, c’est dans la simulation physique. Texture de peau, tension musculaire en mouvement, gravité, viscosité et élasticité suivent de façon plus crédible. Les séquences de combat portent un impact visible. Les plans effets spéciaux comme le bullet time, le time-lapse et le rack focus réussissent désormais souvent sans lourd travail de prompt.

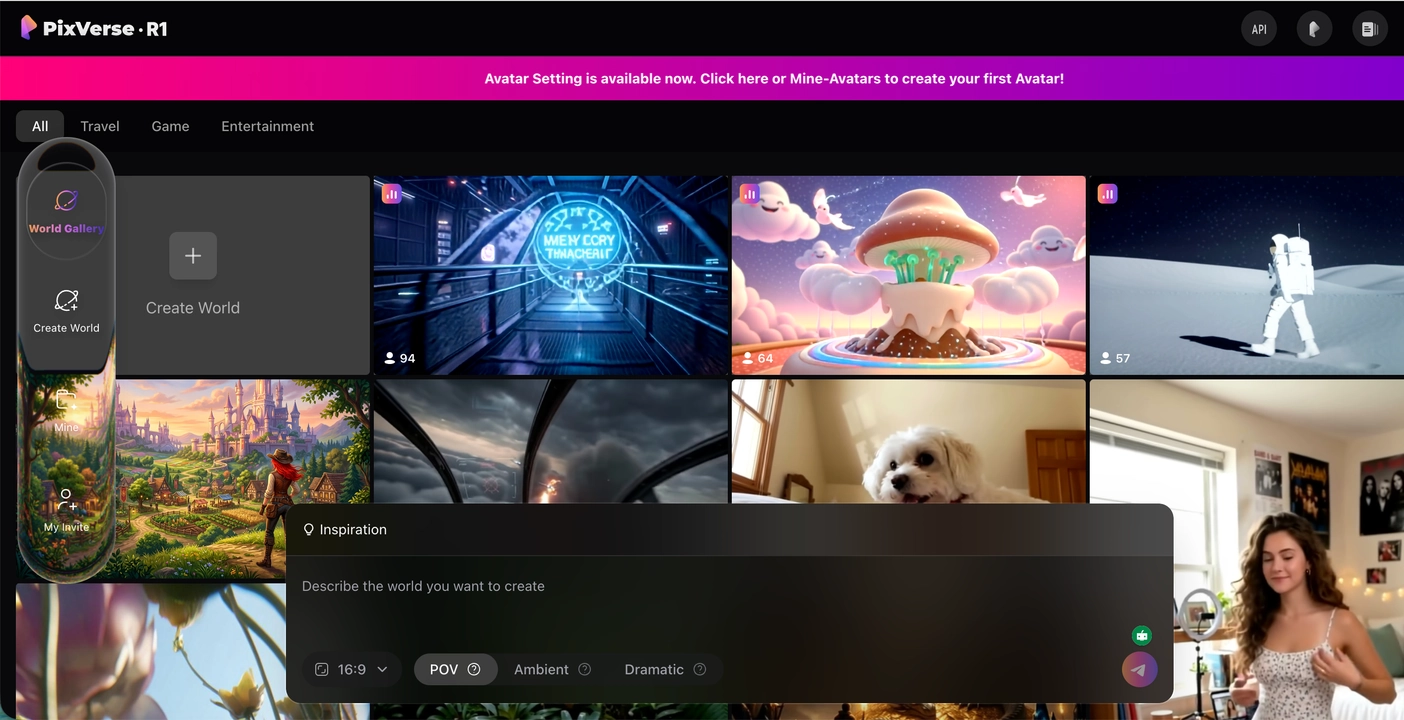

PixVerse R1

PixVerse R1 est le modèle de monde temps réel de PixVerse, lancé en janvier 2026 et mis à jour en avril 2026 avec des mondes partagés multi-utilisateurs. Là où V6 produit un fichier vidéo fini, R1 génère un environnement visuel persistant et interactif qui réagit aux actions de l’utilisateur en temps réel.

Le socle technique combine trois éléments : un modèle de fondation omnimodal natif qui traite texte, image, vidéo et audio comme un flux de tokens unifié ; un cadre autorégressif sensible à la cohérence qui maintient la cohérence temporelle sur de longs horizons ; et un moteur de réponse instantanée qui atteint une latence de l’ordre de la milliseconde en 1080p.

La mise à jour d’avril 2026 a introduit les Mondes partagés : des diffusions interactives en direct, continues 24h/24 et 7j/7, où plusieurs utilisateurs envoient des prompts dans un flux commun. L’IA prend les prompts et génère le contenu visuel correspondant en direct, tandis qu’une couche de chat intégrée permet aux spectateurs d’interagir en parallèle du flux. Cela se rapproche davantage d’une chaîne Twitch multijoueur que d’un outil de génération classique.

Les avatars personnalisés permettent de téléverser des photos (face, profil, dos) pour créer une représentation numérique qui bouge, s’anime et se déplace entre différents mondes.

Remarque : les Mondes partagés R1 et les avatars personnalisés sont désormais en ligne et gratuits sur realtime.pixverse.ai. D’autres fonctionnalités R1, dont l’élargissement des types de mondes et la personnalisation avancée des avatars, sont en développement actif.

Aucune plateforme concurrente d’OpenAI ou de Google ne propose aujourd’hui un produit comparable de génération de mondes interactifs en temps réel. R1 occupe une catégorie que Sora 2 et Veo 3.1 ne couvrent pas.

Mini Apps

Mini Apps est la suite d’outils PixVerse dédiés à des scénarios précis, bâtie sur ses modèles de génération, conçue pour compresser des workflows de production complets en opérations en une étape.

Le premier Mini App, Ad Master, est un générateur vidéo publicitaire IA, lancé le 31 mars 2026. Il prend une image produit et une courte description, puis génère une vidéo publicitaire complète avec composition de scène, casting visuel, voix off et sous-titres.

Pour les équipes e-commerce et les PME qui ne peuvent pas justifier un pipeline de production pour chaque référence, Ad Master comble l’écart entre une photo produit et une publicité vidéo prête à diffuser.

Remarque : Ad Master est en ligne sur app.pixverse.ai/mini-apps. D’autres Mini Apps couvrant la narration visuelle, le format court et l’audio sont en développement. La suite Mini Apps devrait s’élargir tout au long de 2026.

Les modèles PixVerse en bref

| V6 | R1 | Mini Apps (Ad Master) | |

|---|---|---|---|

| Rôle | Génération vidéo cinématographique | Mondes interactifs temps réel | Vidéo commerciale automatisée |

| Sortie | Fichier vidéo fini (jusqu’à 15 s 1080p) | Flux visuel en direct persistant (1080p) | Vidéo publicitaire complète avec voix off |

| Entrée | Prompt texte ou image de référence | Prompt texte (temps réel, multi-utilisateur) | Image produit + description |

| Audio | Natif, synchronisé au mouvement | Génération d’ambiance temps réel | Voix off et sous-titres auto-générés |

| Interaction | Générer, relire, itérer | Temps réel, partagé, continu | Automatisée en une étape |

| Idéal pour | Cinéastes, agences, développeurs | Engagement communautaire, expériences interactives | E-commerce, PME, marketing performance |

| Tarification | Crédits quotidiens gratuits + abonnements | Accès gratuit | ~3 $/vidéo (2 $ pour les abonnés) |

Benchmarks

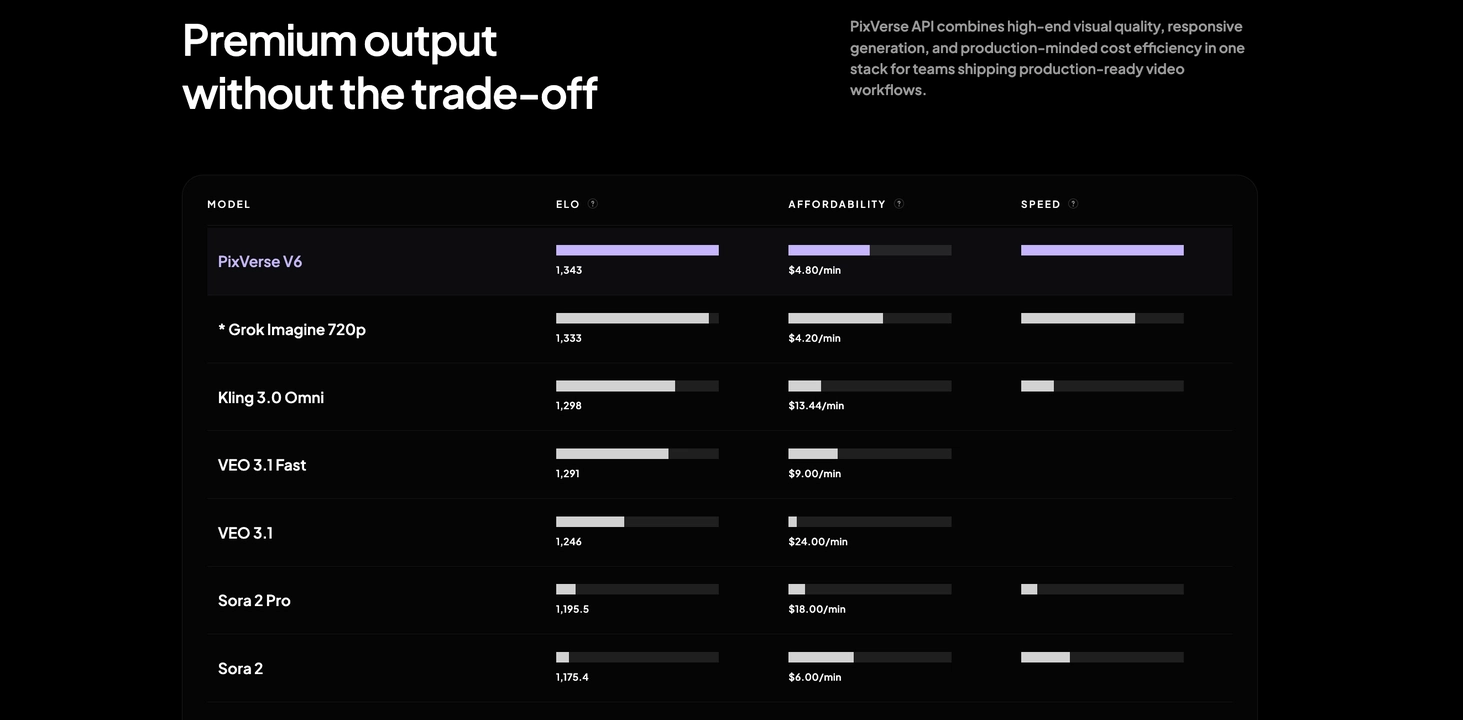

Le classement évalue les modèles selon le score ELO, le rapport qualité-prix et la vitesse. PixVerse V6 arrive en tête avec un ELO de 1 343 à 4,80 $/min. Veo 3.1 Fast obtient 1 291 à 9,00 $/min ; le Veo 3.1 standard se situe à 1 246 pour un coût plus élevé de 24,00 $/min. Sora 2 Pro atteint 1 195,5 à 18,00 $/min, et Sora 2 standard 1 175,4 à 6,00 $/min. PixVerse V6 domine également la catégorie vitesse avec une marge visible. Parmi les trois plateformes comparées dans cet article, PixVerse V6 se classe au premier rang en qualité, coûte moins cher par minute que les deux versions de Veo 3.1 et Sora 2 Pro, et génère plus rapidement.

Cas entreprise

Runware est une plateforme mondiale d’inférence IA qui sert plus de 200 000 développeurs via une API unifiée pour la génération d’images, de vidéos et d’audio. Lorsque l’entreprise s’est étendue à la vidéo, elle avait besoin d’un modèle capable de tourner à des tarifs d’infrastructure, avec une latence d’inférence inférieure à la seconde et la tenue sous des exigences de compatibilité multi-modèles via API. PixVerse V6 a dépassé ce seuil. Runware a intégré PixVerse dans sa pile API via le Sonic Inference Engine, permettant le texte vers vidéo et l’image vers vidéo à 0,29 $ par génération, soit une réduction de 62 % par rapport au marché, avec un chargement de modèle en moins d’une seconde. Pour les clients développeurs de Runware, une vidéo de qualité production est désormais appelable via la même API que pour les images, sans intégration ni palier tarifaire séparé.

Perfect Corp (NYSE: PERF) est l’éditeur de la suite d’applications YouCam, avec 1,1 milliard de téléchargements et des outils beauté au service de L’Oréal, Estée Lauder, Tom Ford et plus de 400 marques premium dans 67 pays. L’entreprise avait besoin d’une couche de génération vidéo pour alimenter la création d’avatars IA, la visualisation d’effets beauté et l’automatisation de contenus produit dans l’interface YouCam. L’API PixVerse a été intégrée à l’éditeur YouCam en ligne : les utilisateurs téléversent une photo ou saisissent un prompt, et PixVerse assure la génération vidéo dans l’espace de travail YouCam. Les consommateurs peuvent passer d’une photo produit à une vidéo finie et partageable montrant un look beauté sans quitter l’application. Pour des marques comme L’Oréal, cela fournit des contenus produit avec la qualité visuelle exigée par le retail et l’e-commerce mondiaux, au rythme d’une campagne digitale.

Accès développeur

V6 et Mini Apps sont disponibles sur la plateforme web. V6 propose aussi une CLI qui s’intègre aux agents de code, dont Claude Code, Codex et Cursor, avec accès multi-modèles à PixVerse V6, Veo 3.1 et Grok depuis un seul npm install. Les pipelines de production peuvent appeler l’API PixVerse comme étape automatisée sans workflow graphique séparé. Voir le guide CLI PixVerse pour l’installation.

R1 est accessible sur realtime.pixverse.ai. L’accès API à R1 est disponible via le programme partenaires PixVerse R1.

Usage commercial et adéquation opérationnelle

Pour les équipes qui évaluent ces outils pour une production rémunérée, la décision ne repose pas seulement sur la qualité du rendu. Elle porte aussi sur le chemin d’accès, le modèle tarifaire, le coût d’itération, le workflow de déploiement et la capacité du produit à correspondre clairement au besoin réel.

Veo 3.1 est le plus adapté lorsque les achats, la gouvernance et le déploiement sont déjà dans la stack Google. PixVerse V6 est plus pertinent lorsque le goulot est une sortie cohérente plus longue, un contrôle cinématographique ou une itération plus fluide du prompt au clip final. PixVerse R1 et Mini Apps deviennent pertinents lorsque l’exigence commerciale est l’interaction audience en temps réel ou l’automatisation produit vers publicité plutôt que la génération vidéo générale. Dans tous les cas, les équipes doivent confirmer les conditions d’usage commercial, de modération et de traitement des données auprès de la plateforme cible.

Où chaque outil trouve sa place

Clips sociaux courts : la sortie 8 secondes de Veo 3.1 et le format vertical 9:16 couvrent la plupart des besoins de contenu social avec peu de friction de prompt. PixVerse V6 gère les mêmes formats sur 15 secondes lorsque l’histoire a besoin d’air. Sora 2 est hors ligne.

Vidéo hero de campagne : lorsque l’asset doit durer 12 à 15 secondes avec un éclairage produit cohérent sur une séquence de plans, la longueur en une passe de V6 et son moteur multi-plans intégré réduisent le coût d’itération par rapport à l’extension séquentielle de Veo. Les deux produisent un rendu professionnel ; la différence tient au volume de prompting manuel entre les plans.

Récit multi-plans : l’extension de scène et le support d’images de référence de Veo 3.1 gèrent les séquences plus longues. Le moteur multi-plans de V6 gère des coupes cohérentes sur les personnages en une seule génération et demande moins d’itérations de collage pour une narration structurée.

Production automatisée à grand volume : V6 via la CLI et l’API PixVerse, déployé à l’échelle sur la plateforme développeur Runware, convient aux équipes qui intègrent la génération vidéo dans des pipelines automatisés. Veo 3.1 via Vertex AI convient aux équipes déjà sur Google Cloud. L’API Sora 2 est hors ligne.

E-commerce et pubs produit : PixVerse Mini Apps (Ad Master) est conçu pour cela. Téléversez une image produit, obtenez une vidéo publicitaire finie avec voix off et sous-titres pour 2 à 3 $. Ni Sora 2 ni Veo 3.1 n’offrent un pipeline produit vers pub en une étape.

Expériences interactives et engagement communautaire : les mondes partagés de PixVerse R1 créent un format à part entière : génération multi-utilisateurs, temps réel et persistante. Il n’y a pas de comparaison directe avec Sora ou Veo. L’analogie la plus proche est un flux Twitch en direct dont le contenu est généré par IA à partir des prompts du public.

Beauté, retail et visualisation produit : le rendu photoréaliste de V6, le mapping stable des visages et le texte multilingue dans la vidéo sont le socle technique sur lequel Perfect Corp a bâti sa suite vidéo YouCam. Veo 3.1 offre une qualité visuelle comparable mais ne dispose pas d’un déploiement de référence entreprise équivalent dans cette catégorie.

FAQ

Sora est-il encore disponible ?

À compter du 24 mars 2026, l’application Sora et l’API d’OpenAI sont hors ligne. Il n’existe pas de point d’accès public actif pour Sora 2.

Comment Veo 3.1 se compare-t-il à PixVerse V6 pour des contenus plus longs ?

La sortie par défaut de Veo 3.1 est de 8 secondes ; l’extension de scène dépasse une minute mais exige un prompting séquentiel. V6 génère jusqu’à 15 secondes en une passe avec logique multi-plans intégrée. V6 convient mieux lorsque l’asset exige une structure narrative entre les plans ; Veo 3.1 est plus rapide pour des clips individuels de haute qualité.

Qu’est-ce que PixVerse R1 ?

R1 est le modèle de monde temps réel de PixVerse. Au lieu de produire un fichier vidéo fini, il crée un environnement visuel persistant et interactif qui réagit aux prompts utilisateur en temps réel. La mise à jour d’avril 2026 a ajouté des mondes partagés multi-utilisateurs et des avatars personnalisés. L’accès est gratuit sur realtime.pixverse.ai.

Puis-je utiliser ces outils pour une production commerciale ?

L’usage commercial dépend du niveau produit actuel, des conditions API, des règles de modération et des politiques régionales de chaque plateforme. Avant de diffuser des campagnes payantes ou du travail client, les équipes doivent vérifier les droits d’usage et le traitement des données en vigueur directement auprès d’OpenAI, Google et PixVerse.

Quel générateur vidéo IA tester en premier ?

Pour la génération vidéo, évitez les prompts de démonstration. Faites passer un vrai brief dans Veo 3.1 et PixVerse V6. Notez chaque outil sur la précision de la synchro audio, la cohérence entre plans et le nombre d’itérations pour obtenir un résultat exploitable. Pour l’e-commerce, essayez Ad Master avec une photo produit et comparez le délai de sortie à votre workflow actuel.

Conclusion

Sora 2 était techniquement le modèle vidéo le plus abouti de 2025. Il est aussi hors ligne. Ce qu’il laisse est une référence de simulation physique. Ni Veo 3.1 ni PixVerse V6 n’ont pleinement égalé sa cohérence de monde à son pic de performance.

Veo 3.1 est la réponse active de Google : vidéo courte soignée avec audio natif, intégration étroite à l’écosystème et accès API de niveau développeur. Il convient aux équipes qui opèrent déjà sur Google Cloud et ont besoin de sorties fiables de 8 secondes à l’échelle.

PixVerse est la plateforme plus large. V6 porte la couche de comparaison directe avec une sortie en une passe plus longue et un moteur multi-plans intégré. R1 introduit la génération de mondes interactifs temps réel que ni Sora ni Veo n’ont abordée. Mini Apps compresse toute une production publicitaire en un seul téléversement. Les déploiements Runware et Perfect Corp montrent comment V6 fonctionne à l’échelle de l’infrastructure ; R1 et Mini Apps étendent la plateforme vers des domaines où la comparaison n’est pas Sora ou Veo, mais les pipelines de production classiques.

Le choix actif pour la génération vidéo standard se situe entre Veo 3.1 et PixVerse V6. Pour du contenu interactif temps réel ou de la vidéo commerciale automatisée, PixVerse opère aujourd’hui sans concurrent direct de la part d’OpenAI ou de Google.