Sora vs. Veo vs. PixVerse: guía profesional 2026 para stacks de video con IA

En marzo de 2026 Sora 2 dejó de estar disponible. Guía sobre el legado de Sora y rutas de acceso a Veo 3.1; PixVerse V6 y notas breves sobre R1 y Mini Apps.

Sora 2 dejó de estar en línea el 24 de marzo de 2026. OpenAI citó costes de cómputo y presión regulatoria. Ambos factores contribuyeron a lo que lo convirtió en un referente de categoría y, al final, en algo insostenible. Tres semanas después se lanzó PixVerse V6. Google ya había lanzado Veo 3.1 en octubre de 2025.

En seis meses, el stack de video con IA se reorganizó. Una herramienta cayó. Otras dos pasaron a producción. Este artículo dedica más espacio a Sora 2 (histórico) y Veo 3.1 (lo que Google ofrece hoy) que a cualquier resumen de un solo proveedor, y resume PixVerse en el mismo marco comparativo: V6 para paridad directa texto‑a‑video, más notas breves sobre R1 y Mini Apps cuando tu trabajo no es un clip puntual.

Cómo lo abordamos: Donde las herramientas seguían disponibles, ejecutamos el mismo prompt de prueba en cada una y describimos lo que vimos. Los ejemplos de clientes ilustran cómo los equipos integran un modelo en un pipeline, no una promesa de que tus resultados serán iguales a los suyos.

Ideas clave (abril de 2026)

- Sora 2 ya no tiene app pública ni API; trátalo como una era de referencia para generación con física exigente y planifica una migración si aún tienes flujos al estilo Sora.

- Veo 3.1 es la vía activa de Google: encaja bien en el ecosistema si ya trabajas en Gemini, Vertex AI o entregas tipo Shorts; los clips por defecto duran 8 segundos, y la extensión de escena es la forma principal de alargar la duración.

- PixVerse V6 es la opción paralela para clips más largos en un solo pase, multi‑plano dentro de la toma y un control a nivel de óptica más profundo: evalúalo frente a Veo con tus propios briefs, no solo con los nuestros.

- R1 (mundos en tiempo real) y Mini Apps (p. ej. producto‑a‑anuncio) solo importan si tu requisito no es un archivo de video descargable estándar: salta a esas subsecciones si es tu caso.

Respuesta rápida: Para trabajo ordinario de texto a video hoy, la elección en producción es Veo 3.1 o PixVerse V6. Elige Veo cuando la compra en Google Cloud, Gemini o la integración con Vertex ya define tu stack. Elige PixVerse V6 cuando quieras salida más larga en un solo pase, multi‑plano integrado en una generación y parámetros de cámara más directos; añade R1 o Mini Apps solo si tu caso de uso encaja con lo que hacen esos productos.

Tabla comparativa: Sora 2, Veo 3.1 y PixVerse V6

Los tres modelos apuntan al mismo objetivo: convertir un prompt de texto en un video terminado con audio sincronizado. La tabla siguiente los compara en los aspectos que más importan al elegir una herramienta de generación para trabajo creativo o de producción. La integración empresarial, el acceso por API y los casos de despliegue se tratan en la sección dedicada a cada modelo más abajo.

| Sora 2 | Veo 3.1 | PixVerse V6 | |

|---|---|---|---|

| Desarrollador | OpenAI | PixVerse | |

| Estado | ⛔ Fuera de línea desde el 24 de marzo de 2026 | ✅ Activo | ✅ Activo (lanzado el 30 de marzo de 2026) |

| Resolución máxima | 1080p (nivel Pro) | 720p / 1080p / 4K | 1080p |

| Duración en un solo pase | Hasta 12s | 8s | Hasta 15s |

| Motor multi‑plano | Prompting manual | Extensión secuencial | Integrado (una sola generación) |

| Audio nativo | Voz, efectos y ambiente sincronizados | Diálogo, efectos y ambiente | Generado con el movimiento en un solo pase |

| Texto en el video | Limitado | Limitado | Multilingüe, estable con el movimiento |

| Controles cinematográficos | Básicos | Básicos | Más de 20 parámetros de óptica |

| Créditos diarios gratis | Ninguno (Pro 200 $/mes) | API de pago | Sí (según la plataforma) |

| Acceso para desarrolladores / API | Hoja de ruta de API (ahora fuera de línea) | Gemini API, Vertex AI | CLI + API, compatible con agentes |

Sora 2 marcó un referente orientado a la física pero ya no está disponible. Veo 3.1 destaca en opciones de resolución (hasta 4K) y en el encaje para equipos estandarizados en Google. PixVerse V6 enfatiza mayor duración en un solo pase, multi‑plano dentro de una generación y controles finos de óptica a 1080p. Con Sora fuera de línea, la mayoría de compradores comparan Veo 3.1 y PixVerse V6 para flujos basados en archivo; R1 y Mini Apps son formas de producto distintas y se resumen más adelante.

Qué herramienta de video con IA elegir en 2026

Si tu objetivo es un flujo estándar de texto a video, la comparación real ya no es Sora frente a Veo frente a PixVerse en igualdad de condiciones. Sora 2 forma parte del referente histórico, pero la decisión de compra activa es entre Veo 3.1 y PixVerse V6.

Elige Veo 3.1 si tu equipo ya opera dentro de Google Cloud, necesita integración con Gemini o Vertex AI y valora más las opciones 4K y un stack empresarial familiar que una salida más larga en un solo pase.

Elige PixVerse V6 si necesitas hasta 15 segundos en un pase, generación multi‑plano integrada, controles cinematográficos más fuertes y un flujo que pueda pasar de pruebas a producción sin encadenar varias extensiones de escena.

Elige PixVerse R1 si tu caso de uso no es un archivo de video terminado sino un mundo interactivo en vivo que responde a los usuarios en tiempo real. Es una categoría de producto distinta tanto de Sora 2 como de Veo 3.1.

Elige PixVerse Mini Apps si tu trabajo real es la creación automatizada de anuncios a partir de activos de producto y no el cine basado en prompts. En ese caso, la comparación relevante es frente a flujos tradicionales de producción publicitaria, no solo frente a generadores de video genéricos.

Prueba de salida cara a cara: 3 generadores de video con IA comparados

Las especificaciones describen el potencial. El mismo prompt ejecutado en las tres herramientas muestra cómo se comporta cada modelo bajo presión.

Prompt de prueba:

Un primer plano realista de una abeja volando muy rápido por una cocina. La cámara usa un ángulo inclinado. Se ven muebles borrosos y un frasco de miel roto sobre una mesa. La iluminación es dorada y cálida. Hay mucho desenfoque por movimiento.

El prompt se eligió para estresar tres cosas a la vez: movimiento rápido del sujeto, detalle de materiales (vidrio, miel, superficies metálicas) y geometría espacial tipo ojo de pez. Puntuamos cada salida por coherencia espacial, estabilidad temporal y precisión del audio nativo.

Sora 2

La cocina se veía magnífica. Gradación cálida, profundidad cinematográfica, luz ambiente fuerte que parecía pensada y no procedural. Donde Sora 2 fallaba era en la fidelidad al prompt en el sujeto principal. La habitación tenía prioridad; la abeja estaba presente pero con poco peso. Pedir «muy rápido» generaba en la mayoría de los casos un desplazamiento a velocidad normal. El detalle cibernético que especificamos en la abeja no se reflejaba de forma fiable. Obtener una toma usable comercialmente exigía regeneraciones repetidas, lo que a 200 $/mes se acumula rápido. Sora 2 siguió siendo un referente para narrativa ambiental; para movimiento guiado por el sujeto, dejaba trabajo pendiente.

Veo 3.1

El color y la nitidez funcionaron bien. La escena de la cocina tenía geometría limpia y respuesta de materiales precisa en superficies planas. Donde Veo 3.1 falló fue en la fidelidad del movimiento: la instrucción «muy rápido» produjo un desplazamiento lento, no vuelo. La reproducción también mostró tirones notables en nuestro archivo de salida. El audio estaba presente e incluía tono ambiente de cocina, pero la sincronía con el movimiento en pantalla parecía aproximada y no cerrada. Para un prompt que apuesta mucho por velocidad y energía, Veo 3.1 ofreció un resultado competente pero visualmente pasivo.

PixVerse V6

La geometría tipo ojo de pez se mantuvo durante todo el pase. Al moverse la abeja entre electrodomésticos, la distorsión de la óptica siguió la posición del sujeto fotograma a fotograma sin desviarse. La miel ámbar del frasco roto mostró viscosidad y refracción de la luz plausibles al pasar la cámara. El audio del batir de alas se generó en el mismo pase que el video, y el zumbido siguió el arco del vuelo de la entrada a la salida sin un paso de sincronía aparte. El corte de cocina amplia a macro cerrado sobre el tarro de miel se leyó como un movimiento continuo, no como un encaje. La estabilidad temporal se mantuvo a 1080p durante los 15 segundos completos.

Para el video completo de cada herramienta y el benchmark ampliado en 10 modelos, consulta 2026 AI Video Generator.

OpenAI Sora 2

Sora 2 era el modelo de generación de video y audio de OpenAI: pretendía simular consecuencia física (un tiro de baloncesto fallado rebota en el tablero) en lugar de solo interpolar fotogramas plausibles. Ese encuadre importaba para cómo los equipos juzgaban el «realismo» en 2025: menos como pulido y más como consecuencia.

Capacidades

Sora 2 se lanzó el 30 de septiembre de 2025 como sistema de propósito general. En el nivel Pro admitía hasta 12 segundos a 1080p. El movimiento complejo (deportes, acrobacias, diálogo entre varios personajes) a menudo mostraba mayor plausibilidad física que las herramientas consumer anteriores. El audio era nativo en un solo pase: voz, efectos y ambiente juntos.

El flujo Characters permitía a usuarios aprobados colocar a una persona real en una escena con parecido y voz tras pasos de identidad y consentimiento. El comportamiento multi‑plano podía mantener entorno e iluminación entre cortes cuando el prompt pedía continuidad.

Dónde fallaba en la práctica

Sora 2 no era determinista. Los prompts precisos seguían desviándose en rostros, vestuario y objetos pequeños; manos y manipulación fina eran puntos de fallo frecuentes. Los equipos que buscaban una actuación de sujeto muy concreta solían pagar en volumen de regeneraciones: el precio Pro de 200 $/mes importaba menos que el impuesto por iteración: muchos pases para llegar a un clip entregable. Los briefs que exigían movimiento rápido del sujeto más detalle fino (nuestra prueba de la abeja entra en esa familia) eran especialmente propensos a consumir presupuesto sin garantía de resultado.

Cierre y quién tuvo que moverse

OpenAI retiró la app y la API de Sora el 24 de marzo de 2026, citando coste de cómputo y presión en torno a medios sintéticos. En el momento de escribir esto no hay endpoint público para Sora 2.

El impacto fue desigual: las integraciones por API y flujos de trabajo se rompieron por completo; los usuarios de suscripción perdieron una herramienta de producción de un día para otro; los equipos que usaban Characters o distribución tipo redes sociales tuvieron que sustituir supuestos de generación y de cumplimiento. Para un mapa práctico de sustitución, consulta alternativas a Sora.

Cómo plantear la migración (sin favorecer a un proveedor)

No estás eligiendo «el siguiente Sora». Estás alineando restricciones: ¿Necesitas compra en el ecosistema Google y clips cortos a escala? ¿Gobernanza tipo Vertex? ¿Archivos más largos en un solo pase? ¿Automatización producto‑a‑anuncio? Ordena esas prioridades y ejecuta tus propios prompts en listas cortas: nuestra prueba cara a cara es un dato, no un ranking universal.

Históricamente, Sora 2 fijó una referencia de narrativa con física contra la que aún se miden modelos posteriores, incluso cuando difieren en precio, acceso o riesgo de cierre.

Google Veo 3.1

Veo 3.1 es el modelo generativo de video de Google para convertir prompts (y algunas anclas visuales) en clips cortos con audio nativo. A través de la Gemini API (desde octubre de 2025) se conecta a Google AI Studio, Vertex AI y superficies de consumo como Flow, la app Gemini y YouTube Shorts, así que «Veo» puede significar desde una prueba rápida en app hasta un despliegue empresarial gobernado.

Capacidades

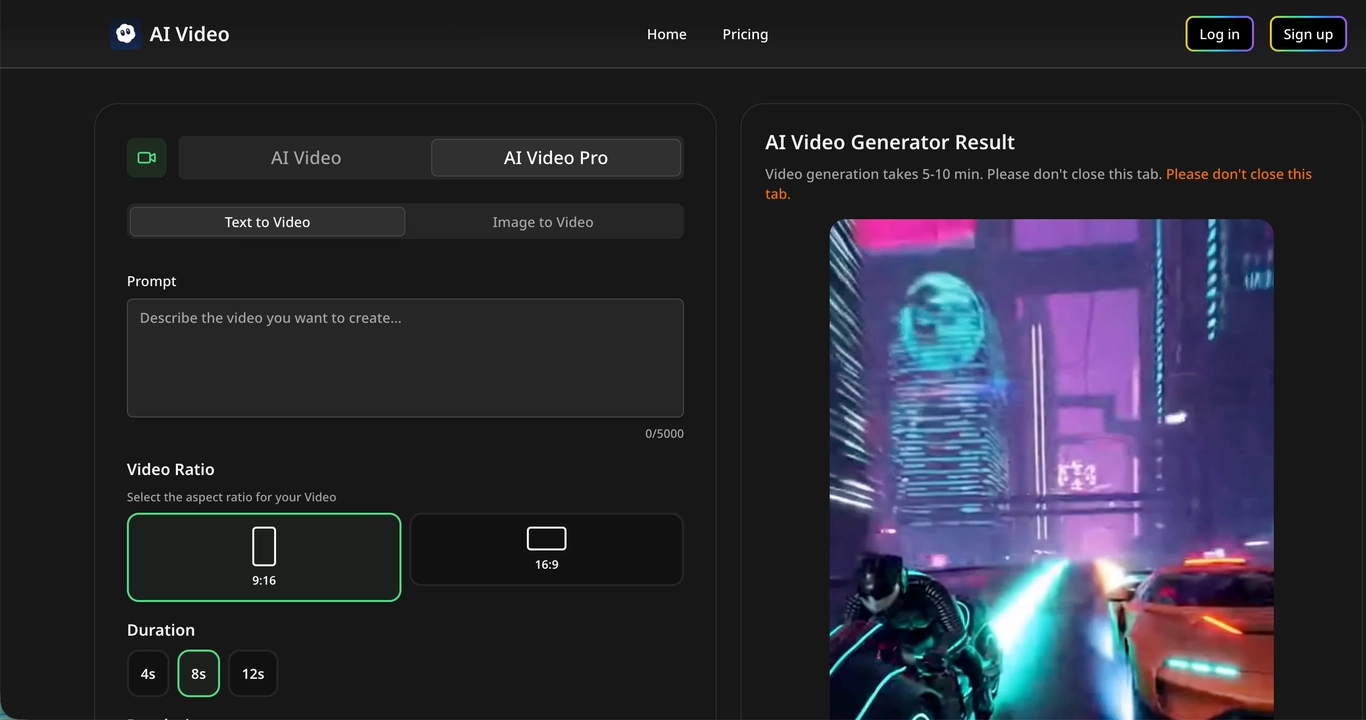

Veo 3.1 admite 720p, 1080p y 4K con 16:9 y 9:16. La generación por defecto son 8 segundos: encaja bien con ritmos tipo Shorts e iteración rápida, pero es una restricción estructural para piezas más narrativas.

La extensión de escena es la forma principal de ir más allá: cada nuevo segmento puede continuar desde el último fotograma del clip anterior, de modo que son posibles ejecuciones de más de un minuto como cadena de prompts y revisiones, no como un pase ininterrumpido. Ese patrón favorece a equipos cómodos storyboardeando, controlando calidad y volviendo a promptear entre segmentos.

Ingredients to Video (hasta tres imágenes de referencia) ayuda a fijar look o identidad entre generaciones, útil cuando ya existen activos de marca. El control de primer y último fotograma apunta a transiciones controladas entre dos fotos fijas, con audio en la misma generación.

El audio (diálogo, efectos, ambiente) va con el video. En nuestra prueba de la abeja el sonido estaba presente, pero la sincronía paso a paso con el movimiento más rápido en pantalla no siempre era convincente: conviene validarlo con tus propios prompts de mucha acción.

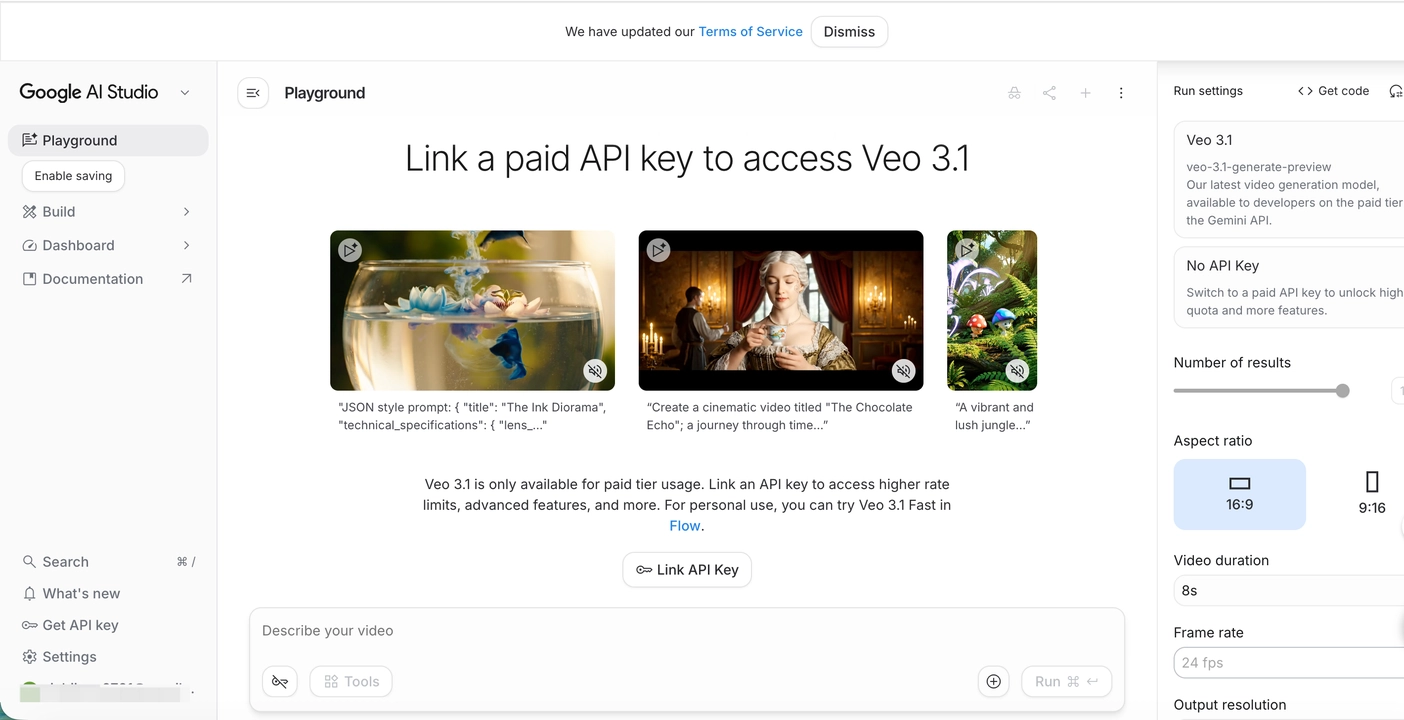

Rutas de acceso y qué implican

No todos los puntos de entrada son intercambiables:

- Las apps de consumo (Gemini / Flow / Shorts) son la vía más rápida para probar salida tipo Veo; términos, límites de tasa y rutas de exportación difieren del uso por API.

- Google AI Studio / Gemini API encaja con desarrolladores que prototipan sobre el stack de Google.

- Vertex AI es la ruta empresarial: el tratamiento de datos, la facturación y los ganchos de gobernanza importan cuando legal o compras ya están estandarizados en Google Cloud.

Si tu organización no encamina ya la producción por Google, presupuesta tiempo de ingeniería para autenticación, facturación y revisión de políticas, no solo calidad del modelo.

Limitaciones

Los ocho segundos por defecto significan que las narrativas más largas son un problema de diseño de flujo: la extensión de escena funciona, pero no es el mismo modelo operativo que multi‑plano dentro de una generación. Los equipos que necesitan un archivo con cortes internos estructurados pueden preferir que esa distinción quede explícita en la evaluación.

Fuera del ecosistema Google, la sobrecarga de integración es real: no solo eliges un modelo, eliges cómo encaja el video con almacenamiento, identidad y herramientas de cumplimiento que ya pagas.

PixVerse

OpenAI y Google ofrecen cada uno un generador de video principal en esta historia (Sora 2 históricamente, Veo 3.1 hoy). PixVerse agrupa V6 para el mismo trabajo basado en archivo, y añade R1 (mundos en vivo) y Mini Apps (herramientas de escenario como Ad Master), útiles cuando tu flujo no es un solo clip renderizado.

Consejo de alcance: Si solo comparas exportaciones texto‑a‑video, lee V6 y Benchmarks; trata R1 y Mini Apps como complementos opcionales cuando importe interacción en vivo o rendimiento producto‑a‑anuncio.

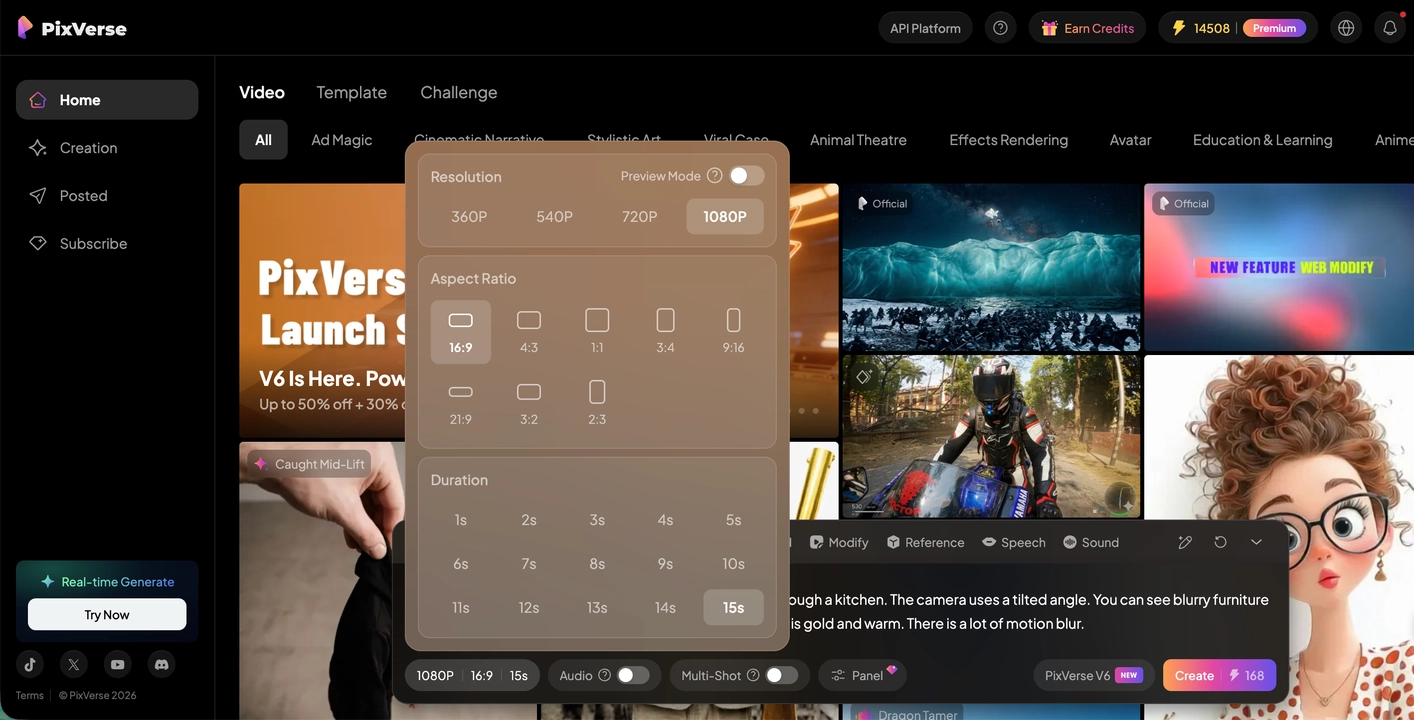

PixVerse V6

PixVerse V6 (30 de marzo de 2026) es el homólogo directo en PixVerse de la generación descargable al estilo Sora o Veo. Para contexto con diez modelos más allá de este artículo tripartito, consulta 2026 AI Video Generator. Apunta a hasta 15 segundos a 1080p en un solo pase, con un motor multi‑plano que mantiene el estado compartido del mundo entre cortes internos (de plano general a macro sin tratar cada corte como generación nueva). El audio nativo se genera con el movimiento; el texto en video admite varios idiomas; más de 20 parámetros de óptica (distancia focal, apertura, profundidad de campo, aberración cromática, viñetado y otros) exponen control tipo cámara antes del render.

El tratamiento de materiales y movimiento es más sólido que en generaciones PixVerse anteriores para muchos briefs; aun así verifica en las tomas que realmente entregas.

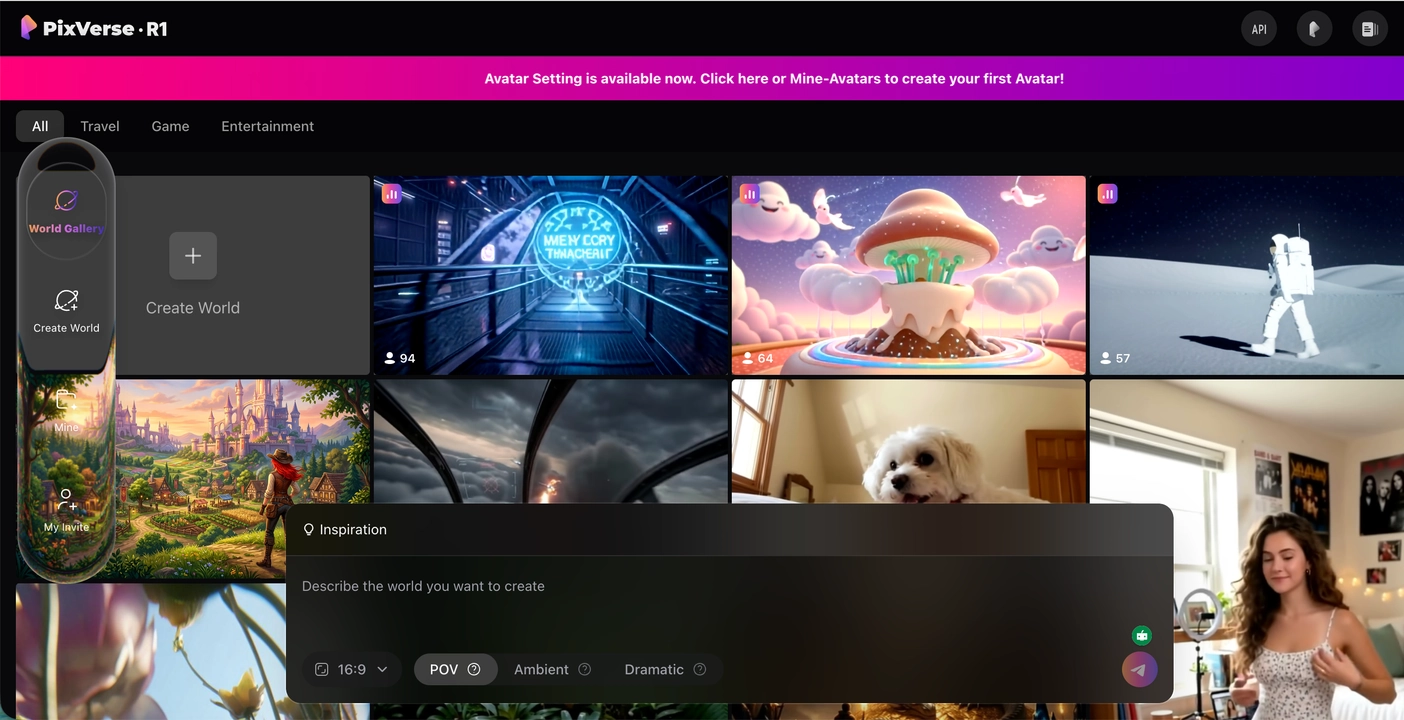

PixVerse R1

PixVerse R1 no es un sustituto directo de Sora 2 o Veo 3.1 si necesitas un MP4 terminado y nada más. Transmite un mundo interactivo persistente con baja latencia, incluyendo Shared Worlds (sesiones en vivo multiusuario guiadas por prompt) y Personalized Avatars en la línea de abril de 2026. El detalle de arquitectura y hoja de ruta está en el artículo sobre R1; el acceso hoy está en realtime.pixverse.ai.

Nota: El acceso para partners y por API de R1 sigue el PixVerse R1 Partner Program.

Sora 2 y Veo 3.1 no apuntan a este problema de mundo en tiempo real; evalúa R1 solo cuando tu especificación de producto lo exija.

Mini Apps (Ad Master)

Ad Master (31 de marzo de 2026) es una Mini App de imagen de producto a video publicitario: subes una foto de SKU y una descripción breve y obtienes maquetación, voz en off y subtítulos en un pase automatizado, con precio en torno a 2–3 $ por video según el plan. Compite con operaciones publicitarias internas, no solo con generadores de propósito general. Abrir Ad Master.

Modelos PixVerse de un vistazo

| V6 | R1 | Mini Apps (Ad Master) | |

|---|---|---|---|

| Finalidad | Generación de video cinematográfico | Mundos interactivos en tiempo real | Video comercial automatizado |

| Salida | Archivo de video terminado (hasta 15s 1080p) | Flujo visual en vivo persistente (1080p) | Video publicitario completo con voz en off |

| Entrada | Prompt de texto o imagen de referencia | Prompt de texto (en vivo, multiusuario) | Imagen de producto + descripción |

| Audio | Nativo, sincronizado con el movimiento | Generación ambiental en tiempo real | Voz en off y subtítulos autogenerados |

| Interacción | Generar, revisar, iterar | Tiempo real, compartido, continuo | Automatización en un paso |

| Ideal para | Cineastas, agencias, desarrolladores | Engagement comunitario, experiencias interactivas | Comercio electrónico, pymes, marketing de rendimiento |

| Precios | Créditos diarios gratis + niveles de suscripción | Acceso gratuito | ~3 $/video (2 $ para suscriptores) |

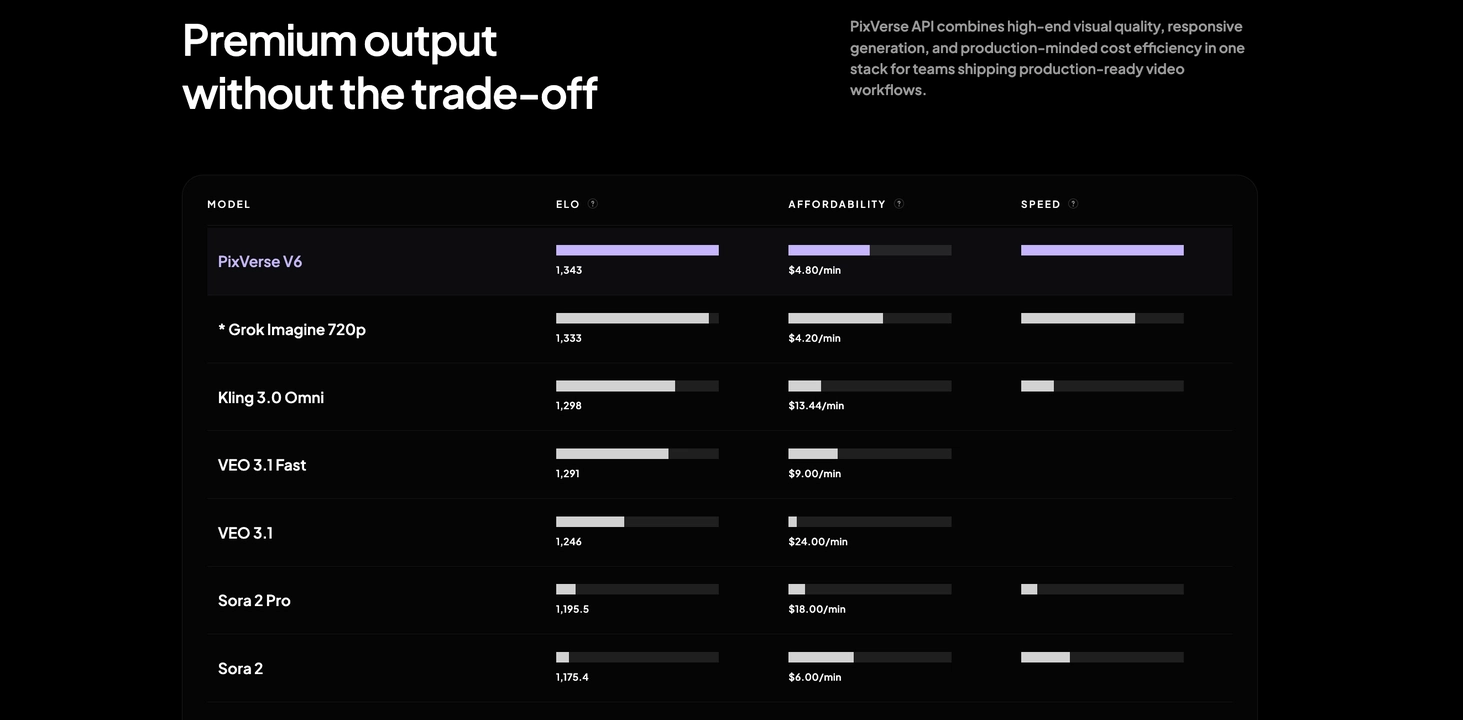

Benchmarks y panorama de costes

PixVerse mantiene una tabla interna de clasificación (ELO, $/minuto aproximado y velocidad). En el momento de este artículo, filas indicativas incluyen: PixVerse V6 con ELO 1,343 y $4.80/min; Veo 3.1 Fast con 1,291 / $9.00/min; Veo 3.1 (estándar) con 1,246 / $24.00/min; Sora 2 Pro con 1,195.5 / $18.00/min; Sora 2 (estándar) con 1,175.4 / $6.00/min. Los datos de Sora son históricos: el servicio está fuera de línea. Usa esta tabla como una instantánea y confirma precios y condiciones vigentes en cada proveedor antes de presupuestar.

Cómo despliegan PixVerse los equipos en la práctica

Enrutamiento por API: Proveedores de inferencia como Runware exponen PixVerse V6 junto a otros modelos para que los desarrolladores puedan llamar a video por el mismo stack que usan para imágenes, útil cuando el requisito es enrutamiento multi‑modelo, no una única interfaz de un proveedor.

Producto integrado: Empresas como Perfect Corp (YouCam) integran la generación dentro de una app existente para que los usuarios pasen de fotos fijas a video corto sin salir de un flujo familiar, útil cuando la distribución es belleza consumer o retail, no solo una página de generador independiente.

Estos ejemplos muestran dónde suele conectarse PixVerse; no son recomendaciones para todos los casos.

Acceso para desarrolladores

V6 y Mini Apps están disponibles en la web. V6 también incluye una CLI para flujos de agentes de código y automatización (guía de la CLI de PixVerse). R1 se transmite en realtime.pixverse.ai; el acceso por API se describe en la entrada del Partner Program.

Uso comercial y encaje operativo

Para equipos que evalúan estas herramientas para producción de pago, la decisión no depende solo de la calidad de salida. También del camino de acceso, modelo de precios, coste de iteración, flujo de despliegue y de si el producto se mapea claramente al trabajo que realmente necesitas.

Veo 3.1 suele encajar cuando compra, gobernanza y despliegue ya están en el stack de Google. PixVerse V6 suele encajar cuando el cuello de botella es salida coherente más larga, control cinematográfico o menos pasos de encaje desde el prompt al clip terminado. R1 y Mini Apps importan cuando el requisito es interacción en vivo o automatización producto‑a‑anuncio en lugar de una exportación genérica de clip. En todos los casos, confirma condiciones de uso comercial actuales, moderación y tratamiento de datos con cada proveedor antes de entregar trabajo a clientes.

Dónde encaja cada herramienta

Clips sociales de formato corto: La salida de 8 segundos de Veo 3.1 y el soporte vertical 9:16 cubren la mayor parte de las necesidades de contenido social con poca sobrecarga de prompting. PixVerse V6 maneja los mismos formatos a 15 segundos para contenido que necesita más espacio narrativo. Sora 2 está fuera de línea.

Video principal de campaña: Cuando el activo necesita 12–15 segundos con iluminación coherente con el producto a lo largo de una secuencia de planos, la duración en un solo pase de V6 y la lógica multi‑plano integrada reducen el coste de iteración frente al enfoque de extensión secuencial de Veo. Ambos producen salida profesional; la diferencia es cuánto prompting manual hay entre planos.

Narrativa multi‑plano: La extensión de escena de Veo 3.1 y el soporte de imágenes de referencia gestionan secuencias más largas. El motor multi‑plano de V6 mantiene cortes con personajes coherentes dentro de una sola generación y exige menos iteraciones de encaje para narrativa estructurada.

Producción automatizada de alto volumen: Veo 3.1 vía Vertex AI encaja con equipos ya estandarizados en Google Cloud. PixVerse V6 vía API o CLI encaja con pipelines que necesitan generación como paso dentro de una automatización más amplia (véase los ejemplos de despliegue arriba). La API de Sora 2 está fuera de línea.

Comercio electrónico y anuncios de producto: Ad Master está pensado para entradas de producto a escala SKU; Sora 2 y Veo 3.1 son generadores generales, no pipelines dedicados producto‑a‑anuncio.

Experiencias interactivas y engagement comunitario: R1 apunta a mundos impulsados por la audiencia en vivo, más cercanos a una transmisión guiada por prompts que a un render por lotes. Sora 2 y Veo 3.1 no se centran en esa forma de producto.

Belleza, retail y visualización de producto: Los equipos en este ámbito a menudo necesitan que rostros, envases y texto en pantalla localizado se mantengan estables. Compara V6 y Veo en tus planos principales; los despliegues en apps integradas (como flujos de belleza) son un patrón, no una prueba universal.

Preguntas frecuentes

¿Sigue disponible Sora?

A partir del 24 de marzo de 2026, la app y la API de Sora de OpenAI están fuera de línea. No hay endpoint público activo para Sora 2.

¿Cómo se compara Veo 3.1 con PixVerse V6 para contenido más largo?

Veo 3.1 usa por defecto 8 segundos; la extensión de escena puede alcanzar ejecuciones de más de un minuto como cadena de segmentos. PixVerse V6 genera hasta 15 segundos en un pase y puede estructurar varios planos dentro de ese pase. Prefiere Veo si ya optimizas golpes cortos y entrega nativa en Google; prefiere V6 si quieres un archivo con cortes internos sin volver a promptear cada plano.

¿Qué es PixVerse R1?

R1 es el modelo de mundo en tiempo real de PixVerse. En lugar de solo exportar un archivo terminado, mantiene un entorno visual interactivo persistente impulsado por prompts en vivo, incluyendo sesiones compartidas multiusuario y avatares en la línea de abril de 2026. Entrada: realtime.pixverse.ai.

¿Puedo usar estas herramientas para producción comercial?

El uso comercial depende del nivel actual de cada plataforma, términos de API, reglas de moderación y políticas regionales. Antes de campañas de pago o entrega a clientes, verifica derechos de uso y tratamiento de datos con OpenAI, Google y PixVerse directamente.

¿Qué generador de video con IA debería probar primero?

Ejecuta un brief de producción real, no demos de stock, en Veo 3.1 y PixVerse V6. Puntúa sincronía de audio, coherencia entre planos y número de iteraciones. Para anuncios de catálogo, mide Ad Master frente a tu flujo actual de SKU.

Conclusión

Sora 2 está fuera de línea, pero sigue importando como periodo de referencia para clips con física marcada y audio nativo en un solo pase. Veo 3.1 es la vía activa de Google: valores por defecto cortos, gran alcance en superficies y API de Google, y extensión de escena cuando aceptas producción segmentada. PixVerse V6 es la opción paralela cuando importan más la duración en un solo archivo, el multi‑plano en el mismo pase y el control a nivel de óptica que encajar en el paquete de Google.

PixVerse también ofrece R1 y Mini Apps en categorías adyacentes (mundos en vivo y anuncios estilo SKU), donde el referente suele ser la producción tradicional, no solo Sora o Veo.

Para video descargable estándar en 2026, la mayoría de equipos preseleccionará Veo 3.1 y PixVerse V6, validará ambos con sus propios prompts y decidirá entre encaje en el ecosistema frente a estructura del clip. Un contexto más amplio de modelos está en el artículo 2026 AI Video Generator.