Sora vs. Veo vs. PixVerse: Pro-Guide 2026 zu KI-Video-Stacks

Sora 2 wurde im März 2026 eingestellt. Dieser Guide behandelt Sora im Rückblick, Zugangswege zu Veo 3.1 und PixVerse V6 sowie kurz R1 und Mini Apps.

Sora 2 ging am 24. März 2026 offline. OpenAI nannte Rechenkosten und regulatorischen Druck. Beides trug dazu bei, dass das Modell zum Maßstab der Kategorie wurde – und schließlich nicht tragbar blieb. Drei Wochen später startete PixVerse V6. Google hatte Veo 3.1 bereits im Oktober 2025 ausgeliefert.

In sechs Monaten ordnete sich der KI-Video-Stack neu. Ein Tool fiel weg. Zwei andere rückten in die Produktion. Dieser Artikel räumt Sora 2 (historisch) und Veo 3.1 (was Google heute liefert) mehr Raum ein als einem einzelnen Vendor-Überblick und fasst PixVerse in demselben Vergleichsrahmen zusammen – V6 für direkte Text-zu-Video-Parität plus kürzere Hinweise zu R1 und Mini Apps, wenn Ihre Aufgabe kein Einmal-Clip ist.

So sind wir vorgegangen: Wo Tools noch verfügbar waren, haben wir denselben Testprompt durch jedes Modell laufen lassen und beschreiben, was wir sahen. Die Kundenbeispiele unten zeigen, wie Teams ein Modell in eine Pipeline einbinden – kein Versprechen, dass Ihre Ergebnisse gleich aussehen.

Kernaussagen (April 2026)

- Sora 2 hat keine öffentliche App oder API mehr; betrachten Sie es als Referenzära für physiklastige Generierung und planen Sie eine Migration, falls Sie noch Sora-ähnliche Workflows haben.

- Veo 3.1 ist der aktive Google-Pfad: starke Ökosystem-Passung, wenn Sie bereits in Gemini, Vertex AI oder Shorts-ähnlicher Auslieferung arbeiten; Standard-Clips sind 8 Sekunden lang, Szenen-Erweiterung ist der Hauptweg, um die Laufzeit zu verlängern.

- PixVerse V6 ist die parallele Option für längere Single-Pass-Clips, Multi-Shot im selben Take und stärkere Objektiv-/Kamera-Kontrolle auf Objektivebene – bewerten Sie es anhand Ihrer eigenen Briefs, nicht allein anhand unserer.

- R1 (Echtzeit-Welten) und Mini Apps (z. B. Produkt-zu-Werbung) sind nur relevant, wenn Ihre Anforderung kein herkömmliches herunterladbares Videodatei-Format ist – in diesem Fall springen Sie zu den Unterabschnitten.

Kurzantwort: Für gewöhnliche Text-zu-Video-Arbeit heute ist die lebende Wahl Veo 3.1 oder PixVerse V6. Wählen Sie Veo, wenn Google-Cloud-Beschaffung, Gemini oder Vertex-Integration Ihren Stack bereits bestimmt. Wählen Sie PixVerse V6, wenn Sie längere Ausgabe in einem Durchgang, integriertes Multi-Shot in einer Generierung und direktere Kamera-Parameter wünschen – und ergänzen Sie R1 oder Mini Apps nur, wenn Ihr Anwendungsfall zu dem passt, was diese Produkte leisten.

Vergleichstabelle Sora 2, Veo 3.1 und PixVerse V6

Alle drei Modelle zielen auf dieselbe Aufgabe: einen Textprompt in ein fertiges Video mit synchronisiertem Audio zu verwandeln. Die folgende Tabelle vergleicht sie anhand der Spezifikationen, die bei der Wahl eines Generators für kreative oder produktive Arbeit am meisten zählen. Enterprise-Integration, API-Zugang und Deployment-Fälle werden in den jeweiligen Abschnitten weiter unten behandelt.

| Sora 2 | Veo 3.1 | PixVerse V6 | |

|---|---|---|---|

| Entwickler | OpenAI | PixVerse | |

| Status | ⛔ Offline seit 24. März 2026 | ✅ Aktiv | ✅ Aktiv (Start 30. März 2026) |

| Max. Auflösung | 1080p (Pro-Stufe) | 720p / 1080p / 4K | 1080p |

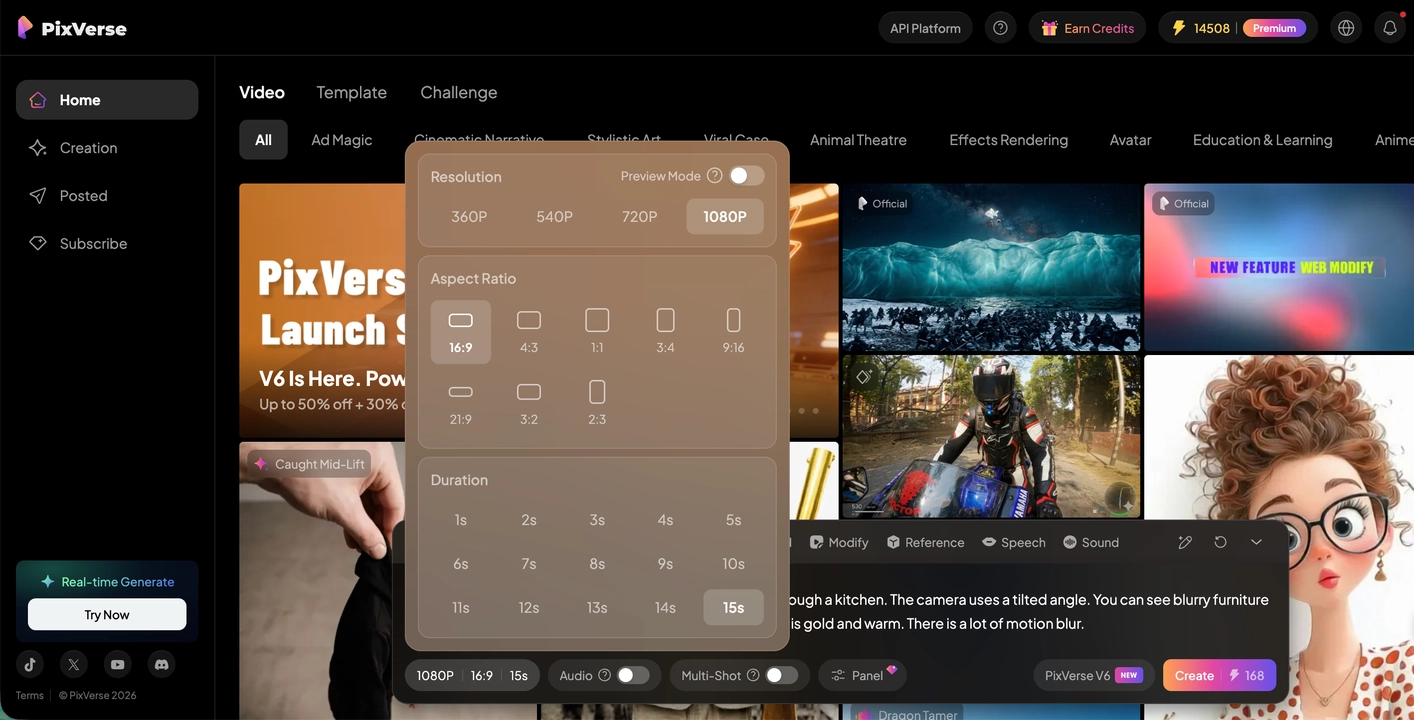

| Dauer in einem Durchgang | Bis zu 12 s | 8 s | Bis zu 15 s |

| Multi-Shot-Engine | Manuelles Prompting | Sequentielle Erweiterung | Integriert (eine Generierung) |

| Natives Audio | Synchronisierte Sprache, SFX | Dialog, SFX, Ambience | In einem Durchgang mit Bewegung erzeugt |

| Text im Video | Begrenzt | Begrenzt | Mehrsprachig, bewegungsstabil |

| Filmische Steuerung | Basis | Basis | 20+ Objektiv-Parameter |

| Kostenlose Tages-Credits | Keine (Pro 200 $/Monat) | Bezahlte API | Ja (plattformabhängig) |

| Entwickler- / API-Zugang | API-Roadmap (jetzt offline) | Gemini API, Vertex AI | CLI + API, agentenkompatibel |

Sora 2 setzte einen physikorientierten Maßstab, ist aber nicht mehr verfügbar. Veo 3.1 führt bei Auflösungsoptionen (bis 4K) und bei Passung für Teams, die auf Google standardisiert sind. PixVerse V6 betont längere Single-Pass-Länge, Multi-Shot innerhalb einer Generierung und fein abgestufte Objektiv-Steuerung bei 1080p. Da Sora offline ist, vergleichen die meisten Käufer Veo 3.1 und PixVerse V6 für dateibasierte Workflows; R1 und Mini Apps sind andere Produktformen und werden später kurz behandelt.

Welches KI-Video-Tool sollten Sie 2026 wählen?

Wenn Ihr Ziel ein Standard-Text-zu-Video-Workflow ist, ist der echte Vergleich nicht mehr Sora gegen Veo gegen PixVerse zu gleichen Teilen. Sora 2 gehört zum historischen Maßstab, die aktive Kaufentscheidung liegt zwischen Veo 3.1 und PixVerse V6.

Wählen Sie Veo 3.1, wenn Ihr Team bereits in Google Cloud arbeitet, Gemini- oder Vertex-AI-Integration benötigt und 4K-Optionen plus vertrauten Enterprise-Stack mehr schätzt als längere Single-Pass-Ausgabe.

Wählen Sie PixVerse V6, wenn Sie bis zu 15 Sekunden in einem Durchgang, integrierte Multi-Shot-Generierung, stärkere filmische Kontrolle und einen Workflow brauchen, der vom Test bis zur Produktion reicht, ohne mehrere Szenen-Erweiterungen zusammenzunähen.

Wählen Sie PixVerse R1, wenn Ihr Anwendungsfall kein fertiges Videodatei-Format ist, sondern eine live interaktive Welt, die Nutzer in Echtzeit bedient. Das ist eine andere Produktkategorie als Sora 2 und Veo 3.1.

Wählen Sie PixVerse Mini Apps, wenn Ihre eigentliche Aufgabe automatisierte Werbung aus Produktassets ist und nicht prompt-basiertes Filmemachen. Dann ist der relevante Vergleich mit klassischen Werbeproduktions-Workflows, nicht nur mit allgemeinen Videogeneratoren.

Direktvergleich der Ausgabe: 3 KI-Videogeneratoren im Test

Spezifikationen beschreiben Potenzial. Derselbe Prompt in allen drei Tools zeigt, wie sich jedes Modell unter Druck tatsächlich verhält.

Testprompt:

Eine realistische Nahaufnahme einer Biene, die sehr schnell durch eine Küche fliegt. Die Kamera verwendet einen geneigten Winkel. Man sieht unscharfe Möbel und ein zerbrochenes Honigglas auf einem Tisch. Das Licht ist golden und warm. Es gibt viel Bewegungsunschärfe.

Der Prompt sollte drei Dinge gleichzeitig fordern: schnelle Subjektbewegung, feines Material-Detail (Glas, Honig, Metall) und Fischaugen-Raumgeometrie. Wir bewerteten jede Ausgabe auf räumliche Konsistenz, zeitliche Stabilität und Genauigkeit des nativen Audios.

Sora 2

Die Küche wirkte überzeugend. Warmes Grading, filmische Tiefe, starkes Umgebungslicht, das durchdacht wirkte statt rein prozedural. Wo Sora 2 schwächelte, war die Prompt-Treue beim Hauptmotiv: Der Raum dominierte; die Biene war da, aber untergewichtet. „Sehr schnell“ im Prompt führte in den meisten Läufen zu normalem Tempo statt rasendem Flug. Die spezifizierten Details an der Biene kamen nicht zuverlässig. Ein kommerziell nutzbarer Take erforderte wiederholte Neugenerierungen – bei 200 $/Monat summiert sich das. Sora 2 blieb Referenz für erzählerische Umgebungen; bei bewegungsgetriebenem Hauptmotiv blieb Luft nach oben.

Veo 3.1

Farbe und Schärfe trafen gut. Die Küchenszene hatte saubere Geometrie und plausibles Materialverhalten auf flachen Oberflächen. Wo Veo 3.1 nachließ, war die Bewegungstreue: „Sehr schnell“ ergab ein langsames Gleiten, keinen Flug. Die Wiedergabe zeigte in unserer Datei merkliches Ruckeln. Audio war vorhanden und enthielt Küchen-Ambiente, aber Sync zur schnellsten Bildbewegung wirkte annähernd statt präzise. Für einen Prompt, der stark auf Tempo und Energie setzt, lieferte Veo 3.1 ein kompetentes, aber visuell eher passives Ergebnis.

PixVerse V6

Die Fischaugen-Geometrie blieb über den gesamten Take stabil. Während sich die Biene an Geräten vorbeibewegte, folgte die Objektiv-Verzerrung framegenau der Position ohne Drift. Das Honig-Amber im zerbrochenen Glas zeigte glaubhafte Viskosität und Lichtbrechung, als die Kamera vorbeifuhr. Flügelschlag-Audio entstand im selben Durchgang wie das Video; das Summen folgte dem Flugbogen vom Eintritt bis zum Austritt ohne separaten Sync-Schritt. Der Übergang von weiter Küche zu Makro auf dem Honigglas wirkte als durchgehende Bewegung, nicht als Naht. Zeitliche Stabilität hielt bei 1080p über die vollen 15 Sekunden.

Vollständige Videoausgaben jedes Tools und den erweiterten Benchmark über zehn Modelle finden Sie im Artikel 2026 AI Video Generator.

OpenAI Sora 2

Sora 2 war OpenAIs Modell für Video- und Audiogenerierung: Es zielte darauf ab, physikalische Konsequenz zu simulieren (ein verfehlter Basketball prallt vom Brett ab) statt nur plausible Frames zu interpolieren. Diese Einordnung prägte, wie Teams 2025 „Realismus“ bewerteten – weniger als Politur, mehr als Folgerichtigkeit.

Fähigkeiten

Sora 2 startete am 30. September 2025 als Allzwecksystem. In der Pro-Stufe unterstützte es bis zu 12 Sekunden bei 1080p. Komplexe Bewegung – Sport, Stunts, Mehrpersonen-Dialog – zeigte oft stärkere physikalische Plausibilität als frühere Consumer-Tools. Audio war nativ in einem Durchgang: Sprache, Effekte und Ambiente zusammen.

Die Characters-Pipeline erlaubte freigegebenen Nutzern, eine reale Person mit Ähnlichkeit und Stimme in eine Szene zu setzen – nach Identitäts- und Einwilligungsschritten. Multi-Shot konnte Umgebung und Licht über Schnitte hinweg halten, wenn der Prompt Kontinuität verlangte.

Wo es in der Praxis scheiterte

Sora 2 war nicht deterministisch. Präzise Prompts drifteten dennoch bei Gesichtern, Garderobe und kleinen Requisiten; Hände und feine Manipulation waren häufige Schwachstellen. Teams mit einem konkreten Heldenauftritt zahlten in Regenerationsvolumen: Der Pro-Preis von 200 $/Monat wog weniger schwer als die Iterationssteuer – viele Durchläufe für einen lieferbaren Clip. Briefs mit schneller Subjektbewegung plus feinem Detail (unser Bienen-Test gehört dazu) verbrannten Budget besonders leicht ohne garantierten Erfolg.

Abschaltung und wer umziehen musste

OpenAI entfernte Sora-App und API am 24. März 2026 und nannte Rechenkosten und Druck rund um synthetische Medien. Zum Redaktionsschluss gibt es keinen öffentlichen Endpunkt für Sora 2.

Die Auswirkungen waren ungleich: API- und Workflow-Integrationen brachen komplett; Abonnenten verloren über Nacht ein Produktionswerkzeug; Teams mit Characters oder Social-Vertrieb mussten Generierung und Compliance neu aufsetzen. Für eine praktische Ersatzübersicht siehe Sora alternatives.

Migration denken (vendor-neutral)

Sie wählen nicht „den nächsten Sora“. Sie passen Randbedingungen an: Brauchen Sie Google-native Beschaffung und kurze Clips in großer Zahl? Vertex-Klasse-Governance? Längere Single-Pass-Dateien? Produkt-zu-Werbung-Automatisierung? Ordnen Sie diese Prioritäten, und testen Sie Ihre eigenen Prompts auf Shortlists – unser Direktvergleich ist ein Datenpunkt, kein universelles Ranking.

Historisch setzte Sora 2 eine Latte für physikorientiertes Storytelling, an der spätere Modelle noch gemessen werden – auch wenn sie sich bei Preis, Zugang oder Abschaltungsrisiko unterscheiden.

Google Veo 3.1

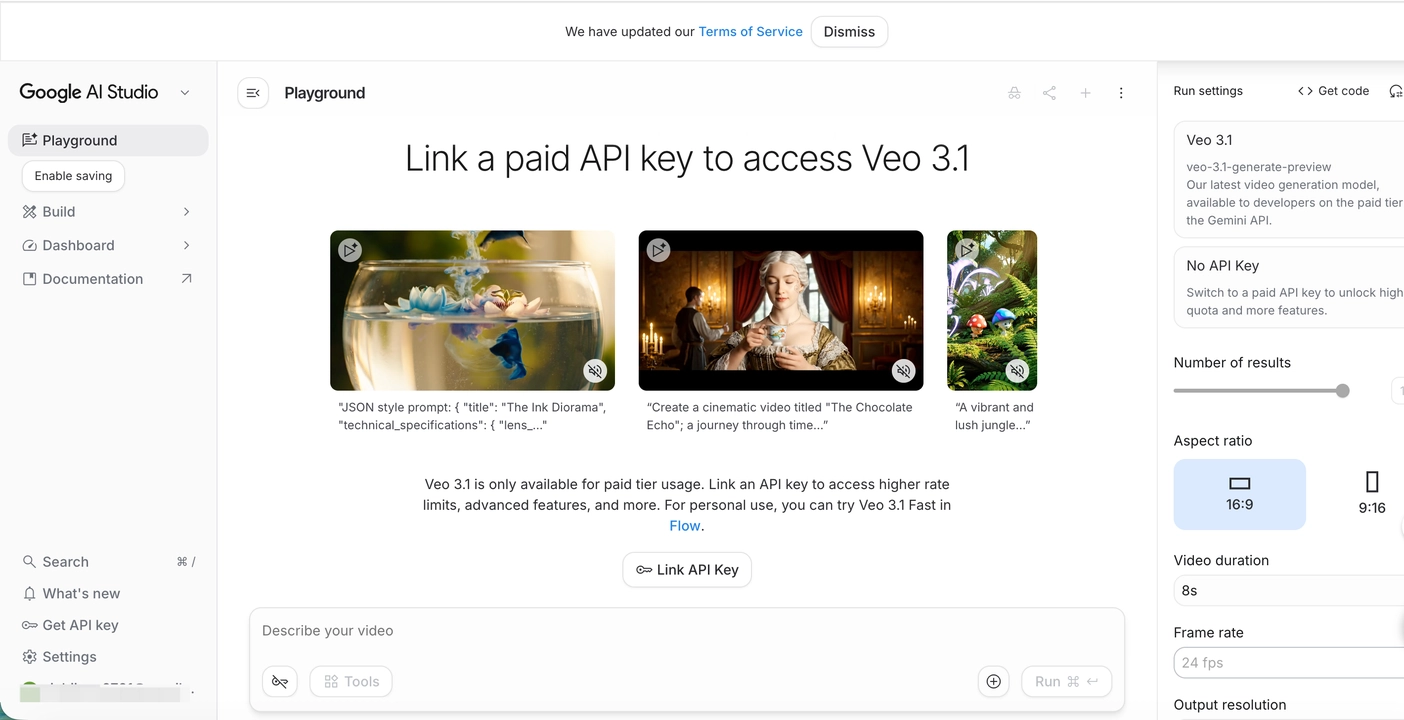

Veo 3.1 ist Googles generatives Videomodell, um Prompts (und einige visuelle Anker) in kurze Clips mit nativem Audio zu verwandeln. Über die Gemini API (seit Oktober 2025) verbindet es Google AI Studio, Vertex AI und Consumer-Oberflächen wie Flow, die Gemini-App und YouTube Shorts – „Veo“ kann also alles sein vom schnellen App-Test bis zum governanten Enterprise-Deployment.

Fähigkeiten

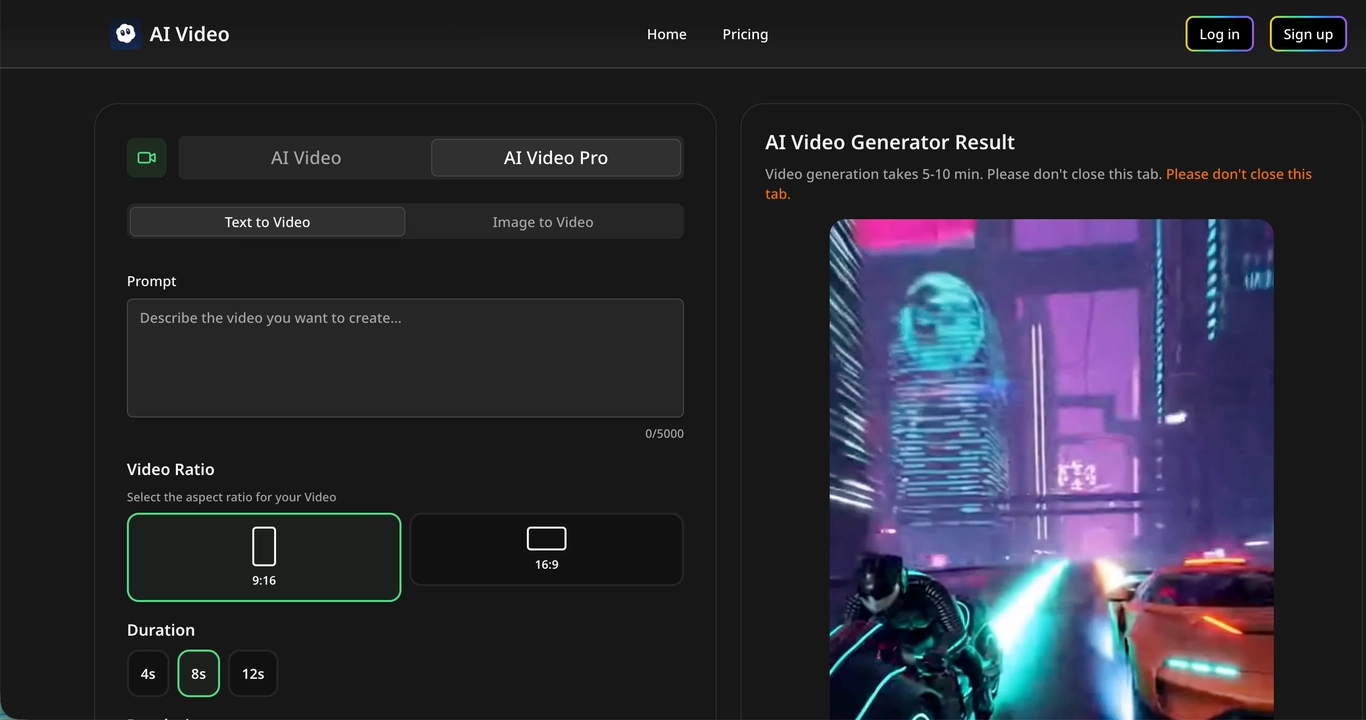

Veo 3.1 unterstützt 720p, 1080p und 4K mit 16:9 und 9:16. Die Standardgenerierung ist 8 Sekunden – passend für Shorts-Takte und schnelle Iteration, aber strukturell limitierend für erzählerische Stücke.

Szenen-Erweiterung ist der Hauptweg, darüber hinauszugehen: Jedes neue Segment kann vom letzten Frame des vorherigen Clips fortsetzen, sodass minutenlange Läufe möglich sind als Kette aus Prompts und Reviews, nicht als ein ununterbrochener Durchgang. Das begünstigt Teams, die Storyboard, QC und Re-Prompting zwischen Segmenten gewohnt sind.

Ingredients to Video (bis zu drei Referenzbilder) hilft, Look oder Identität über Generierungen zu sichern – nützlich, wenn Markenassets schon existieren. Erster und letzter Frame zielen auf kontrollierte Übergänge zwischen zwei Standbildern, mit Audio in derselben Generierung.

Audio (Dialog, SFX, Ambience) wird mit dem Video ausgeliefert. In unserem Bienen-Test war Ton vorhanden, aber taktgenauer Sync zur schnellsten Bildbewegung nicht immer überzeugend – auf actionlastigen eigenen Prompts validieren.

Zugangswege und was sie bedeuten

Nicht jeder Einstieg ist gleichwertig:

- Consumer-Apps (Gemini / Flow / Shorts) sind der schnellste Weg, Veo-nahe Ausgabe zu testen; Bedingungen, Rate Limits und Export unterscheiden sich von der API.

- Google AI Studio / Gemini API eignet sich für Entwickler, die gegen den Google-Stack prototypisieren.

- Vertex AI ist die Enterprise-Route: Datenhandling, Abrechnung und Governance sind relevant, wenn Recht oder Beschaffung bereits auf Google Cloud standardisiert sind.

Wenn Ihre Organisation die Produktion nicht bereits über Google führt, sollten Sie Engineering-Zeit für Auth, Billing und Policy-Review einplanen – nicht nur Modellqualität.

Grenzen

Acht-Sekunden-Defaults bedeuten: Längere Erzählungen sind ein Workflow-Design-Problem – Szenen-Erweiterung funktioniert, ist aber nicht dasselbe Betriebsmodell wie Multi-Shot innerhalb einer Generierung. Teams, die eine Datei mit strukturierten internen Schnitten brauchen, sollten diese Unterscheidung in der Evaluation explizit machen.

Außerhalb des Google-Ökosystems ist Integrationsaufwand real: Sie wählen nicht nur ein Modell, sondern wie Video neben Storage, Identität und Compliance-Tools liegt, für die Sie bereits zahlen.

PixVerse

OpenAI und Google liefern in dieser Geschichte jeweils einen primären Videogenerator (Sora 2 historisch, Veo 3.1 heute). PixVerse bündelt V6 für denselben dateibasierten Job und ergänzt R1 (Live-Welten) und Mini Apps (Szenario-Tools wie Ad Master) – sinnvoll, wenn Ihr Workflow kein einzelnes gerendertes Clip-Ergebnis ist.

Hinweis zum Umfang: Vergleichen Sie nur Text-zu-Video-Exporte, lesen Sie V6 und Benchmarks; behandeln Sie R1 und Mini Apps als optionale Add-ons, wenn Live-Interaktion oder Produkt-zu-Werbung-Durchsatz zählt.

PixVerse V6

PixVerse V6 (30. März 2026) ist das direkte Pendant zu Sora- und Veo-artiger herunterladbarer Generierung auf PixVerse. Für Kontext über zehn Modelle hinaus siehe 2026 AI Video Generator. Es zielt auf bis zu 15 Sekunden bei 1080p in einem Durchgang, mit einer Multi-Shot-Engine, die gemeinsamen Weltenzustand über interne Schnitte hinweg hält (weit zu Makro, ohne jeden Schnitt als komplett neue Generierung zu behandeln). Natives Audio entsteht mit der Bewegung; Text im Video unterstützt mehrere Sprachen; über 20 Objektiv-Parameter (Brennweite, Blende, Schärfentiefe, chromatische Aberration, Vignettierung u. a.) erlauben kameraähnliche Kontrolle vor dem Render.

Material- und Bewegungsverhalten ist für viele Briefs stärker als bei früheren PixVerse-Generationen – prüfen Sie dennoch an den Shots, die Sie wirklich ausliefern.

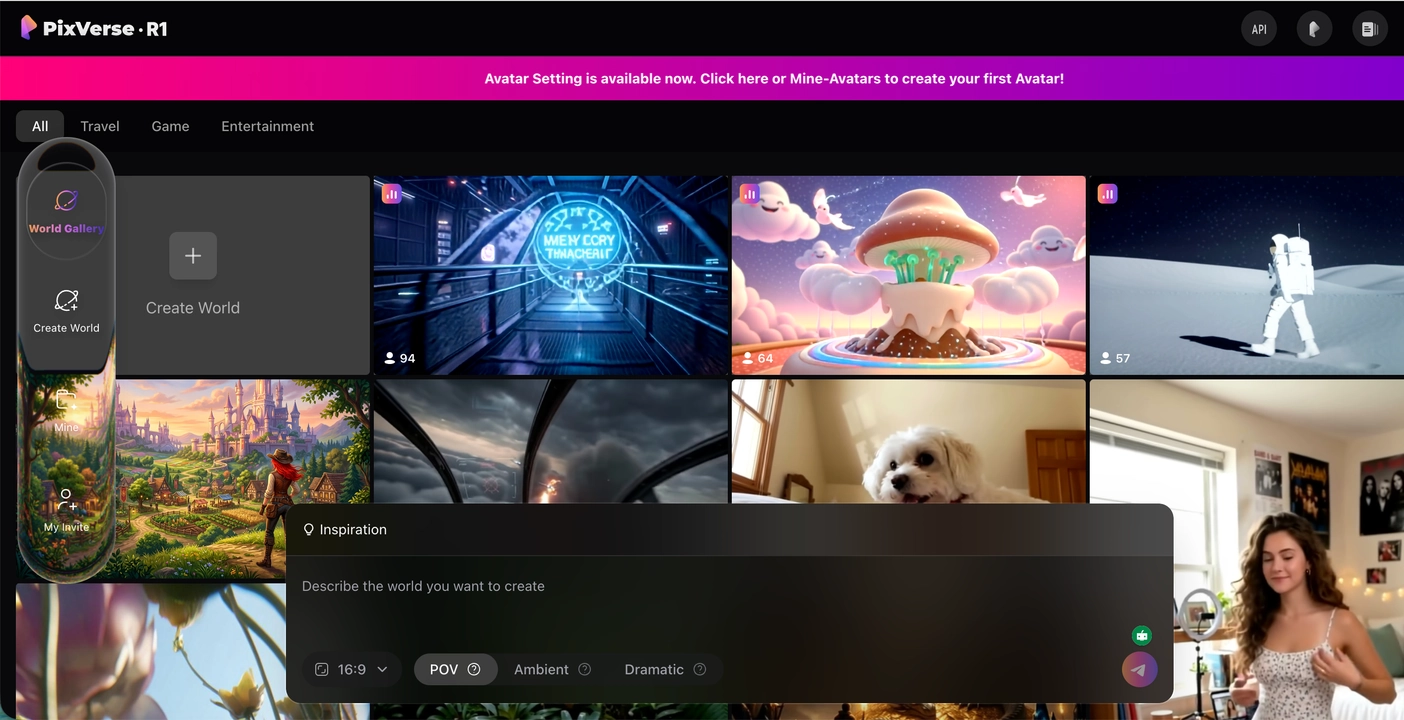

PixVerse R1

PixVerse R1 ist kein direkter Ersatz für Sora 2 oder Veo 3.1, wenn Sie eine fertige MP4 und nichts anderes brauchen. Es streamt eine persistente, interaktive Welt mit geringer Latenz – inklusive Shared Worlds (mehrere Nutzer, prompt-gesteuerte Live-Sessions) und Personalized Avatars in der April-2026-Linie. Architektur und Roadmap stehen im R1-Artikel; Zugang heute unter realtime.pixverse.ai.

Hinweis: Partner- und API-Zugang für R1 folgt dem PixVerse R1 Partner Program.

Sora 2 und Veo 3.1 zielen nicht auf dieses Echtzeit-Welt-Problem; bewerten Sie R1 nur, wenn Ihr Produktspez es verlangt.

Mini Apps (Ad Master)

Ad Master (31. März 2026) ist eine Produktbild-zu-Werbung-Mini-App: SKU-Foto und kurze Beschreibung hochladen, Layout, Voiceover und Untertitel in einem automatisierten Durchgang – preislich etwa 2–3 $ pro Video je nach Plan. Es konkurriert mit interner Ad-Ops, nicht nur mit Allzweck-Generatoren. Ad Master öffnen.

PixVerse-Modelle auf einen Blick

| V6 | R1 | Mini Apps (Ad Master) | |

|---|---|---|---|

| Zweck | Filmische Videogenerierung | Echtzeit-interaktive Welten | Automatisiertes Werbevideo |

| Ausgabe | Fertige Videodatei (bis 15 s 1080p) | Persistenter Live-Visual-Stream (1080p) | Vollständiges Werbevideo mit Voiceover |

| Eingabe | Textprompt oder Referenzbild | Textprompt (live, mehrere Nutzer) | Produktbild + Beschreibung |

| Audio | Nativ, synchron zur Bewegung | Echtzeit-Ambiente-Generierung | Automatisches Voiceover + Untertitel |

| Interaktion | Generieren, prüfen, iterieren | Echtzeit, geteilt, kontinuierlich | Ein-Schritt-automatisiert |

| Ideal für | Filmemacher, Agenturen, Entwickler | Community-Engagement, interaktive Erlebnisse | E-Commerce, KMU, Performance-Marketing |

| Preis | Kostenlose Tages-Credits + Abo-Stufen | Kostenloser Zugang | ~3 $/Video (2 $ für Abonnenten) |

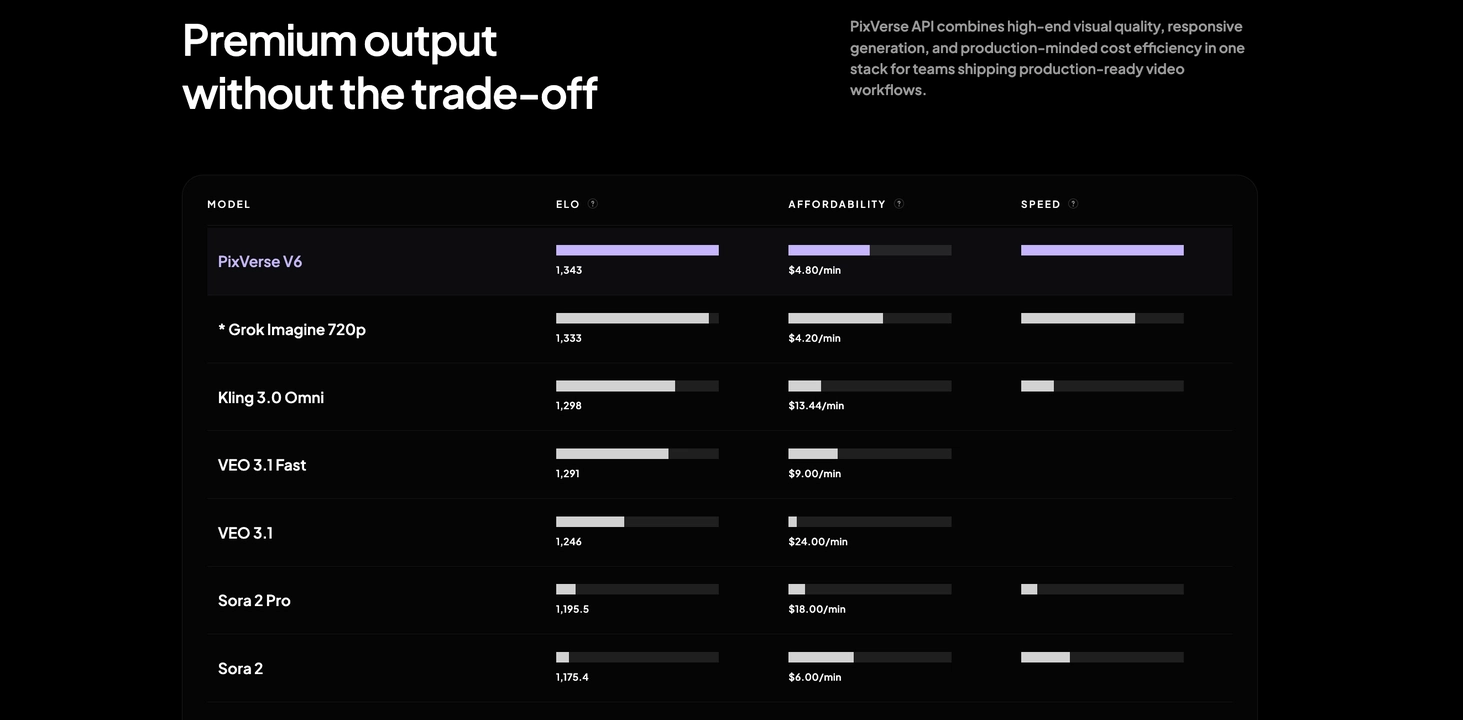

Benchmarks und Kosten-Snapshot

PixVerse pflegt eine interne Rangliste (ELO, ungefähr $/Minute, Geschwindigkeit). Zum Redaktionsschluss dieses Artikels umfassen beispielhafte Zeilen: PixVerse V6 bei ELO 1.343 und 4,80 $/min; Veo 3.1 Fast bei 1.291 / 9,00 $/min; Veo 3.1 (Standard) bei 1.246 / 24,00 $/min; Sora 2 Pro bei 1.195,5 / 18,00 $/min; Sora 2 (Standard) bei 1.175,4 / 6,00 $/min. Sora-Zahlen sind historisch – der Dienst ist offline. Nutzen Sie die Tabelle als Momentaufnahme, und bestätigen Sie aktuelle Preise und Bedingungen bei jedem Anbieter vor der Budgetierung.

Wie Teams PixVerse in der Praxis einsetzen

API-Routing: Inferenz-Anbieter wie Runware stellen PixVerse V6 neben anderen Modellen bereit, sodass Entwickler Video über denselben Stack wie Bilder ansprechen können – sinnvoll, wenn Multi-Modell-Routing gefragt ist, nicht eine Einzel-Vendor-UI.

Eingebettetes Produkt: Unternehmen wie Perfect Corp (YouCam) integrieren Generierung in eine bestehende App, damit Nutzer von Standbildern zu Kurzvideo wechseln, ohne den gewohnten Workflow zu verlassen – sinnvoll, wenn Vertrieb Consumer Beauty oder Retail ist, nicht nur eine eigenständige Generator-Seite.

Diese Beispiele zeigen, wo PixVerse oft andockt; sie sind keine Empfehlung für jeden Anwendungsfall.

Entwicklerzugang

V6 und Mini Apps sind im Web verfügbar. V6 liefert zusätzlich eine CLI für Coding-Agenten und Automatisierung (PixVerse CLI guide). R1 streamt unter realtime.pixverse.ai; API-Zugang ist im Partner Program-Beitrag beschrieben.

Kommerzielle Nutzung und operative Passung

Für Teams, die diese Tools für bezahlte Produktion bewerten, zählt nicht nur die Ausgabequalität. Es geht auch um Zugangsweg, Preismodell, Iterationskosten, Deployment-Workflow und ob das Produkt sauber zur tatsächlichen Aufgabe passt.

Veo 3.1 passt tendenziell, wenn Beschaffung, Governance und Deployment bereits im Google-Stack sitzen. PixVerse V6 passt tendenziell, wenn der Engpass längere kohärente Ausgabe, filmische Kontrolle oder weniger Naht-Schritte vom Prompt zum fertigen Clip ist. R1 und Mini Apps zählen, wenn die Anforderung Live-Interaktion oder Produkt-zu-Werbung-Automatisierung ist statt generischer Clip-Export. Bestätigen Sie in jedem Fall aktuelle kommerzielle Nutzung, Moderation und Datenhandling bei jedem Anbieter, bevor Sie Kundenarbeit ausliefern.

Wo welches Tool passt

Kurzform-Social-Clips: Veo 3.1s 8-Sekunden-Ausgabe und vertikales 9:16 decken die meisten Social-Bedürfnisse mit geringem Prompt-Aufwand ab. PixVerse V6 behandelt dieselben Formate mit 15 Sekunden, wenn mehr Erzählraum nötig ist. Sora 2 ist offline.

Kampagnen-Heldenvideo: Wenn das Asset 12–15 Sekunden mit konsistentem Produktlicht über eine Shot-Sequenz braucht, reduzieren V6s Single-Pass-Länge und integrierte Multi-Shot-Logik die Iterationskosten gegenüber Veos sequentieller Erweiterung. Beide liefern professionelle Ausgabe; der Unterschied ist, wie viel manuelles Prompting zwischen den Shots liegt.

Multi-Shot-Erzählung: Veo 3.1s Szenen-Erweiterung und Referenzbild-Unterstützung bewältigen längere Sequenzen. V6s Multi-Shot-Engine verwaltet charakterkonsistente Schnitte innerhalb einer Generierung und braucht für strukturierte Erzählung weniger Naht-Iterationen.

Hochvolumige automatisierte Produktion: Veo 3.1 über Vertex AI passt zu Teams, die bereits auf Google Cloud standardisiert sind. PixVerse V6 über API oder CLI passt zu Pipelines, in denen Generierung ein Schritt in breiterer Automatisierung ist (siehe Deployment-Beispiele oben). Soras API ist offline.

E-Commerce und Produktwerbung: Ad Master ist auf SKU-skalige Produkteingaben ausgelegt; Sora 2 und Veo 3.1 sind Allzweck-Generatoren, keine dedizierten Produkt-zu-Werbung-Pipelines.

Interaktive Erlebnisse und Community: R1 zielt auf live, publikumsgetriebene Welten – näher an einem prompt-gesteuerten Stream als an Batch-Render. Sora 2 und Veo 3.1 fokussieren nicht diese Produktform.

Beauty, Retail, Produktvisualisierung: Teams in diesem Bereich brauchen oft stabile Gesichter, Verpackungen und lokalisierten Bildschirmtext. Vergleichen Sie V6 und Veo an Ihren Hero-Shots; eingebettete App-Deployments (z. B. Beauty-Workflows) sind ein Muster, kein universeller Beweis.

FAQ

Ist Sora noch verfügbar?

Stand 24. März 2026 sind OpenAIs Sora-App und -API offline. Es gibt keinen aktiven öffentlichen Endpunkt für Sora 2.

Wie vergleicht sich Veo 3.1 mit PixVerse V6 bei längeren Inhalten?

Veo 3.1 standardmäßig 8 Sekunden; Szenen-Erweiterung kann minutenlange Läufe als Kette von Segmenten erreichen. PixVerse V6 generiert bis zu 15 Sekunden in einem Durchgang und kann mehrere Shots in diesem Durchgang strukturieren. Bevorzugen Sie Veo, wenn Sie auf kurze Beats und Google-native Auslieferung optimieren; bevorzugen Sie V6, wenn Sie eine Datei mit internen Schnitten ohne Re-Prompting pro Shot wollen.

Was ist PixVerse R1?

R1 ist PixVerse Echtzeit-Weltmodell. Statt nur eine fertige Datei zu exportieren, hält es eine persistente, interaktive visuelle Umgebung aufrecht, angetrieben von Live-Prompts – inklusive geteilter Mehrbenutzer-Sessions und Avatare in der April-2026-Linie. Einstieg: realtime.pixverse.ai.

Kann ich diese Tools für kommerzielle Produktion nutzen?

Kommerzielle Nutzung hängt von der jeweils aktuellen Stufe, API-Bedingungen, Moderationsregeln und regionalen Richtlinien jeder Plattform ab. Vor bezahlten Kampagnen oder Kundenlieferung sollten Sie Nutzungsrechte und Datenhandling direkt bei OpenAI, Google und PixVerse prüfen.

Welchen KI-Videogenerator soll ich zuerst testen?

Lassen Sie einen echten Produktionsbrief, keine Stock-Demos, durch Veo 3.1 und PixVerse V6 laufen. Bewerten Sie Audio-Sync, Shot-übergreifende Konsistenz und Iterationsanzahl. Für Katalog-Werbung messen Sie Ad Master gegen Ihren bestehenden SKU-Workflow.

Fazit

Sora 2 ist offline, bleibt aber als Referenzphase für physikorientierte Clips und natives Audio in einem Durchgang relevant. Veo 3.1 ist Googles lebender Pfad: kurze Defaults, starke Google-Oberflächen- und API-Reichweite, Szenen-Erweiterung, wenn Sie segmentierte Produktion akzeptieren. PixVerse V6 ist die parallele Option, wenn Single-File-Länge, Multi-Shot im Durchgang und Objektiv-Level-Kontrolle wichtiger sind als die Einbindung in Googles Bündel.

PixVerse betreibt außerdem R1 und Mini Apps in angrenzenden Kategorien – Live-Welten und SKU-artige Werbung –, wo der Maßstab oft klassische Produktion ist, nicht allein Sora oder Veo.

Für standardmäßig herunterladbares Video im Jahr 2026 werden die meisten Teams Veo 3.1 und PixVerse V6 shortlisten, beide mit eigenen Prompts validieren und dann zwischen Ökosystem-Passung und Clip-Struktur entscheiden. Breiteren Modellkontext bietet der Artikel 2026 AI Video Generator.