PixVerse-R1:新一代实时世界模型

我们推出 PixVerse-R1,一种基于原生多模态基础模型构建的新一代实时世界模型。该系统支持实时视频生成,视觉内容能够即时、流畅地响应用户输入。

📘 翻译说明:本文翻译自英文原版。由于涉及较多技术细节,最准确的技术描述请以英文原版为准。

PixVerse-R1:新一代实时世界模型

摘要

我们推出 PixVerse-R1,一种基于原生多模态基础模型构建的新一代实时世界模型。该系统支持实时视频生成,视觉内容能够即时、流畅地响应用户输入。通过突破传统视频工作流程固有的延迟和固定长度限制,PixVerse-R1 将视频生成转变为无限、连续且可交互的视觉流。这标志着视听媒体在创作、体验和分享方式上的重大进化,代表着向能够基于用户意图即时适应的智能交互媒体的范式转变。

1. 引言

数字媒体格局正在从静态、预渲染内容向动态、交互式体验发生根本性转变。传统的制作流程长期受到高延迟和固定长度片段的限制,在内容创作和实时消费之间形成了难以逾越的鸿沟。

为解决这些限制,我们引入了一种新颖的世界模型架构,统一了原生多模态基础模型、一致性自回归机制和即时响应引擎。这种统一方法允许联合处理时空补丁以及文本和音频数据,有效打破了传统媒体处理的壁垒。通过部署能够通过自回归机制和即时响应引擎实现无限流式传输的系统,生成的世界在长时间范围内保持物理一致性,同时具有较低的计算开销。

核心能力:凭借这一架构,我们的系统在性能上取得了突破性进展,能够实时生成高达 1080P 的高分辨率视频。 这一能力增强了视觉保真度,并使 AI 原生游戏和交互式电影成为可能,其中环境和叙事可以根据用户交互动态演变。更广泛地说,这使生成系统能够作为持久的交互世界而非有限的媒体制品运行,预示着向连续、有状态和交互式视听模拟的发展轨迹。

2. 技术架构

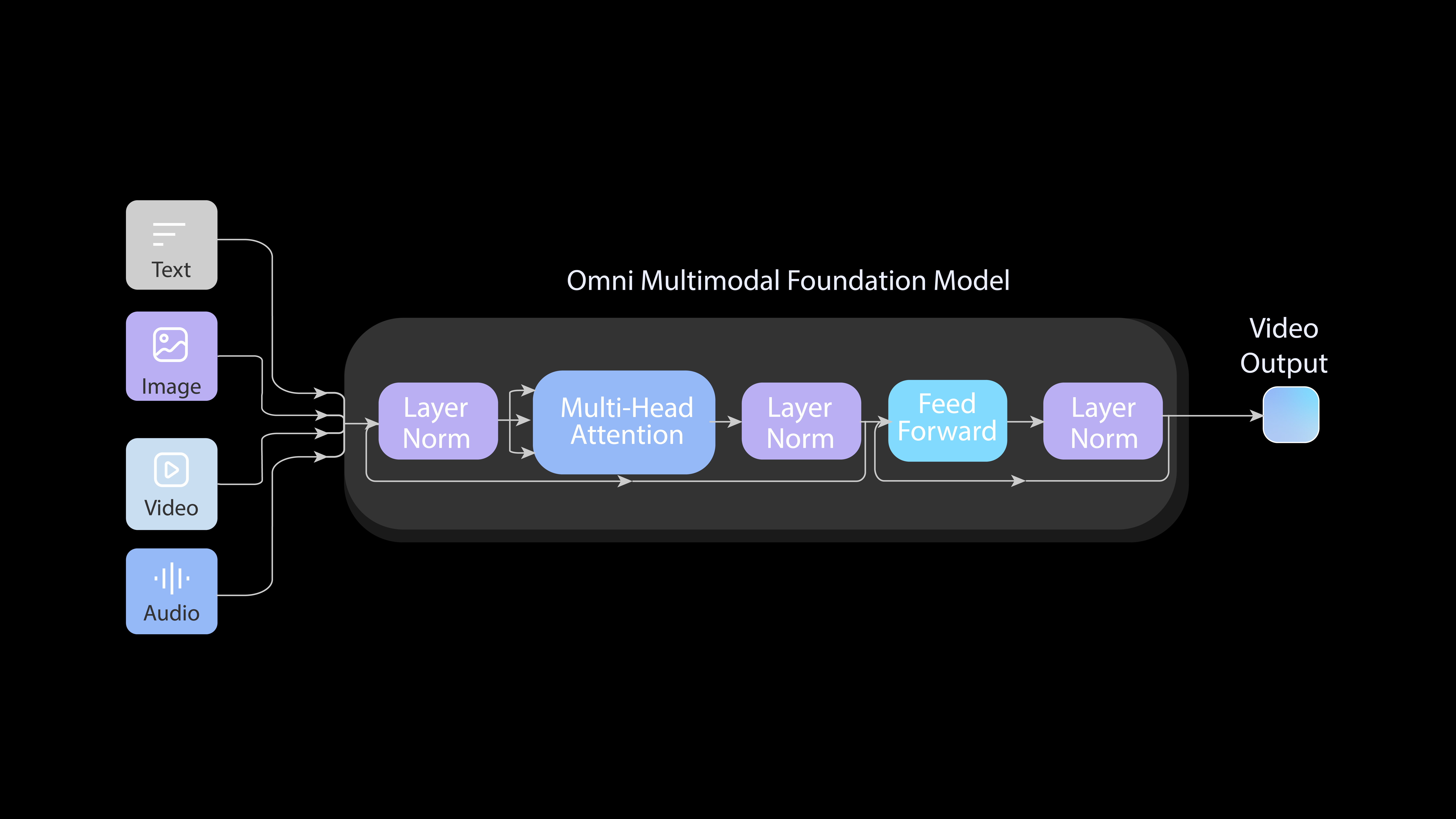

2.1 Omni:原生多模态基础模型

为获得通用能力,我们超越了传统的生成流程,设计了一个完全端到端的原生多模态基础模型。

- 统一表示: Omni 模型将多种模态(文本、图像、视频、音频)统一为连续的 token 流,使其能够在单一框架内接受任意多模态输入。

- 端到端训练: 整个架构在异构任务间进行训练,无需中间接口,防止误差传播并确保稳健的可扩展性。

- 原生分辨率: 我们在此框架内采用原生分辨率训练,以避免通常与裁剪或调整大小相关的伪影。

此外,该模型通过从海量真实世界视频数据中学习,内化了现实世界的内在物理规律和动态。这种基础性理解使系统能够实时合成一个一致的、响应式的”平行世界”。

Omni 模型具有良好的扩展性,不仅作为生成引擎,更是构建物理世界通用模拟器的开创性一步。通过将模拟任务视为单一的端到端生成范式,我们促进了实时、长期 AI 生成世界的探索。

图 1. 我们的 Omni 原生多模态基础模型的端到端架构,统一设计使我们的 Omni 模型能够接受任意多模态输入,并同时生成音频和视频。

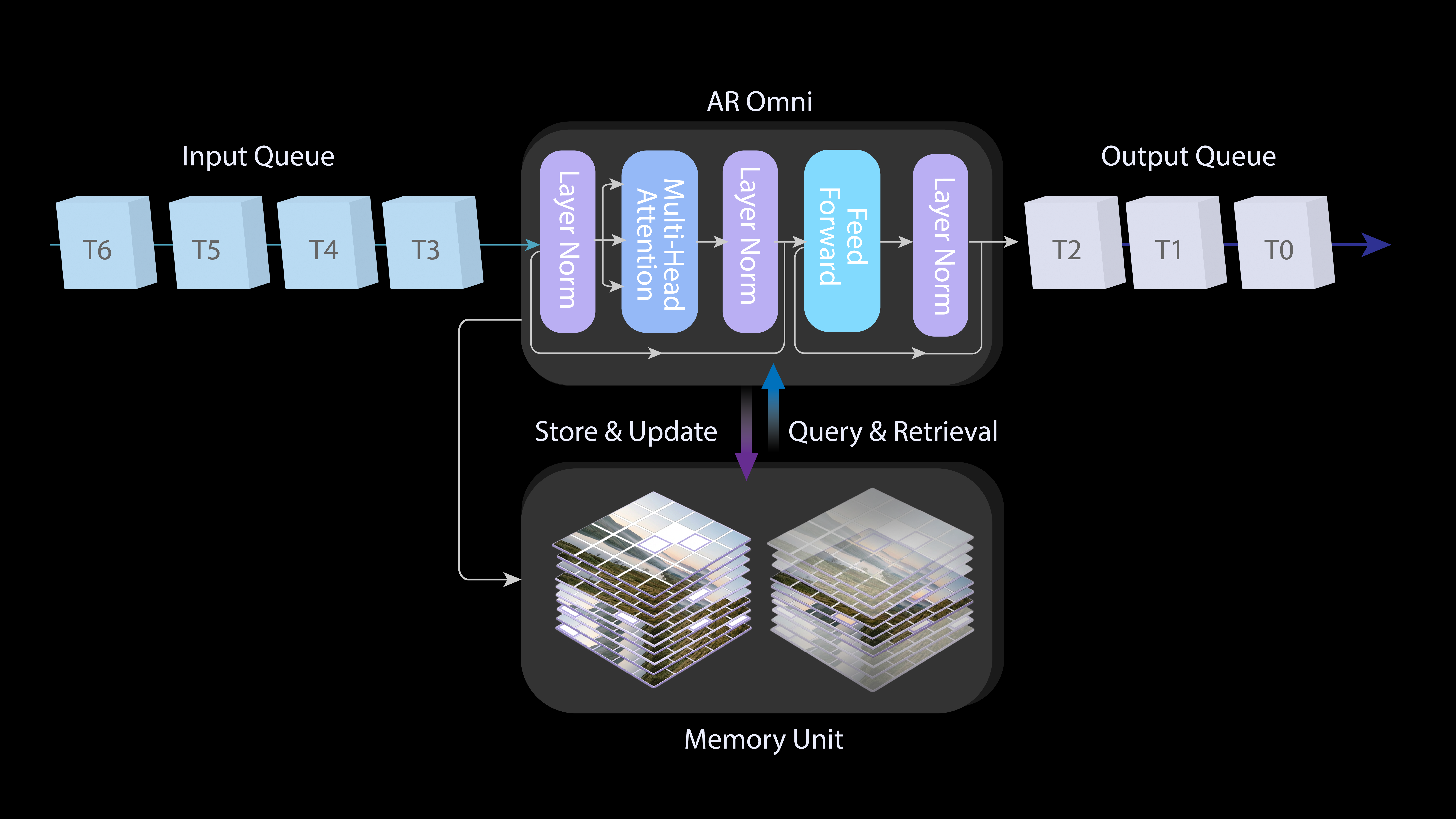

2.2 Memory:通过自回归机制实现一致的无限流式传输

与受限于有限片段的标准扩散方法不同,PixVerse-R1 集成了自回归建模以实现无限、连续的视觉流式传输,并结合记忆增强注意力机制以确保生成的世界在长时间范围内保持物理一致性。

- 无限流式传输: 通过将视频合成表述为自回归过程,模型顺序预测后续帧以实现连续、无界的视觉流式传输。

- 时间一致性: 记忆增强注意力机制将当前帧的生成条件化于前序上下文的潜在表示,确保世界在长时间范围内保持物理一致性。

图 2. 与 Omni 基础模型集成的自回归建模。

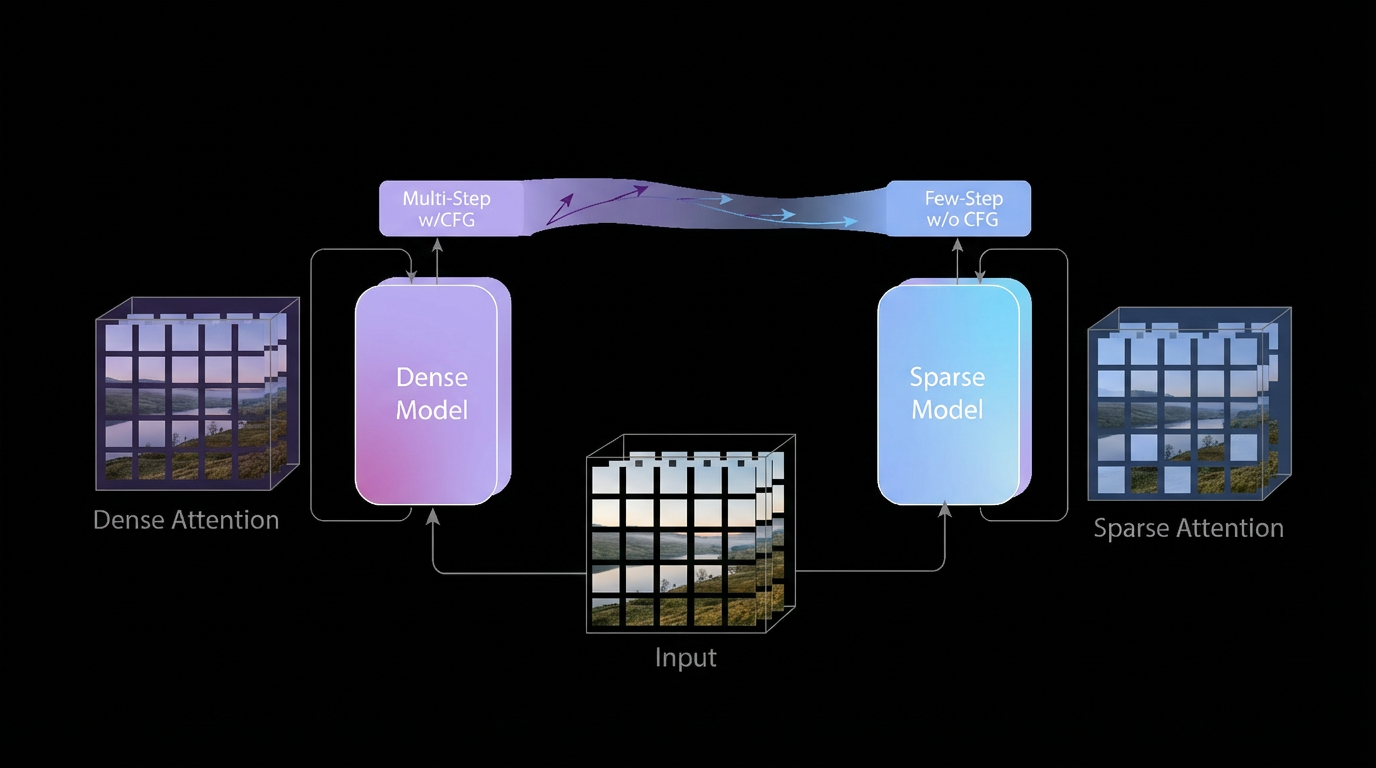

2.3 实时 1080P:即时响应引擎

虽然迭代去噪通常能确保高质量,但其计算密度往往阻碍了实时性能。为解决这一问题并实现高分辨率(高达 1080P)的实时生成,我们将流程重新架构为即时响应引擎(IRE)。

IRE 通过以下改进优化采样过程:

- 时间轨迹折叠: 通过实现直接传输映射作为结构先验,网络直接预测干净数据分布。这将采样步骤从数十步减少到仅 1-4 步,创建了对超低延迟至关重要的精简路径。

- 引导校正: 我们通过将条件梯度合并到学生模型中,绕过了无分类器引导的采样开销。

- 自适应稀疏注意力: 这减轻了长程依赖冗余,产生了一个压缩的计算图,进一步促进了实时 1080P 生成的实现。

图 3. 即时响应引擎由三个模块组成:时间轨迹折叠、引导校正和自适应稀疏注意力学习。

3. 应用与社会影响

PixVerse-R1 引入了一种新的生成媒介:实时、连续和有状态的视听系统。与预渲染视频不同,这种媒介作为一个持久过程运行,能够即时响应用户意图,其中生成和交互紧密耦合。这种新媒介支持广泛的交互系统,包括但不限于:

-

交互媒体

- AI 原生游戏和交互式电影体验

- 实时 VR/XR 和沉浸式模拟

-

创意与教育系统

- 自适应媒体艺术和交互式装置

- 实时学习和培训环境

-

模拟与规划

- 实验研究和场景探索

- 工业、农业和生态模拟

除特定应用外,PixVerse-R1 作为连续视听世界模拟器运行,缩短了人类意图与系统响应之间的距离,并在持久数字环境中实现了新形式的人机协作创作。

4. 结论

PixVerse-R1 引入了一个实时生成框架,通过多模态处理和即时响应的架构创新,克服了传统视频工作流程的固有限制。通过实现一致的实时生成,该模型标志着视听媒体创作和体验的重大进化。向实时延迟的转变使从静态内容消费向动态环境交互的过渡成为可能,为从 AI 原生游戏到复杂工业模拟的应用提供了可扩展的计算基础。通过弥合用户意图与即时视觉反馈之间的差距,该系统为交互式世界建模和人机协作环境建立了新的前沿。

5. 局限性

虽然 PixVerse-R1 提供了显著的建模优势,但在时间准确性和物理保真度方面仍存在两个主要限制:

- 时间误差累积: 在长序列中,较小的预测误差可能会累积,可能损害模拟的结构完整性。

- 物理与计算权衡: 为成功实现实时生成,在生成复杂度方面做出了特定牺牲。因此,与非实时模型相比,在某些物理定律的精确渲染方面可能存在一定程度的损失。