PixVerse-R1: Modelo Mundial em Tempo Real de Nova Geração

Apresentamos o PixVerse-R1, um modelo mundial em tempo real de nova geração construído sobre um modelo fundacional multimodal nativo. Este sistema permite a geração de vídeo em tempo real onde o conteúdo visual responde instantânea e fluidamente à entrada do usuário.

📘 Nota de tradução: Este artigo foi traduzido da versão original em inglês. Para os detalhes técnicos mais precisos, consulte a versão original em inglês.

PixVerse-R1: Modelo Mundial em Tempo Real de Nova Geração

Resumo

Apresentamos o PixVerse-R1, um modelo mundial em tempo real de nova geração arquitetado sobre um modelo fundacional multimodal nativo. Este sistema permite a geração de vídeo em tempo real onde o conteúdo visual responde instantânea e fluidamente à entrada do usuário. Ao superar as restrições inerentes de latência e comprimento fixo dos fluxos de trabalho de vídeo tradicionais, o PixVerse-R1 transforma a geração de vídeo em um fluxo visual infinito, contínuo e interativo. Isso representa uma evolução significativa na criação, experiência e compartilhamento de mídia audiovisual, marcando uma mudança de paradigma em direção a mídias inteligentes e interativas capazes de se adaptar instantaneamente com base na intenção do usuário.

1. Introdução

O panorama da mídia digital está mudando fundamentalmente do conteúdo estático pré-renderizado para experiências dinâmicas e interativas. Os pipelines de produção convencionais têm sido historicamente restringidos por alta latência e clipes de comprimento fixo, criando uma dicotomia entre a criação de conteúdo e o consumo em tempo real.

Para abordar essas limitações, introduzimos uma arquitetura de modelo mundial inovadora que unifica um modelo fundacional multimodal nativo, um mecanismo autorregressivo de consistência e um motor de resposta instantânea. Esta abordagem unificada permite o processamento conjunto de patches espaço-temporais juntamente com dados de texto e áudio, eliminando efetivamente os silos tradicionais de processamento de mídia. Ao implantar um sistema capaz de streaming infinito através de um mecanismo autorregressivo e um motor de resposta instantânea, o mundo gerado permanece fisicamente consistente ao longo de horizontes longos com baixa sobrecarga computacional.

Capacidade Chave: Aproveitando esta arquitetura, nosso sistema alcança um avanço em desempenho, gerando vídeo de alta resolução até 1080P em tempo real. Esta capacidade melhora a fidelidade visual e permite jogos AI-nativos e cinema interativo, onde ambientes e narrativas evoluem dinamicamente em resposta à interação do usuário. De forma mais ampla, isso permite que sistemas generativos funcionem como mundos persistentes e interativos em vez de artefatos de mídia finitos, indicando uma trajetória em direção a simulações audiovisuais contínuas, com estado e interativas.

2. Arquitetura Técnica

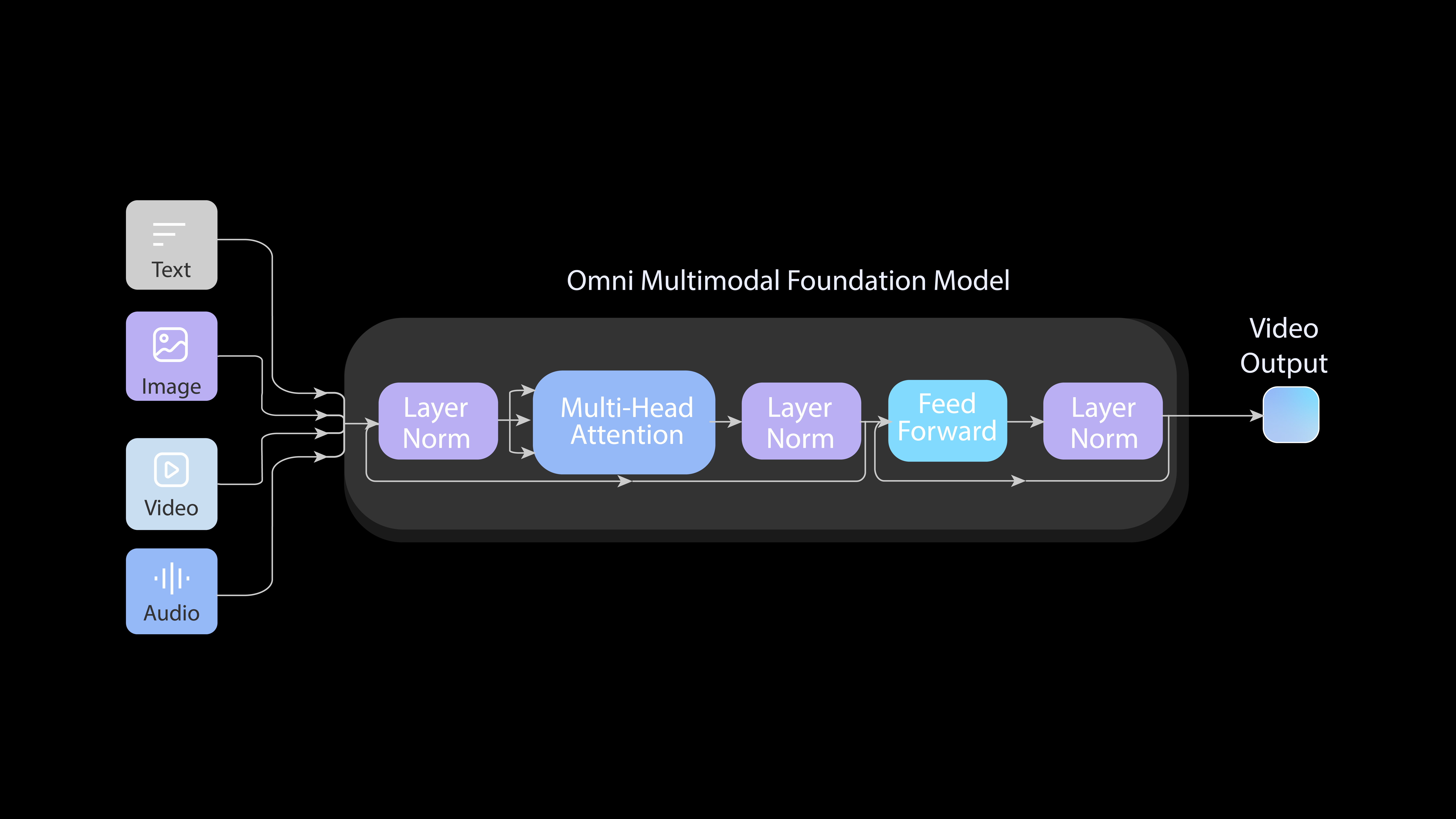

2.1 Omni: Modelo Fundacional Multimodal Nativo

Para alcançar capacidades gerais, transcendemos os pipelines de geração tradicionais projetando um Modelo Fundacional Multimodal Nativo totalmente end-to-end.

- Representação Unificada: O modelo Omni unifica diversas modalidades (texto, imagem, vídeo, áudio) em um fluxo contínuo de tokens, permitindo aceitar entradas multimodais arbitrárias dentro de um único framework.

- Treinamento End-to-End: Toda a arquitetura é treinada em tarefas heterogêneas sem interfaces intermediárias, prevenindo a propagação de erros e garantindo escalabilidade robusta.

- Resolução Nativa: Utilizamos treinamento de resolução nativa dentro deste framework para evitar artefatos tipicamente associados ao corte ou redimensionamento.

Além disso, o modelo internaliza as leis físicas intrínsecas e dinâmicas do mundo real ao aprender de um corpus massivo de dados de vídeo do mundo real. Esta compreensão fundamental capacita o sistema a sintetizar um “mundo paralelo” consistente e responsivo em tempo real.

O modelo Omni escala efetivamente, funcionando não apenas como um motor generativo, mas como um passo pioneiro em direção à construção de simuladores de propósito geral do mundo físico. Ao tratar a tarefa de simulação como um paradigma de geração end-to-end único, facilitamos a exploração de mundos gerados por IA em tempo real e de longo prazo.

Figura 1. A arquitetura end-to-end do nosso Modelo Fundacional Multimodal Nativo Omni. O design unificado permite que nosso modelo Omni aceite entradas multimodais arbitrárias e gere áudio e vídeo ao mesmo tempo.

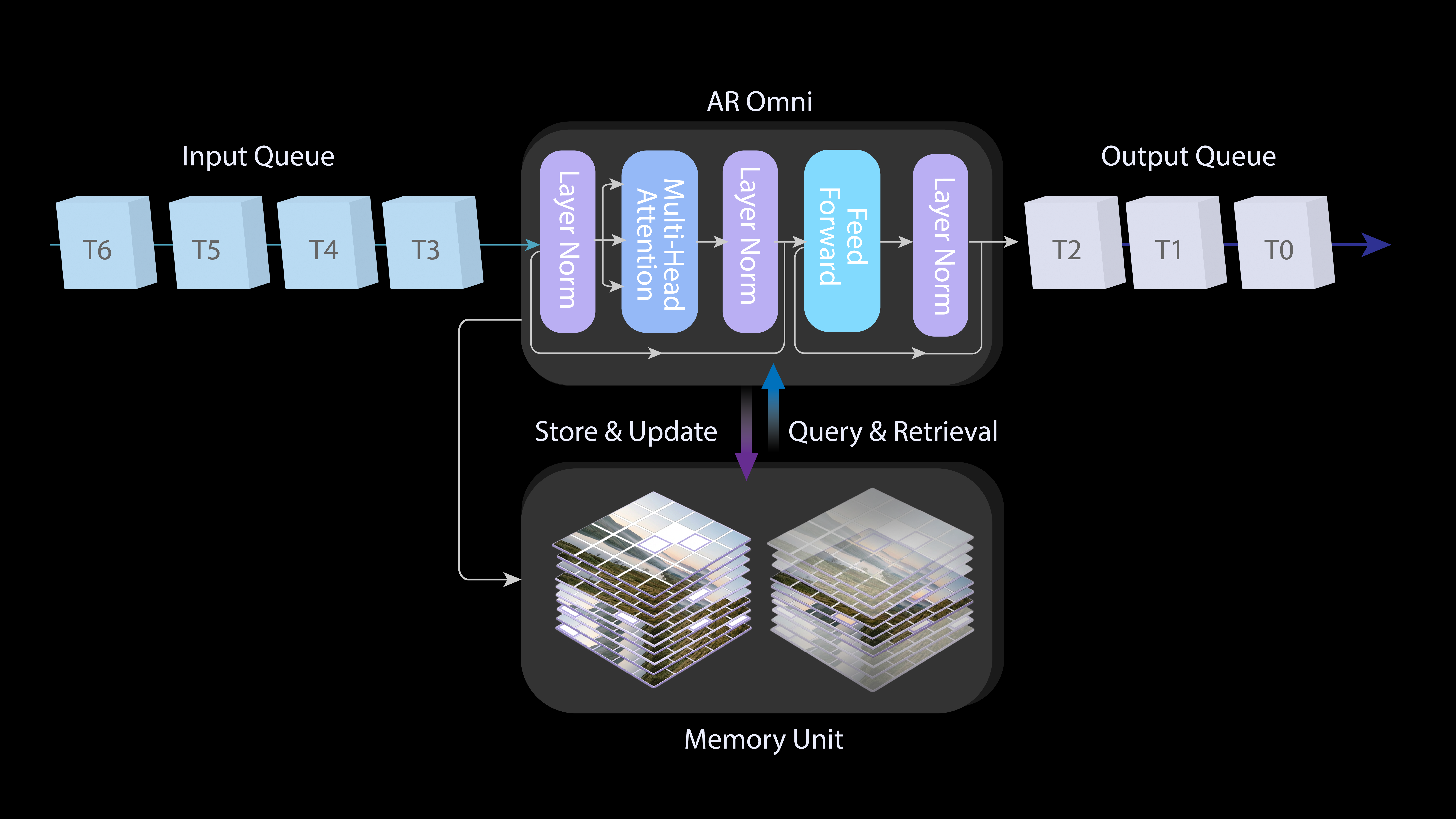

2.2 Memory: Streaming Infinito Consistente via Mecanismo Autorregressivo

Diferentemente dos métodos de difusão padrão restritos a clipes finitos, o PixVerse-R1 integra modelagem autorregressiva para permitir streaming visual infinito e contínuo, e incorpora um mecanismo de atenção aumentado por memória para garantir que o mundo gerado permaneça fisicamente consistente ao longo de horizontes longos.

- Streaming Infinito: Ao formular a síntese de vídeo como um processo autorregressivo, o modelo prevê sequencialmente frames subsequentes para alcançar streaming visual contínuo e ilimitado.

- Consistência Temporal: Um mecanismo de atenção aumentado por memória condiciona a geração do frame atual nas representações latentes do contexto precedente, garantindo que o mundo permaneça fisicamente consistente ao longo de horizontes longos.

Figura 2. A modelagem autorregressiva integrada com o modelo fundacional Omni.

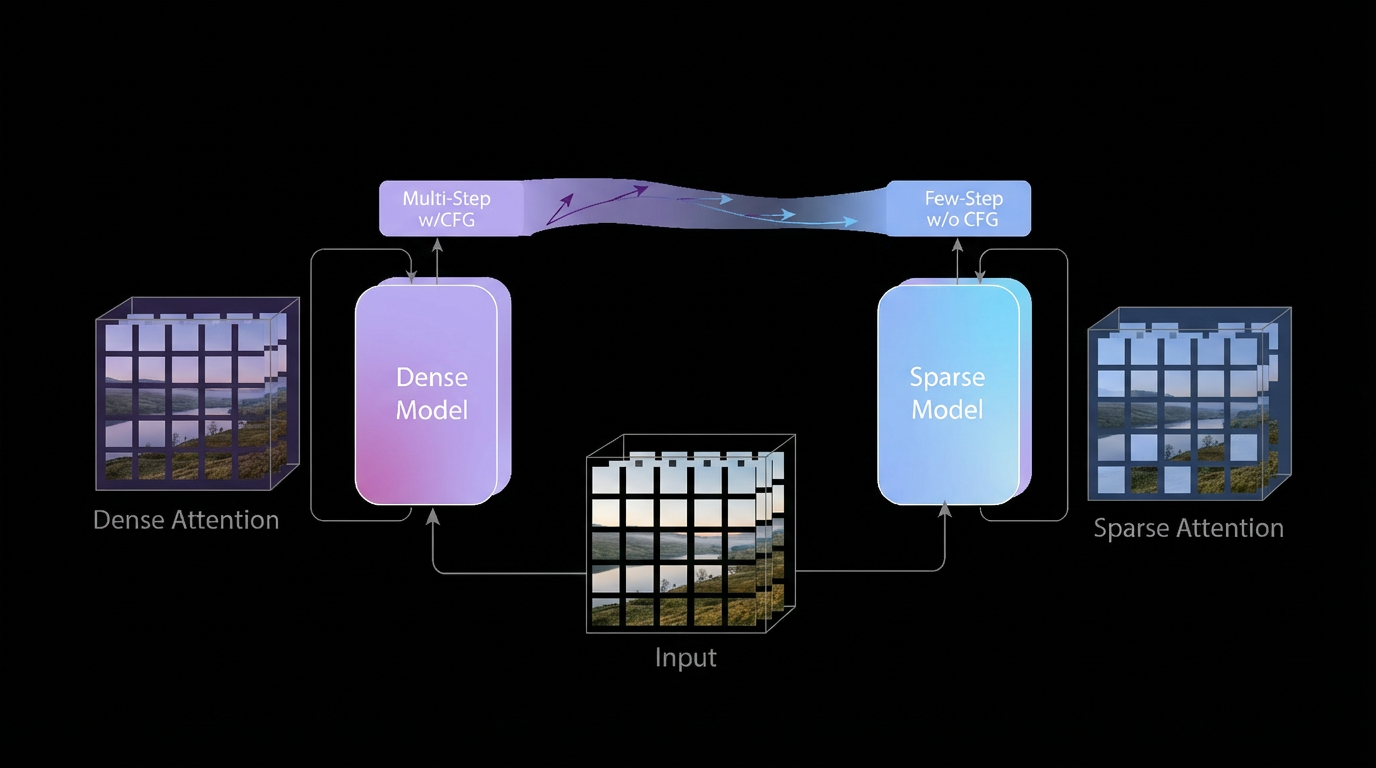

2.3 1080P em Tempo Real: Motor de Resposta Instantânea

Enquanto o denoising iterativo tipicamente garante alta qualidade, sua densidade computacional frequentemente impede o desempenho em tempo real. Para resolver isso e alcançar geração em tempo real em altas resoluções (até 1080P), re-arquitetamos o pipeline em um Motor de Resposta Instantânea.

O IRE otimiza o processo de amostragem através dos seguintes avanços:

- Dobramento de Trajetória Temporal: Implementando Direct Transport Mapping como prior estrutural, a rede prevê a distribuição de dados limpa diretamente. Isso reduz os passos de amostragem de dezenas para apenas 1–4, criando um caminho otimizado essencial para latência ultra-baixa.

- Retificação de Orientação: Contornamos a sobrecarga de amostragem do Classifier-Free Guidance fundindo gradientes condicionais no modelo estudante.

- Atenção Esparsa Adaptativa: Isso mitiga a redundância de dependências de longo alcance, produzindo um grafo computacional condensado que facilita ainda mais a realização da geração 1080P em tempo real.

Figura 3. O motor de resposta instantânea consiste em três módulos: dobramento de trajetória temporal, retificação de orientação e aprendizado de atenção esparsa adaptativa.

3. Aplicações e Impacto Social

O PixVerse-R1 introduz um novo meio generativo: sistemas audiovisuais em tempo real, contínuos e com estado. Diferentemente do vídeo pré-renderizado, este meio opera como um processo persistente que responde instantaneamente à intenção do usuário, onde geração e interação estão fortemente acopladas. Este novo meio permite uma ampla classe de sistemas interativos, incluindo, mas não limitado a:

-

Mídia Interativa

- Jogos AI-nativos e experiências cinematográficas interativas

- VR/XR em tempo real e simulações imersivas

-

Sistemas Criativos e Educacionais

- Arte de mídia adaptativa e instalações interativas

- Ambientes de aprendizagem e treinamento em tempo real

-

Simulação e Planejamento

- Pesquisa experimental e exploração de cenários

- Simulações industriais, agrícolas e ecológicas

Além de aplicações específicas, o PixVerse-R1 funciona como um simulador de mundo audiovisual contínuo, reduzindo a distância entre a intenção humana e a resposta do sistema, e possibilitando novas formas de co-criação humano-IA dentro de ambientes digitais persistentes.

4. Conclusão

O PixVerse-R1 introduz um framework de geração em tempo real que supera as limitações inerentes dos fluxos de trabalho de vídeo tradicionais através de inovações arquitetônicas em processamento multimodal e resposta instantânea. Ao permitir geração consistente em tempo real, este modelo marca uma evolução significativa na criação e experiência de mídia audiovisual. A mudança para latência em tempo real permite uma transição do consumo de conteúdo estático para a interação dinâmica com o ambiente, fornecendo um substrato computacional escalável para aplicações que vão de jogos AI-nativos a simulações industriais complexas. Ao preencher a lacuna entre a intenção do usuário e o feedback visual instantâneo, o sistema estabelece uma nova fronteira para modelagem de mundos interativos e ambientes colaborativos humano-IA.

5. Limitações

Embora o PixVerse-R1 ofereça vantagens significativas de modelagem, duas restrições primárias persistem em relação à precisão temporal e fidelidade física:

- Acumulação de Erro Temporal: Ao longo de sequências estendidas, pequenos erros de previsão podem se acumular, potencialmente comprometendo a integridade estrutural da simulação.

- Compensação Física vs. Computação: Para alcançar com sucesso a geração em tempo real, sacrifícios específicos foram feitos em relação à complexidade de geração. Consequentemente, pode haver certo grau de perda na representação precisa de algumas leis físicas em comparação com modelos não em tempo real.