PixVerse-R1: Modelo Mundial en Tiempo Real de Nueva Generación

Presentamos PixVerse-R1, un modelo mundial en tiempo real de nueva generación construido sobre un modelo fundacional multimodal nativo. Este sistema permite la generación de video en tiempo real donde el contenido visual responde instantánea y fluidamente a la entrada del usuario.

📘 Nota de traducción: Este artículo fue traducido de la versión original en inglés. Para los detalles técnicos más precisos, consulte la versión original en inglés.

PixVerse-R1: Modelo Mundial en Tiempo Real de Nueva Generación

Resumen

Presentamos PixVerse-R1, un modelo mundial en tiempo real de nueva generación construido sobre un modelo fundacional multimodal nativo. Este sistema permite la generación de video en tiempo real donde el contenido visual responde instantánea y fluidamente a la entrada del usuario. Al superar las restricciones inherentes de latencia y longitud fija de los flujos de trabajo de video tradicionales, PixVerse-R1 transforma la generación de video en un flujo visual infinito, continuo e interactivo. Esto representa una evolución significativa en la creación, experiencia y compartición de medios audiovisuales, marcando un cambio de paradigma hacia medios inteligentes e interactivos capaces de adaptarse instantáneamente según la intención del usuario.

1. Introducción

El panorama de los medios digitales está cambiando fundamentalmente del contenido estático prerenderizado hacia experiencias dinámicas e interactivas. Los pipelines de producción convencionales han estado históricamente restringidos por alta latencia y clips de longitud fija, creando una dicotomía entre la creación de contenido y el consumo en tiempo real.

Para abordar estas limitaciones, introducimos una arquitectura de modelo mundial novedosa que unifica un modelo fundacional multimodal nativo, un mecanismo autoregresivo de consistencia y un motor de respuesta instantánea. Este enfoque unificado permite el procesamiento conjunto de parches espaciotemporales junto con datos de texto y audio, eliminando efectivamente los silos tradicionales de procesamiento de medios. Al desplegar un sistema capaz de streaming infinito a través de un mecanismo autoregresivo y un motor de respuesta instantánea, el mundo generado permanece físicamente consistente durante largos horizontes con baja sobrecarga computacional.

Capacidad Clave: Aprovechando esta arquitectura, nuestro sistema logra un avance en rendimiento, generando video de alta resolución hasta 1080P en tiempo real. Esta capacidad mejora la fidelidad visual y permite juegos AI-nativos y cine interactivo, donde los entornos y narrativas evolucionan dinámicamente en respuesta a la interacción del usuario. En términos más amplios, esto permite que los sistemas generativos funcionen como mundos persistentes e interactivos en lugar de artefactos de medios finitos, indicando una trayectoria hacia simulaciones audiovisuales continuas, con estado e interactivas.

2. Arquitectura Técnica

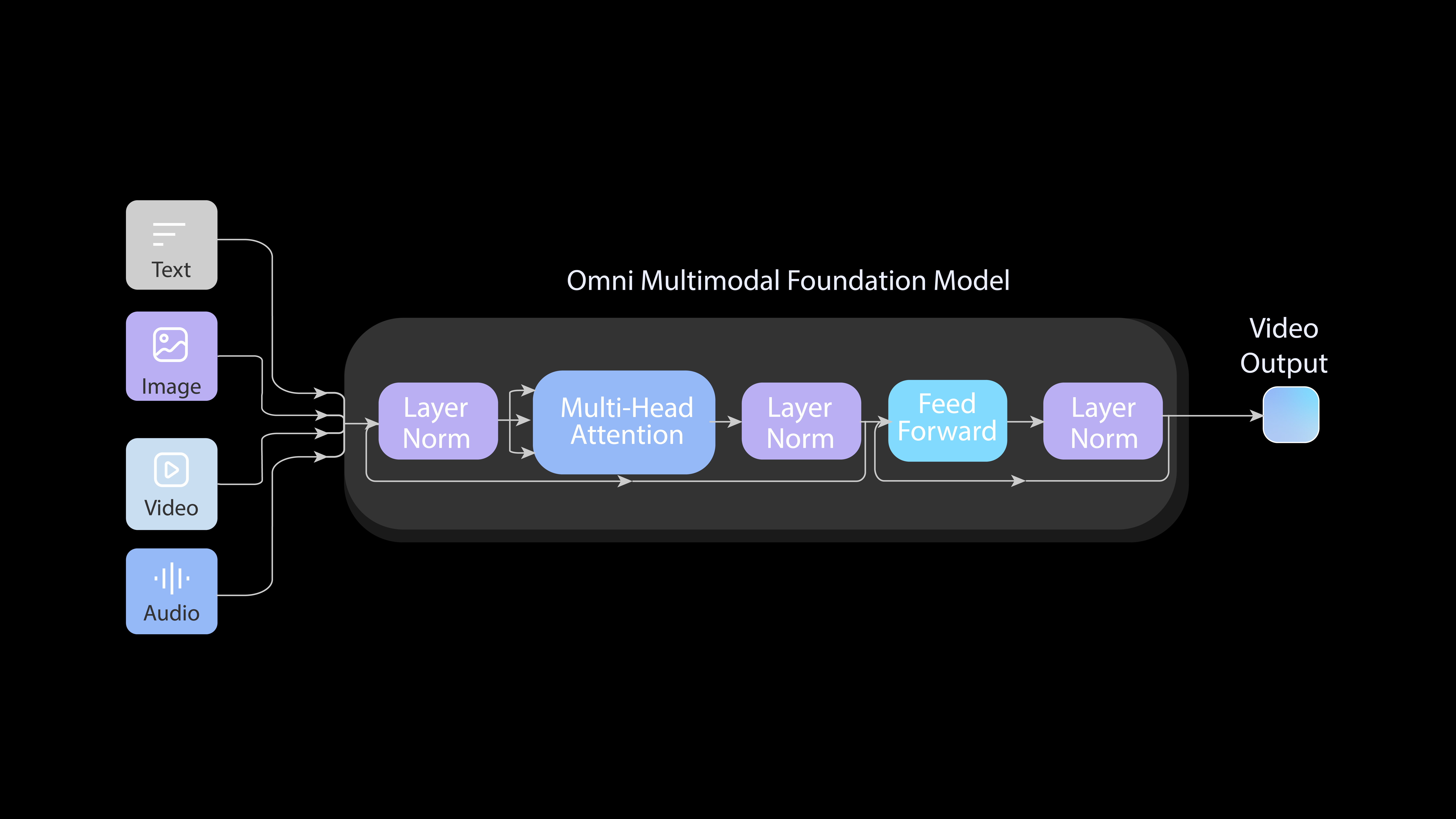

2.1 Omni: Modelo Fundacional Multimodal Nativo

Para alcanzar capacidades generales, trascendimos los pipelines de generación tradicionales diseñando un Modelo Fundacional Multimodal Nativo completamente end-to-end.

- Representación Unificada: El modelo Omni unifica diversas modalidades (texto, imagen, video, audio) en un flujo continuo de tokens, permitiéndole aceptar entradas multimodales arbitrarias dentro de un único framework.

- Entrenamiento End-to-End: Toda la arquitectura se entrena en tareas heterogéneas sin interfaces intermedias, previniendo la propagación de errores y asegurando una escalabilidad robusta.

- Resolución Nativa: Utilizamos entrenamiento de resolución nativa dentro de este framework para evitar artefactos típicamente asociados con el recorte o redimensionamiento.

Además, el modelo internaliza las leyes físicas intrínsecas y dinámicas del mundo real al aprender de un corpus masivo de datos de video del mundo real. Esta comprensión fundacional empodera al sistema para sintetizar un “mundo paralelo” consistente y receptivo en tiempo real.

El modelo Omni escala efectivamente, funcionando no solo como un motor generativo, sino como un paso pionero hacia la construcción de simuladores de propósito general del mundo físico. Al tratar la tarea de simulación como un paradigma de generación end-to-end singular, facilitamos la exploración de mundos generados por IA en tiempo real y a largo plazo.

Figura 1. La arquitectura end-to-end de nuestro Modelo Fundacional Multimodal Nativo Omni. El diseño unificado permite que nuestro modelo Omni acepte entradas multimodales arbitrarias y genere audio y video al mismo tiempo.

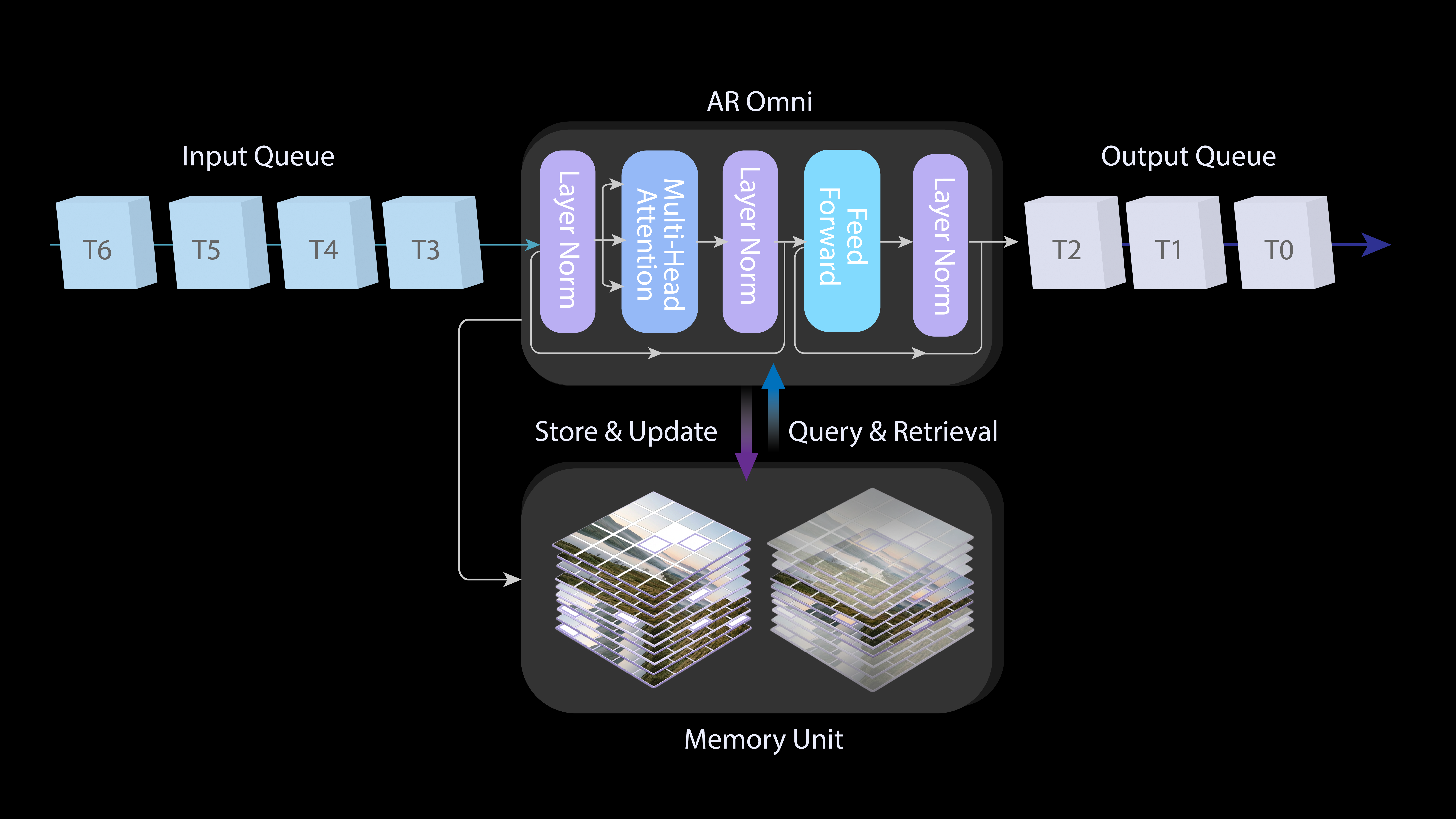

2.2 Memory: Streaming Infinito Consistente via Mecanismo Autoregresivo

A diferencia de los métodos de difusión estándar restringidos a clips finitos, PixVerse-R1 integra modelado autoregresivo para permitir streaming visual infinito y continuo, e incorpora un mecanismo de atención aumentado por memoria para asegurar que el mundo generado permanezca físicamente consistente durante largos horizontes.

- Streaming Infinito: Al formular la síntesis de video como un proceso autoregresivo, el modelo predice secuencialmente frames subsecuentes para lograr streaming visual continuo e ilimitado.

- Consistencia Temporal: Un mecanismo de atención aumentado por memoria condiciona la generación del frame actual en las representaciones latentes del contexto precedente, asegurando que el mundo permanezca físicamente consistente durante largos horizontes.

Figura 2. El modelado autoregresivo integrado con el modelo fundacional Omni.

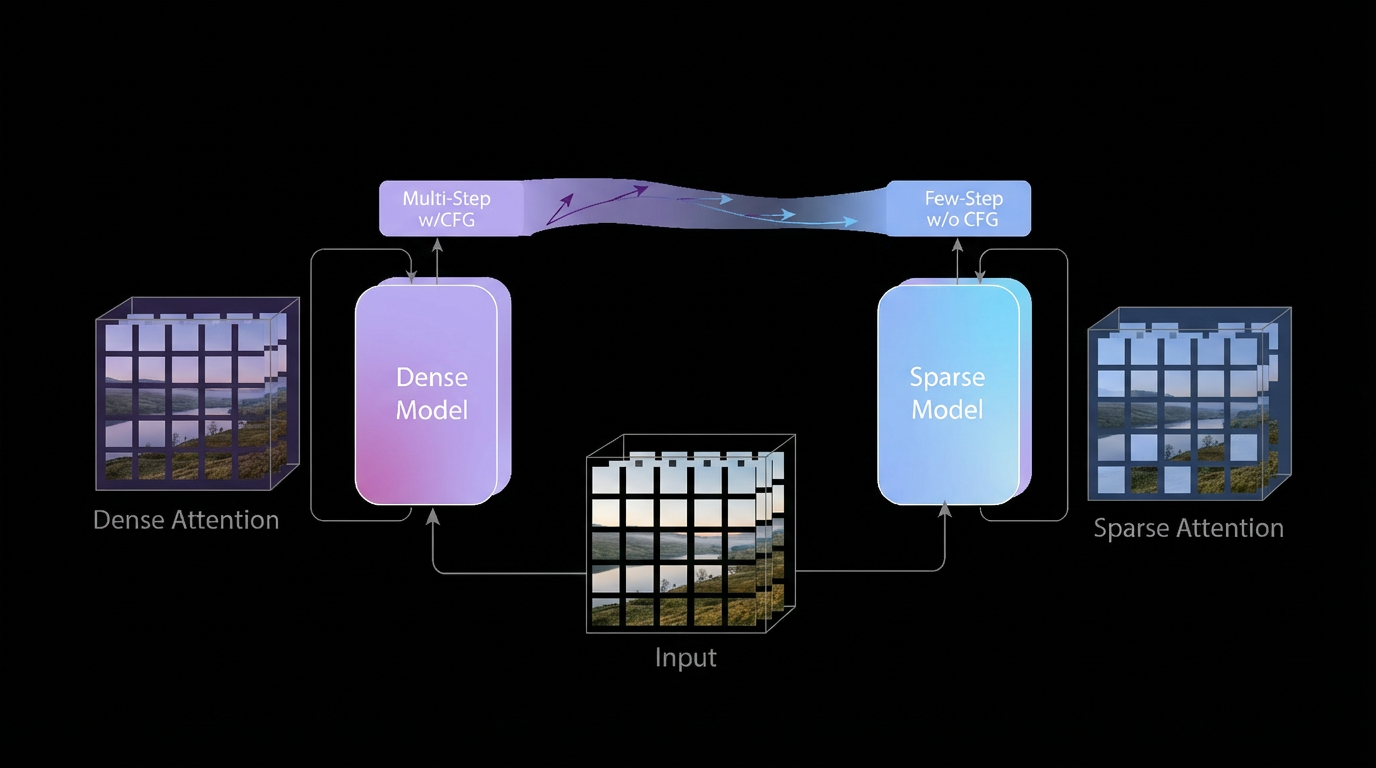

2.3 1080P en Tiempo Real: Motor de Respuesta Instantánea

Mientras que el denoising iterativo típicamente asegura alta calidad, su densidad computacional a menudo impide el rendimiento en tiempo real. Para resolver esto y lograr generación en tiempo real a altas resoluciones (hasta 1080P), re-arquitecturamos el pipeline en un Motor de Respuesta Instantánea.

El IRE optimiza el proceso de muestreo a través de los siguientes avances:

- Plegado de Trayectoria Temporal: Implementando Direct Transport Mapping como prior estructural, la red predice la distribución de datos limpia directamente. Esto reduce los pasos de muestreo de docenas a solo 1–4, creando un camino optimizado esencial para ultra-baja latencia.

- Rectificación de Guía: Evitamos la sobrecarga de muestreo de Classifier-Free Guidance fusionando gradientes condicionales en el modelo estudiante.

- Atención Dispersa Adaptativa: Esto mitiga la redundancia de dependencias de largo alcance, produciendo un grafo computacional condensado que facilita aún más la realización de generación 1080P en tiempo real.

Figura 3. El motor de respuesta instantánea consta de tres módulos: plegado de trayectoria temporal, rectificación de guía y aprendizaje de atención dispersa adaptativa.

3. Aplicaciones e Impacto Social

PixVerse-R1 introduce un nuevo medio generativo: sistemas audiovisuales en tiempo real, continuos y con estado. A diferencia del video prerenderizado, este medio opera como un proceso persistente que responde instantáneamente a la intención del usuario, donde la generación y la interacción están estrechamente acopladas. Este nuevo medio permite una amplia clase de sistemas interactivos, incluyendo pero no limitado a:

-

Medios Interactivos

- Juegos AI-nativos y experiencias cinematográficas interactivas

- VR/XR en tiempo real y simulaciones inmersivas

-

Sistemas Creativos y Educativos

- Arte de medios adaptativos e instalaciones interactivas

- Entornos de aprendizaje y formación en tiempo real

-

Simulación y Planificación

- Investigación experimental y exploración de escenarios

- Simulaciones industriales, agrícolas y ecológicas

Más allá de aplicaciones específicas, PixVerse-R1 funciona como un simulador de mundo audiovisual continuo, reduciendo la distancia entre la intención humana y la respuesta del sistema, y permitiendo nuevas formas de co-creación humano-IA dentro de entornos digitales persistentes.

4. Conclusión

PixVerse-R1 introduce un framework de generación en tiempo real que supera las limitaciones inherentes de los flujos de trabajo de video tradicionales a través de innovaciones arquitectónicas en procesamiento multimodal y respuesta instantánea. Al permitir generación consistente en tiempo real, este modelo marca una evolución significativa en la creación y experiencia de medios audiovisuales. El cambio hacia latencia en tiempo real permite una transición del consumo de contenido estático a la interacción dinámica con el entorno, proporcionando un sustrato computacional escalable para aplicaciones que van desde juegos AI-nativos hasta simulaciones industriales complejas. Al cerrar la brecha entre la intención del usuario y la retroalimentación visual instantánea, el sistema establece una nueva frontera para el modelado de mundos interactivos y entornos colaborativos humano-IA.

5. Limitaciones

Mientras que PixVerse-R1 ofrece ventajas significativas de modelado, persisten dos restricciones primarias respecto a la precisión temporal y la fidelidad física:

- Acumulación de Error Temporal: Durante secuencias extendidas, pequeños errores de predicción pueden acumularse, potencialmente comprometiendo la integridad estructural de la simulación.

- Compensación Física vs. Computación: Para lograr con éxito la generación en tiempo real, se hicieron sacrificios específicos respecto a la complejidad de generación. Consecuentemente, puede haber cierto grado de pérdida en la representación precisa de algunas leyes físicas comparado con modelos no en tiempo real.