AIでキャラクターを一貫させる方法:PixVerse V6ガイド

PixVerse V6で参照画像・プロンプト・マルチショット・画像から動画を使い、AI動画で同一人物の顔をクリップ間で安定させる。

キャラクター一貫性のあるAI(Consistent character AI)とは、複数の独立した動画生成にわたり、顔の特徴・体型・衣装の選択を可能な限り一致させるワークフローです。AI動画モデルは過去のクリップを記憶せず、生成のたびに一から始まります。だから「魔法の一文」より、戦略的なアンカーが重要です。モデルを責める前にドリフトを防ぐには、詳細な書面キャラクターシート、正確な参照画像、そして毎回まったく同じ順序のキーワードという三つの核で生成を固定します。

このガイドで学べること:

キャラクターの安定性を保つために必要なワークフローを取り上げます。主な内容は次のとおりです。

- よくある落とし穴: 生成で壊れやすい点と、ドリフトの直し方。

- プロンプトのベストプラクティス: 日々頼っているプロンプトの習慣と、身体の細部の記録方法。

- PixVerse V6 の強み: 業界の痛点と PixVerse V6 の対応を対比するフィールドメモ的な整理。

- PixVerse の手順: プラットフォーム上でキャラクターアイデンティティを固定する具体的なステップ。

- プロンプト例と分析: 実際のプロンプトと短い出力メモ。

- リソースとモード: クレジットと生成モード選びの考え方。

AIキャラクター一貫性を理解する:キャラクタードリフトが起きる理由

真の「一貫性」とは

AI動画における一貫性とは、視聴者がショットAとショットBで同一人物だと瞬時に認識できる状態です。髪色、顎のライン、年齢感、衣装などの核となるアイデンティティは、認識可能な範囲に厳密に収める必要があります。小さなブレは突然の配役交代に見え、大きなブレは物語の没入を壊します。

拡散モデルが一貫性テストに失敗する理由

テキストから動画への拡散モデルは、フレームごとに主体をゼロから再構築します。プロンプト間で形容詞を変えたり、プロジェクト途中でモデルを切り替えたりすると、別人を招き入れるのと同じです。テキストだけは最弱のアンカーです。アイデンティティを固定するには、参照スチルと細かく繰り返したテキストブロックの、より強い引力が必要です。

生成前のブループリント

生成を押す前にベースラインを決めます。顔と髪を一つの段落で、デフォルトの服装を一行、体型が重要なら一行。専用のメモファイルに保存します。このマスタードキュメントが、AIで一貫したキャラクターを作るための基礎ブループリントです。カメラ、照明、環境はシーンごとに変えてよいですが、このアイデンティティブロックは、衣装変更を意図的に脚本に書かない限り変えません。

安定したAIキャラクター向けプロンプトの枠組み

生成インターフェースを開く前から、厳格なプロンプト規律が必要です。プロのワークフローは、幻覚を減らし制御を保つ四つの譲れない習慣に依存します。

-

アイデンティティをアクションより優先(固定順序): まずキャラクター説明を固め、からシーンを組み立てます。プロンプトは必ず主体のアイデンティティから始め、次に動作、環境、最後にスタイルや技術パラメータ(カメラ角や照明など)です。

-

語彙をロック: 一貫性には同一の言い回しが必要です。髪を「肩までのダークブラウン」と決めたら、次のクリップで軽く「ブルネット」に変えないでください。AIは別の視覚トークンとして扱います。

-

ネガティブプロンプトを活用: UIが許す限り、出てはいけないものを列挙します。誤った年齢帯、キャラがかけていないのに眼鏡、フレームをきれいに保つための「重複した顔」などのフレーズを含めます。

-

テンプレートを作り複製: メモから書き直さないでください。最も安定した成功プロンプトをマスターテキストとして保存し、毎回複製します。核となるアイデンティティブロックは一切触らず、シーン固有の動作行だけを編集します。

フィールドノート:標準ワークフローがキャラクター一貫性で失敗する理由

複数の主要テキストから動画スタックをテストし、複数ショットで一人の主役を維持できるか検証しました。プロンプトエンジニアリングを尽くしても、同じ技術的壁に何度もぶつかりました。

次の表は、遭遇した四つの主要な摩擦点をまとめたものです。

| 課題 | 視覚的な結果 |

|---|---|

| 長さの上限 | 短いクリップを継ぎ足すため、継ぎ目ごとにアイデンティティが歪みます。 |

| テキストのみの制限 | 視覚アンカーがないと、顔の幾何(目の間隔・鼻の形など)が常にズレます。 |

| 連続性の欠如 | ワイドからクローズへ切ると、似た服を着た別俳優に見替わったように感じます。 |

| ワークフローの摩擦 | プロンプト字数が低く音画が分断されると、複雑な物語はほぼ不可能です。 |

転換点:なぜ私たちはPixVerseに移ったか

私たちが必要だったのは「より良いプロンプト」ではなく、より賢い動画エンジンでした。PixVerse V6 を開発したのは、テストのどこでも同じボトルネックに繰り返し当たったからです。顔を保つためにショットごとにモデルと格闘するのではなく、第一フレームから生成プロセスにアイデンティティを焼き込むワークフローを構築しました。

同じテストプロジェクトを PixVerse V6 に移しました。以下では、上記の各問題に製品機能がどう対応するかを対応付けます。詳細は公開中のV6レビューと社内プロダクトノートと一致します。

-

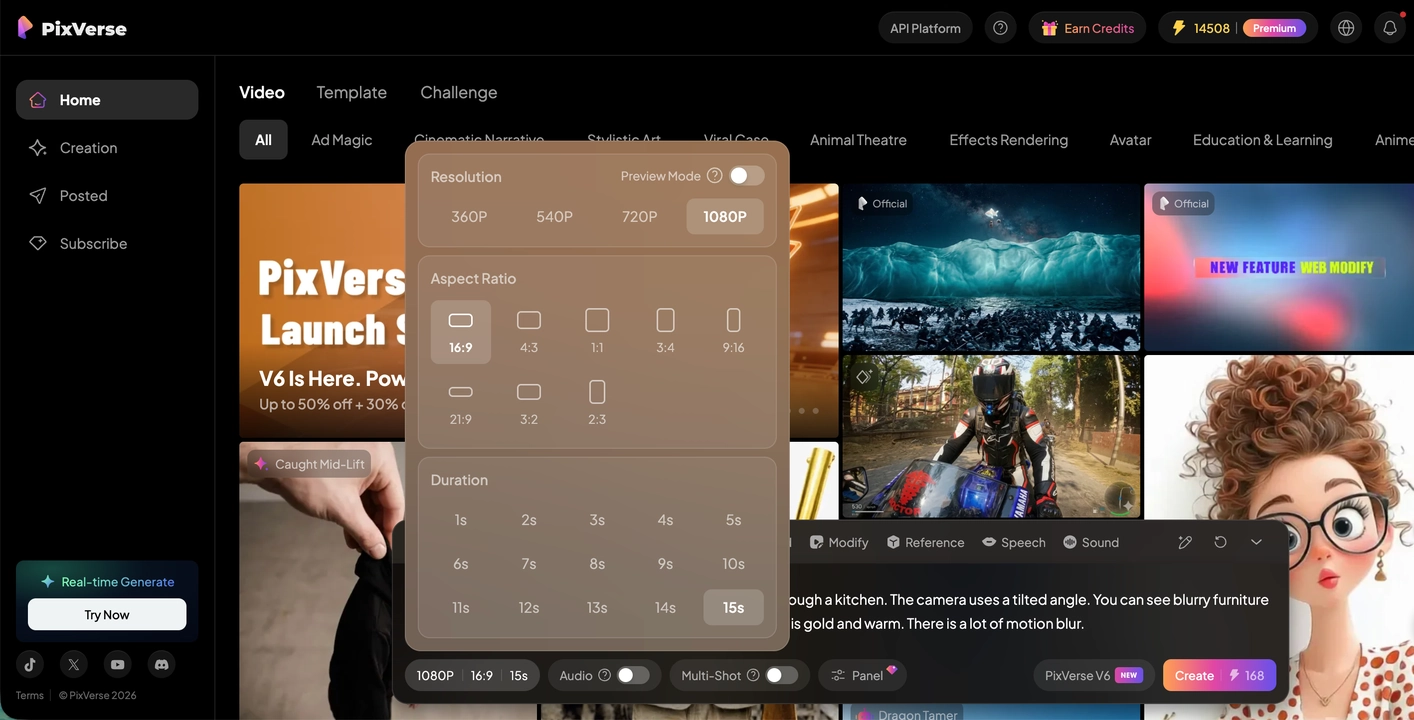

短いクリップと継ぎ目 → 一回の生成を長く(最長約15秒)、最大1080p、16:9から9:16までの比率で回せます。強制カットが減れば、ファイル間でグレーディングや顔の幾何がリセットされる箇所も減ります。

-

テキストのみのドリフト → テキストから動画と画像から動画が同一フローにあります。同じアイデンティティ段落に、開始フレームとして明瞭な肖像を足すと、テキスト単独より顔が範囲内に留まりやすくなりました。

-

孤立テイクと弱いショット間ロジック → マルチショットにより、シーンが複数角度を要するときに一つのジョブで複数のビートや角度を書けます。別出力を継ぎ足すときのように世界と衣装が毎回リセットされません。

-

プロンプトの窮屈さ → 大きなプロンプト余裕により、キャラクターブロックとシーンブロックを一つの欄に置け、メモアプリとUIの往復が減ります。

-

音と絵の分離 → ネイティブオーディオが同じレンダーに含まれるため、雰囲気と演技を一パスで書け、別ツールで同期を追う必要が減ります。

-

表情中心の物語 → 布、重量、顔の動きに説得力のあるモーションにチューニングされており、ワイドの確立ショットだけでなくクローズの演技で物語が進むときに効きます。

-

反復コスト → プレビューやオフピーク的モードがあり、フル尺レンダーにクレジットを使う前に安いパスで試せます。

そのため以下の手順はPixVerse V6を軸に書いていますが、前半の習慣はどのツールでも有効です。

PixVerse V6でキャラクター一貫の動画を生成する手順

-

PixVerse アカウントにサインインします。

-

作成パネルで動画セクションを開きます。

-

モデル一覧から PixVerse V6 を選びます。

-

パラメータを設定:尺、アスペクト比、解像度、音声の有無。UIにモーション強度などがあれば、初回が荒すぎる場合は下げて再生成します。

-

プロンプトを入力 — キャラクターとシーンを書きます。気に入った肖像があれば画像から動画の開始フレームとしてアップロードします。マルチショットやショット単位の欄があれば、一つのジョブで複数角度を書けます。核となる外見の行を繰り返すと揃いやすくなります。

-

生成をクリックし、結果を確認します。

テキストだけで顔がまだズレるなら、形容詞をいじるより一枚の明瞭な参照の方がアイデンティティを安定させやすいです。

AIキャラクター一貫性のための実践プロンプト(動画付き)

以下の日本語プロンプトは社内V6の表情・ダンス検証と対応しています。各シナリオにサンプル動画を付けています。

窓際の感情クローズアップ

Prompt:

若い女性が窓際に立ち、ガラス越しに外の世界を見つめている。瞳は少し赤い。カメラがゆっくり寄る。呼吸は少し速い。唇を噛む。瞳に涙が光る。感情に身を震わせている。

観察:同じマスタースチルで画像から動画を率いたとき、アイデンティティは安定しました。目の比率と顎は二回の再生成でも許容範囲内。スチルなしの純テキスト再生成では顎が柔らかく、まぶたの折れが変わりました。モーションは穏やかで、一貫キャラの質は主に参照の規律に左右され、モーションブラーではありませんでした。

扇子で隠した悲しい表情

Prompt:

少女は深い悲しみで眉をひそめる。両目から涙がゆっくり流れる。扇子で顔の下半分を隠し、目だけが見える。

観察:顔の半分隠しはストレステストです。扇子の位置が試行間で揃うと、目周りのアイデンティティは保たれやすいです。プロンプトで扇子の色だけ変えると頬の陰影がわずかに変わりました。教訓:小物が認識の手がかりなら、クリップ間で小物の表現を揃えてください。

舞踊から顔への着地

Prompt:

低い角度からカメラが上向きに傾きながら、伝統的な中国服の女性が古典舞踊をする。カメラは彼女の顔のクローズアップへ移る。彼女は微笑み、レンズに向かってウインクする。

観察:大きな体の動きに顔の着地が続く場面ではマルチショットが効きます。一つの生成でクローズの前に衣装と髪を保ちやすいです。ウィンク前後で眉の形も比較しました。一回の生成でわずかな非対称が出ました。SNS向けなら許容、ヒーローポスター向けでは厳しいレベルです。

一貫キャラAIジェネレーター:PixVerseがスタックのどこに入るか

実務では、画像・動画・参照主導モデルが同一アカウントを共有するため、PixVerseは一貫キャラ向けの生成スタックになり得ます。V6は物語クリップの経路を担い、同じスタック上の他モデルが別役割を担います。一つのチェックボックスで「世界一の一貫キャラAI」を選ぶのではなく、納品物に合わせてモードを選びます:まず静止画、次に動きはV6、一枚のJPEGでは足りないアンカーが必要なら参照重視の動画モデルへ。

よくある質問

キャラクター一貫性AIとは?

複数生成にわたり視覚的アイデンティティを安定させるパイプラインで、通常はテキストブロックと参照を組み合わせます。

予算が小さいとき、どうやって一貫キャラを作る?

日次クレジットで参照と固定テキストを検証してから、尺や解像度を上げます。

すべてのプロジェクトでPixVerse V6が「最高の」一貫キャラ選択か?

マルチショットと音声のある短尺動画では強いデフォルトです。静止のみのパイプラインは画像ツールのままでもよいです。納品物に合わせてツールを選びます。

日次クレジット、無料枠、料金は一貫キャラワークフローにどう影響する?

新規アカウントには通常、動画作成で使える日次クレジットが付与されます。尺や解像度を上げる前に、参照スチルと固定プロンプトブロックのリハーサルに使いましょう。無料で上限なしの最上位品質は現実的ではありません。クライアントに納期を約束する前に、アプリ内の最新料金と生成あたりのクレジット(例:作成ボタン横の表示)を確認してください。

まとめ

真のキャラクター一貫性は「魔法のプロンプト」の結果ではなく、設計されたワークフローの結果です。PixVerseでは、ワイドから極端なクローズまでアイデンティティを固定するために、画像から動画のパイプラインを譲れない基盤と位置づけています。プロンプトを宝くじのように扱うのではなく、厳格な構造ブループリントとして使ってください。プレビューモードでショットを検証し、マスターキャラクターシートに手を入れる前にカメラの論理を潰すことで、当て推量をなくせます。キャラクター一貫性は賭けになるべきではなく、予測可能でスケールするシステムでなければならないと私たちは考えています。