PixVerse-R1 : Modèle Mondial en Temps Réel de Nouvelle Génération

Nous présentons PixVerse-R1, un modèle mondial en temps réel de nouvelle génération construit sur un modèle fondationnel multimodal natif. Ce système permet la génération vidéo en temps réel où le contenu visuel répond instantanément et fluidement aux entrées utilisateur.

📘 Note de traduction : Cet article a été traduit de la version originale en anglais. Pour les détails techniques les plus précis, veuillez vous référer à la version originale en anglais.

PixVerse-R1 : Modèle Mondial en Temps Réel de Nouvelle Génération

Résumé

Nous présentons PixVerse-R1, un modèle mondial en temps réel de nouvelle génération architecturé sur un modèle fondationnel multimodal natif. Ce système permet la génération vidéo en temps réel où le contenu visuel répond instantanément et fluidement aux entrées utilisateur. En surmontant les contraintes inhérentes de latence et de longueur fixe des flux de travail vidéo traditionnels, PixVerse-R1 transforme la génération vidéo en un flux visuel infini, continu et interactif. Cela représente une évolution significative dans la création, l’expérience et le partage des médias audiovisuels, marquant un changement de paradigme vers des médias intelligents et interactifs capables de s’adapter instantanément en fonction de l’intention de l’utilisateur.

1. Introduction

Le paysage des médias numériques évolue fondamentalement du contenu statique pré-rendu vers des expériences dynamiques et interactives. Les pipelines de production conventionnels ont été historiquement contraints par une latence élevée et des clips de longueur fixe, créant une dichotomie entre la création de contenu et la consommation en temps réel.

Pour répondre à ces limitations, nous introduisons une architecture de modèle mondial novatrice qui unifie un modèle fondationnel multimodal natif, un mécanisme autorégressif de cohérence et un moteur de réponse instantanée. Cette approche unifiée permet le traitement conjoint des patches spatio-temporels avec les données textuelles et audio, éliminant efficacement les silos traditionnels de traitement des médias. En déployant un système capable de streaming infini via un mécanisme autorégressif et un moteur de réponse instantanée, le monde généré reste physiquement cohérent sur de longs horizons avec une faible surcharge computationnelle.

Capacité Clé : En exploitant cette architecture, notre système réalise une percée en performance, générant des vidéos haute résolution jusqu’à 1080P en temps réel. Cette capacité améliore la fidélité visuelle et permet les jeux IA-natifs et le cinéma interactif, où les environnements et les narratifs évoluent dynamiquement en réponse à l’interaction utilisateur. Plus largement, cela permet aux systèmes génératifs de fonctionner comme des mondes persistants et interactifs plutôt que comme des artefacts médiatiques finis, indiquant une trajectoire vers des simulations audiovisuelles continues, avec état et interactives.

2. Architecture Technique

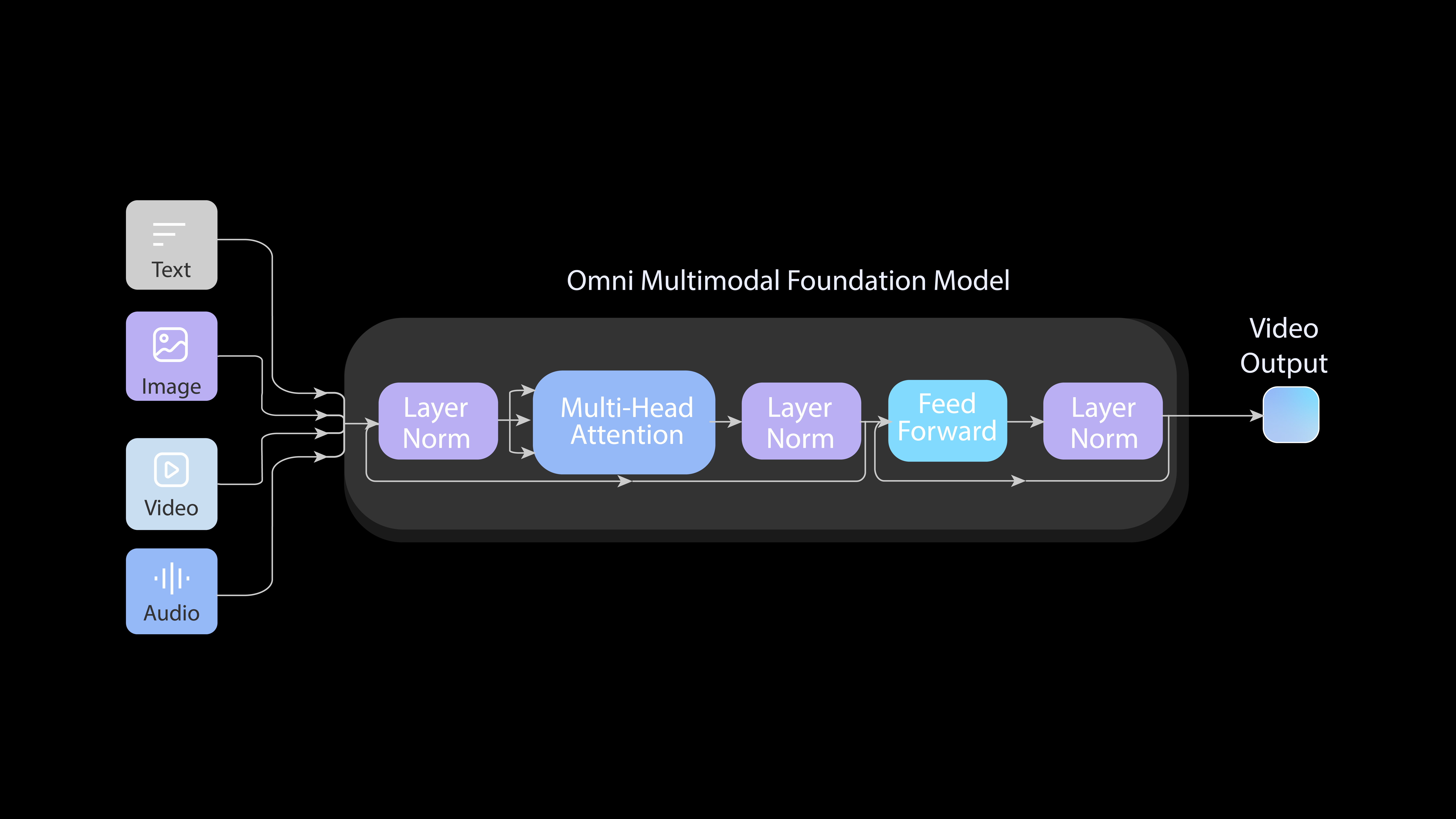

2.1 Omni : Modèle Fondationnel Multimodal Natif

Pour atteindre des capacités générales, nous avons transcendé les pipelines de génération traditionnels en concevant un Modèle Fondationnel Multimodal Natif entièrement end-to-end.

- Représentation Unifiée : Le modèle Omni unifie diverses modalités (texte, image, vidéo, audio) en un flux continu de tokens, lui permettant d’accepter des entrées multimodales arbitraires dans un cadre unique.

- Entraînement End-to-End : L’architecture entière est entraînée sur des tâches hétérogènes sans interfaces intermédiaires, empêchant la propagation d’erreurs et assurant une évolutivité robuste.

- Résolution Native : Nous utilisons l’entraînement en résolution native dans ce cadre pour éviter les artefacts typiquement associés au recadrage ou au redimensionnement.

De plus, le modèle internalise les lois physiques intrinsèques et les dynamiques du monde réel en apprenant d’un corpus massif de données vidéo du monde réel. Cette compréhension fondamentale permet au système de synthétiser un « monde parallèle » cohérent et réactif en temps réel.

Le modèle Omni évolue efficacement, fonctionnant non seulement comme un moteur génératif, mais comme une étape pionnière vers la construction de simulateurs à usage général du monde physique. En traitant la tâche de simulation comme un paradigme de génération end-to-end unique, nous facilitons l’exploration de mondes générés par IA en temps réel et à long terme.

Figure 1. L’architecture end-to-end de notre Modèle Fondationnel Multimodal Natif Omni. La conception unifiée permet à notre modèle Omni d’accepter des entrées multimodales arbitraires et de générer audio et vidéo simultanément.

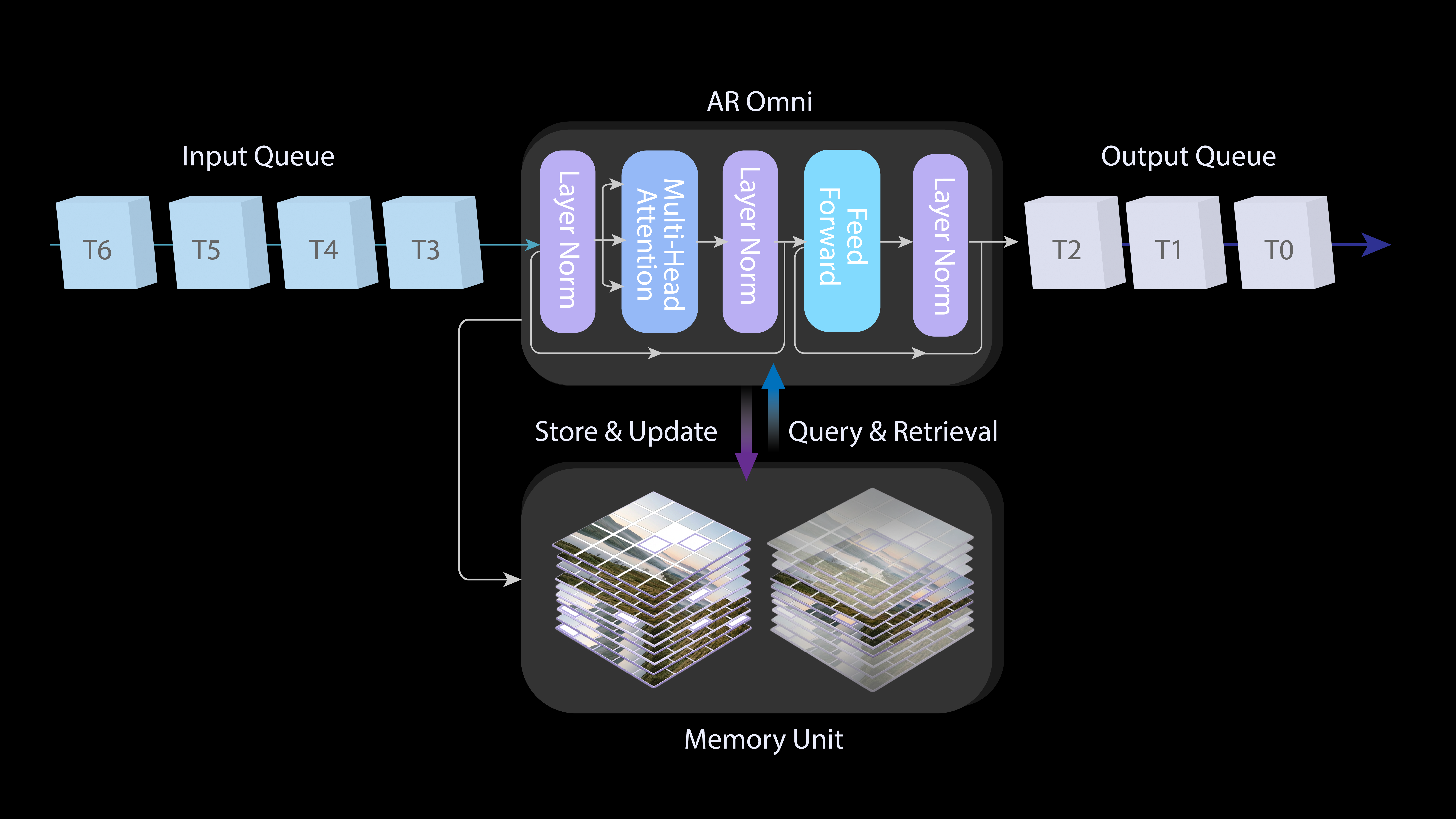

2.2 Memory : Streaming Infini Cohérent via Mécanisme Autorégressif

Contrairement aux méthodes de diffusion standard restreintes aux clips finis, PixVerse-R1 intègre la modélisation autorégressive pour permettre un streaming visuel infini et continu, et incorpore un mécanisme d’attention augmenté par la mémoire pour assurer que le monde généré reste physiquement cohérent sur de longs horizons.

- Streaming Infini : En formulant la synthèse vidéo comme un processus autorégressif, le modèle prédit séquentiellement les frames suivantes pour atteindre un streaming visuel continu et illimité.

- Cohérence Temporelle : Un mécanisme d’attention augmenté par la mémoire conditionne la génération de la frame actuelle sur les représentations latentes du contexte précédent, assurant que le monde reste physiquement cohérent sur de longs horizons.

Figure 2. La modélisation autorégressive intégrée avec le modèle fondationnel Omni.

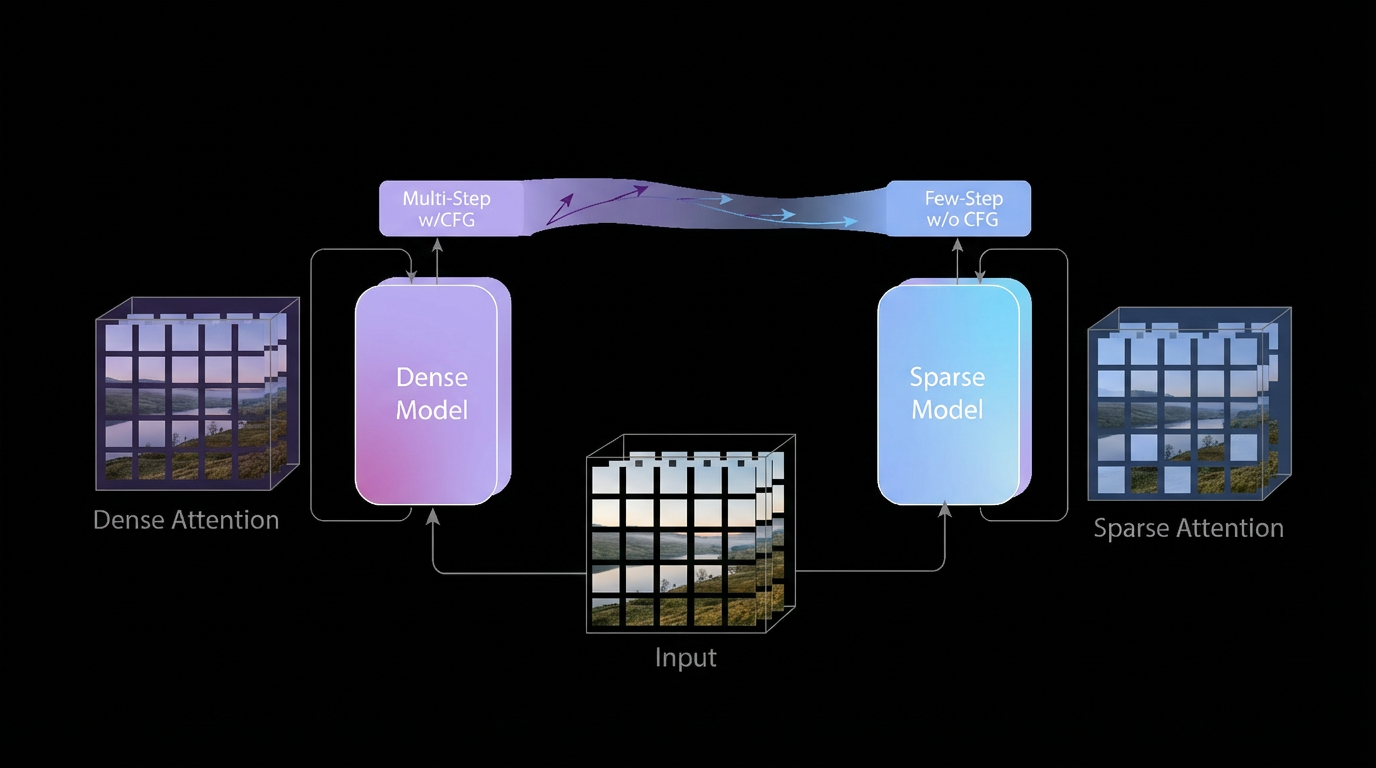

2.3 1080P en Temps Réel : Moteur de Réponse Instantanée

Bien que le débruitage itératif assure typiquement une haute qualité, sa densité computationnelle entrave souvent les performances en temps réel. Pour résoudre cela et atteindre une génération en temps réel à hautes résolutions (jusqu’à 1080P), nous avons ré-architecturé le pipeline en un Moteur de Réponse Instantanée.

L’IRE optimise le processus d’échantillonnage grâce aux avancées suivantes :

- Repliement de Trajectoire Temporelle : En implémentant le Direct Transport Mapping comme prior structurel, le réseau prédit directement la distribution des données propres. Cela réduit les étapes d’échantillonnage de dizaines à seulement 1–4, créant un chemin optimisé essentiel pour une latence ultra-faible.

- Rectification de Guidance : Nous contournons la surcharge d’échantillonnage du Classifier-Free Guidance en fusionnant les gradients conditionnels dans le modèle étudiant.

- Attention Sparse Adaptative : Cela atténue la redondance des dépendances à longue portée, produisant un graphe computationnel condensé qui facilite davantage la réalisation de la génération 1080P en temps réel.

Figure 3. Le moteur de réponse instantanée se compose de trois modules : repliement de trajectoire temporelle, rectification de guidance et apprentissage de l’attention sparse adaptative.

3. Applications et Impact Social

PixVerse-R1 introduit un nouveau médium génératif : des systèmes audiovisuels en temps réel, continus et avec état. Contrairement à la vidéo pré-rendue, ce médium fonctionne comme un processus persistant qui répond instantanément à l’intention de l’utilisateur, où la génération et l’interaction sont étroitement couplées. Ce nouveau médium permet une large classe de systèmes interactifs, incluant mais non limité à :

-

Médias Interactifs

- Jeux IA-natifs et expériences cinématographiques interactives

- VR/XR en temps réel et simulations immersives

-

Systèmes Créatifs et Éducatifs

- Art médiatique adaptatif et installations interactives

- Environnements d’apprentissage et de formation en temps réel

-

Simulation et Planification

- Recherche expérimentale et exploration de scénarios

- Simulations industrielles, agricoles et écologiques

Au-delà des applications spécifiques, PixVerse-R1 fonctionne comme un simulateur de monde audiovisuel continu, réduisant la distance entre l’intention humaine et la réponse du système, et permettant de nouvelles formes de co-création humain-IA dans des environnements numériques persistants.

4. Conclusion

PixVerse-R1 introduit un cadre de génération en temps réel qui surmonte les limitations inhérentes des flux de travail vidéo traditionnels grâce à des innovations architecturales dans le traitement multimodal et la réponse instantanée. En permettant une génération cohérente en temps réel, ce modèle marque une évolution significative dans la création et l’expérience des médias audiovisuels. Le passage à une latence en temps réel permet une transition de la consommation de contenu statique à l’interaction dynamique avec l’environnement, fournissant un substrat computationnel évolutif pour des applications allant des jeux IA-natifs aux simulations industrielles complexes. En comblant le fossé entre l’intention de l’utilisateur et le retour visuel instantané, le système établit une nouvelle frontière pour la modélisation de mondes interactifs et les environnements collaboratifs humain-IA.

5. Limitations

Bien que PixVerse-R1 offre des avantages de modélisation significatifs, deux contraintes principales persistent concernant la précision temporelle et la fidélité physique :

- Accumulation d’Erreur Temporelle : Sur des séquences étendues, de petites erreurs de prédiction peuvent s’accumuler, compromettant potentiellement l’intégrité structurelle de la simulation.

- Compromis Physique vs. Calcul : Pour atteindre avec succès la génération en temps réel, des sacrifices spécifiques ont été faits concernant la complexité de génération. Par conséquent, il peut y avoir un certain degré de perte dans le rendu précis de certaines lois physiques par rapport aux modèles non temps réel.