Personnages cohérents avec l’IA : guide PixVerse V6

Sur PixVerse V6 : images de référence, prompts, multi-shot et image vers vidéo pour des visages stables dans la vidéo IA entre les plans.

L’« IA de personnage cohérent » (consistent character AI) désigne le flux de travail qui maintient des traits du visage, une morphologie et des choix vestimentaires identiques sur plusieurs générations vidéo distinctes. Les modèles vidéo IA n’ont pas de mémoire des clips précédents : chaque génération repart de zéro. Comptent donc les ancres stratégiques plutôt qu’un unique « prompt magique ». Avant de blâmer le modèle, ancrez les générations avec trois piliers : fiches écrites détaillées, images de référence précises et ordre strictement fixe des mots-clés.

Ce que vous apprendrez dans ce guide :

Nous explorons les flux nécessaires à la stabilité du personnage. Contenu :

- Pièges courants : ce qui casse à la génération et comment corriger la dérive.

- Bonnes pratiques de prompt : habitudes et techniques de notation des détails physiques au quotidien.

- L’avantage PixVerse V6 : pain points du secteur face à la réponse de PixVerse V6.

- Workflow PixVerse pas à pas : étapes pour fixer l’identité sur la plateforme.

- Exemples de prompts et analyse : prompts réels avec courtes notes sur le résultat.

- Ressources et modes : crédits et choix des modes de génération.

Comprendre la cohérence des personnages IA : pourquoi la dérive apparaît

La réalité d’une vraie cohérence

En génération vidéo IA, la cohérence signifie que le public reconnaît instantanément le même sujet entre le plan A et le plan B. Les marqueurs d’identité—couleur des cheveux, mâchoire, âge apparent, costume—doivent rester dans une plage strictement reconnaissable. Une petite dérive ressemble à un changement de casting ; une grande dérive casse l’immersion narrative.

Pourquoi les modèles de diffusion échouent au test de cohérence

Les modèles texte vers vidéo reconstruisent le sujet à partir de zéro sur chaque image. Changer d’adjectifs entre prompts ou de modèle en milieu de projet, c’est inviter un inconnu. Le texte seul est l’ancre la plus faible. Pour figer une identité, il faut la force combinée d’images de référence et de blocs de texte répétés avec soin.

Le blueprint avant génération

Avant de lancer la génération, fixez une base : un paragraphe serré pour le visage et les cheveux, une ligne pour la tenue par défaut, une ligne pour la morphologie si nécessaire. Enregistrez dans un fichier de notes dédié. Ce document maître est votre blueprint pour des personnages cohérents avec l’IA. Caméra, lumière et environnement peuvent varier par scène ; ce bloc d’identité ne change pas tant que vous n’écrivez pas volontairement un changement de costume.

Le cadre de prompting pour des personnages IA stables

Avant même d’ouvrir l’interface, il vous faut une discipline de prompt stricte. Les workflows pros s’appuient sur quatre habitudes non négociables pour limiter les hallucinations et garder le contrôle :

-

Prioriser l’identité sur l’action (ordre fixe) : maîtrisez d’abord la description du personnage, puis construisez la scène. Le prompt commence toujours par l’identité du sujet, puis l’action, l’environnement, enfin les paramètres stylistiques ou techniques (angle de caméra, lumière).

-

Verrouillez le vocabulaire : la cohérence exige la même formulation. Si les cheveux sont « châtains foncé mi-longs », ne passez pas à « brune » au clip suivant. L’IA traite ces formulations comme des jetons visuels distincts.

-

Exploitez les prompts négatifs : lorsque l’interface le permet, listez ce qui ne doit pas apparaître : tranche d’âge erronée, interdire « lunettes » si le personnage n’en porte pas, formulations comme « visages dupliqués » pour garder le cadre propre.

-

Construisez et dupliquez des modèles : n’écrivez pas de mémoire. Enregistrez votre prompt le plus stable comme modèle maître, dupliquez-le à chaque job, laissez intact le bloc d’identité central et ne modifiez que les lignes d’action spécifiques à la scène.

Notes de terrain : pourquoi les workflows standards échouent sur la cohérence

Nous avons testé plusieurs piles texte vers vidéo leaders pour voir si elles tenaient un même protagoniste sur plusieurs plans. Malgré le prompt engineering, nous avons heurté les mêmes limites techniques.

Le tableau suivant résume quatre frictions majeures :

| Point de friction | Résultat visuel |

|---|---|

| Plafonds de durée | L’identité se déforme à chaque jonction car il faut coudre de courts clips. |

| Limites texte seul | Sans ancrage visuel, la géométrie du visage (écart des yeux, nez) dérive constamment. |

| Continuité rompue | Passer du large au serré donne l’impression d’un nouvel acteur en tenue similaire. |

| Friction de workflow | Limites de prompt basses et audio déconnecté rendent le récit complexe presque impossible. |

Le tournant : pourquoi nous avons rejoint PixVerse

Il nous fallait moins de « meilleurs prompts » qu’un moteur vidéo plus intelligent. Nous avons développé PixVerse V6 parce que les mêmes goulots d’étranglement revenaient partout dans nos tests. Nous avons conçu un flux où l’identité est intégrée dès le premier plan dans la génération, plutôt que de devoir l’arracher au modèle plan après plan.

Nous avons migré le même projet test vers PixVerse V6. Ci-dessous nous alignons les capacités produit sur chaque problème. Les détails correspondent à notre revue V6 et aux notes produit internes.

-

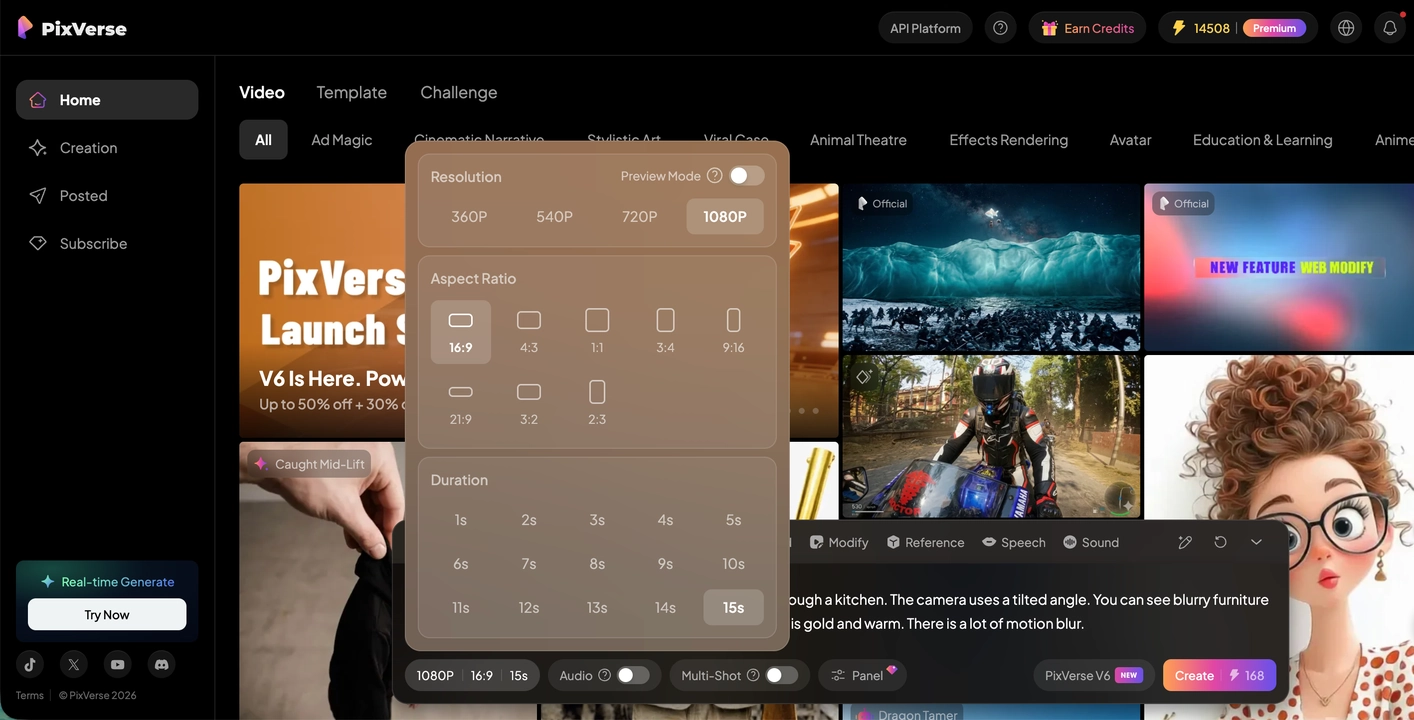

Courts clips et coutures → Une génération peut être plus longue (jusqu’à environ quinze secondes), jusqu’à 1080p, ratios de 16:9 à 9:16. Moins de coupes forcées signifie moins de réinitialisations de rendu et de géométrie faciale entre fichiers.

-

Dérive texte seul → Texte vers vidéo et image vers vidéo partagent le même flux. Le même paragraphe d’identité plus un portrait clair comme image de départ a mieux maintenu le visage que le texte seul.

-

Plans isolés et logique faible entre plans → Le multi-shot intégré permet plusieurs temps ou angles dans un même job quand la scène le demande ; le monde et le costume ne se réinitialisent pas comme avec des exports collés.

-

Prompts trop courts → Un large budget prompt permet bloc personnage et bloc scène dans un seul champ, avec moins d’aller-retour entre notes et interface.

-

Audio séparé de l’image → Audio natif dans le même rendu pour décrire ambiance et jeu en une passe.

-

Récits portés par l’expression → Le modèle est réglé pour un mouvement crédible sur tissu, poids et visages—important quand l’histoire vit en gros plans.

-

Coût d’itération → Le web propose des modes prévisualisation et heures creuses quand nous voulons des passes moins chères avant un rendu complet.

C’est pourquoi les étapes ci-dessous s’articulent autour de PixVerse V6, même si les habitudes des sections précédentes s’appliquent partout.

Générer une vidéo au personnage cohérent avec PixVerse V6

-

Connectez-vous à votre compte PixVerse.

-

Ouvrez la section Vidéo du panneau de création.

-

Sélectionnez PixVerse V6 dans la liste des modèles.

-

Réglez les paramètres : durée, ratio, résolution, audio. Ajustez l’intensité de mouvement si l’interface le propose et que le premier essai est trop violent.

-

Saisissez le prompt — décrivez personnage et scène. Uploadez un portrait comme image de départ pour image vers vidéo si besoin. Utilisez les champs multi-shot s’ils existent ; répéter les mêmes lignes d’apparence aide souvent l’alignement.

-

Cliquez sur Générer et vérifiez le résultat.

Si le texte seul dérive encore sur le visage, une référence claire stabilise souvent mieux que des adjectifs.

Prompts actionnables pour la cohérence des personnages IA (avec vidéos)

Les prompts français ci-dessous correspondent à des runs V6 internes pour jeu et danse. Chaque scénario inclut une vidéo d’exemple.

Gros plan émotionnel à la fenêtre

Prompt:

Une jeune femme se tient près d’une fenêtre, regardant à travers la vitre le monde extérieur. Ses yeux sont légèrement rouges. La caméra avance lentement en travelling. Sa respiration est un peu rapide. Elle se mord la lèvre. Ses yeux brillent de larmes. Son corps tremble d’émotion.

Ce que nous avons vu : l’identité est restée stable quand le même master still menait l’image vers vidéo. Proportion des yeux et mâchoire dans une plage crédible sur deux relances. Sans still, le texte pur adoucit la mâchoire et change le pli des paupières. Mouvement calme ; la qualité dépend surtout de la discipline de référence.

Tristesse avec éventail

Prompt:

Une fille fronce les sourcils, très triste. Des larmes roulent lentement des deux yeux. Elle cache la moitié inférieure du visage avec un éventail pliant ; seuls ses yeux sont visibles.

Ce que nous avons vu : masquer la moitié du visage est un test de stress. Quand la position de l’éventail coïncide entre essais, la région des yeux tient mieux. Changer seulement la couleur de l’éventail dans le prompt déplace légèrement l’ombre sur les joues. Leçon : gardez le même libellé d’accessoire entre les clips s’il sert de repère.

Danse avec fin sur le visage

Prompt:

Caméra en contre-plongée, penchée vers le haut, alors qu’une femme en robe traditionnelle chinoise exécute une danse classique. La caméra passe en gros plan sur son visage. Elle sourit et fait un clin d’œil à l’objectif.

Ce que nous avons vu : grand mouvement de corps plus fin sur le visage : le multi-shot aide ; une génération peut tenir costume et cheveux avant le serré. Nous avons comparé la forme des sourcils avant et après le clin d’œil. Une passe a montré une légère asymétrie ; acceptable pour les réseaux, pas pour une affiche héro.

Générateur de personnages cohérents avec l’IA : place de PixVerse dans la pile

En pratique PixVerse sert de pile pour personnages cohérents car image, vidéo et modèles pilotés par référence partagent un compte. V6 couvre le chemin des clips narratifs ; d’autres modèles sur la même pile font d’autres tâches. On ne choisit pas « la meilleure IA » d’une case : on choisit le mode selon le livrable : d’abord des stills, puis V6 pour le mouvement, puis des modèles vidéo plus riches en référence quand un JPEG ne suffit pas.

FAQ

Qu’est-ce que l’IA de personnage cohérent ?

Tout pipeline qui stabilise l’identité visuelle entre générations, en général texte plus références.

Comment créer des personnages cohérents avec un petit budget ?

Utilisez les crédits quotidiens pour valider référence et texte fixe avant d’augmenter durée ou résolution.

PixVerse V6 est-il le meilleur choix pour tout projet ?

Très solide pour la vidéo courte avec multi-shot et audio. Les pipelines purement statiques peuvent rester dans des outils image. Adaptez l’outil au livrable.

Comment les crédits quotidiens, l’accès gratuit et les tarifs s’inscrivent-ils dans un workflow de personnages cohérents ?

Les nouveaux comptes reçoivent en général des crédits quotidiens à dépenser dans le créateur vidéo. Servez-vous-en pour répéter images de référence et blocs de prompt fixes avant d’augmenter durée ou résolution. Une qualité maximale sans limite à coût zéro n’est pas réaliste. Vérifiez tarifs et coût en crédits dans l’application—par exemple à côté du bouton de génération—avant de vous engager sur des dates client.

Conclusion

Une vraie cohérence de personnage n’est pas le fruit d’un prompt magique, mais d’un workflow conçu. Chez PixVerse, nous considérons le pipeline image vers vidéo comme le socle non négociable pour verrouiller l’identité du large au gros plan extrême. Ne traitez pas les prompts comme des tickets de loterie : utilisez-les comme des blueprints structurels rigides. Validez les plans en mode prévisualisation et corrigez la logique caméra avant de toucher la fiche personnage maîtresse—vous supprimez les conjectures. La cohérence ne doit pas être un pari : ce doit être un système prévisible et scalable.