KI-Charaktere konsistent halten: PixVerse V6 Leitfaden

Mit PixVerse V6 Referenzbilder, Prompts, Multi-Shot und Image-to-Video nutzen, um Gesichter in KI-Videos über Clips hinweg stabil zu halten.

„Consistent Character AI“ bezeichnet den Workflow, identische Gesichtszüge, Körpertypen und Kleidungsentscheidungen über mehrere getrennte Videogenerierungen hinweg zu halten. KI-Videomodelle erinnern sich nicht an frühere Clips und starten jede Generierung neu. Deshalb zählen strategische Anker mehr als ein einziger „magischer Prompt“. Bevor Sie das Modell kritisieren, verankern Sie Generierungen mit drei Kernpunkten: ausführliche schriftliche Charakterblätter, präzise Referenzbilder und eine strikt feste Reihenfolge der Schlüsselwörter.

Was Sie in diesem Leitfaden lernen:

Wir gehen die Workflows durch, die Charakterstabilität erfordern. Inhalt:

- Typische Stolpersteine: Was bei der Generierung bricht und wie Sie Drift beheben.

- Prompt-Best-Practices: Gewohnheiten und Techniken zur Erfassung körperlicher Details, auf die wir uns täglich stützen.

- Der PixVerse-V6-Vorteil: Branchenübliche Pain Points im Vergleich zur Lösung durch PixVerse V6.

- Schritt-für-Schritt auf PixVerse: Konkrete Schritte zur Sicherung der Charakteridentität auf der Plattform.

- Prompt-Beispiele und Analyse: Reale Prompts mit kurzen Output-Notizen.

- Ressourcen und Modi: Credits und Wahl der Generierungsmodi.

KI-Charakterkonsistenz verstehen: Warum Charakter-Drift entsteht

Die Realität echter Konsistenz

In der KI-Videogenerierung bedeutet Konsistenz: Das Publikum erkennt dieselbe Person in Shot A und Shot B sofort wieder. Kernmarker—Haarfarbe, Kieferlinie, Alterseindruck, Kostüm—müssen strikt in einem wiedererkennbaren Rahmen bleiben. Kleiner Drift wirkt wie ein plötzlicher Cast-Wechsel; großer Drift zerstört die narrative Immersion.

Warum Diffusionsmodelle den Konsistenztest nicht bestehen

Text-zu-Video-Diffusionsmodelle bauen das Subjekt in jedem einzelnen Frame neu auf. Wenn Sie Adjektive zwischen Prompts wechseln oder das Modell mitten im Projekt tauschen, laden Sie faktiv eine fremde Person ein. Nur Text ist der schwächste Anker. Um eine Identität zu fixieren, brauchen Sie die stärkere Wirkung von Referenz-Stills plus sorgfältig wiederholte Textblöcke.

Der Blueprint vor der Generierung

Bevor Sie auf Generieren klicken, legen Sie eine Baseline fest: ein kompakter Absatz für Gesicht und Haar, eine Zeile für das Standard-Outfit, eine Zeile für den Körperbau, falls relevant. Speichern Sie das in einer eigenen Notizdatei. Dieses Masterdokument ist Ihr Grund-Blueprint für konsistente KI-Charaktere. Kamera, Licht und Umgebung dürfen pro Szene wechseln; dieser Identitätsblock bleibt unverändert, bis Sie bewusst einen Kostümwechsel ins Drehbuch schreiben.

Das Prompting-Framework für stabile KI-Charaktere

Noch bevor Sie die Oberfläche öffnen, brauchen Sie strenge Prompt-Disziplin. Profi-Workflows stützen sich auf vier nicht verhandelbare Gewohnheiten, um Halluzinationen zu begrenzen und Kontrolle zu behalten:

-

Identität vor Aktion (feste Reihenfolge): Zuerst die Charakterbeschreibung meistern, dann die Szene bauen. Der Prompt beginnt immer mit der Identität des Subjekts, gefolgt von Aktion, Umgebung und zuletzt stilistischen oder technischen Parametern (z. B. Kamerawinkel und Licht).

-

Vokabular festlegen: Konsistenz verlangt identische Formulierungen. Wenn das Haar „schulterlanges Dunkelbraun“ heißt, wechseln Sie im nächsten Clip nicht locker zu „brünett“. Die KI behandelt das als unterschiedliche visuelle Tokens.

-

Negative Prompts nutzen: Wo die UI es erlaubt, explizit listen, was nicht erscheinen darf: falsche Altersbandbreite, keine Brille, wenn die Figur keine trägt, Formulierungen wie „doppelte Gesichter“, um das Bild sauber zu halten.

-

Vorlagen bauen und duplizieren: Schreiben Sie Prompts nicht aus dem Kopf neu. Speichern Sie Ihren stabilsten Prompt als Mastertext, duplizieren Sie ihn pro Job, lassen Sie den Kern-Identitätsblock unangetastet und bearbeiten Sie nur die szenenspezifischen Aktionszeilen.

Feldnotizen: Warum Standard-Workflows bei Charakterkonsistenz scheitern

Wir haben mehrere führende Text-zu-Video-Stacks getestet, ob sie eine Hauptfigur über mehrere Shots halten können. Trotz intensivem Prompt-Engineering stießen wir wiederholt auf dieselben technischen Grenzen.

Die folgende Tabelle fasst vier zentrale Reibungspunkte zusammen:

| Der Pain Point | Das visuelle Ergebnis |

|---|---|

| Dauer-Limits | Identität verzieht sich an jeder Naht, weil kurze Clips zusammengeschnitten werden müssen. |

| Nur-Text-Limits | Ohne visuellen Anker wandert die Gesichtsgeometrie (Augenabstand, Nasenform) ständig. |

| Gebrochene Kontinuität | Vom Weitwinkel zur Nahaufnahme wirkt wie ein neuer Darsteller in ähnlicher Kleidung. |

| Workflow-Reibung | Enge Prompt-Limits und getrenntes Audio machen komplexes Storytelling fast unmöglich. |

Der Wendepunkt: Warum wir zu PixVerse gewechselt sind

Wir brauchten keine „besseren Prompts“, sondern eine intelligentere Video-Engine. Wir haben PixVerse V6 entwickelt, weil uns überall dieselben Engpässe begegneten. Wir bauten einen Workflow, in dem Identität ab dem ersten Frame in die Generierung eingebaut ist—statt sie Shot für Shot aus dem Modell herauszukämpfen.

Wir haben dasselbe Testprojekt nach PixVerse V6 übertragen. Unten ordnen wir Produktfunktionen den obigen Problemen zu. Details entsprechen unserem V6-Review und internen Produktnotizen.

-

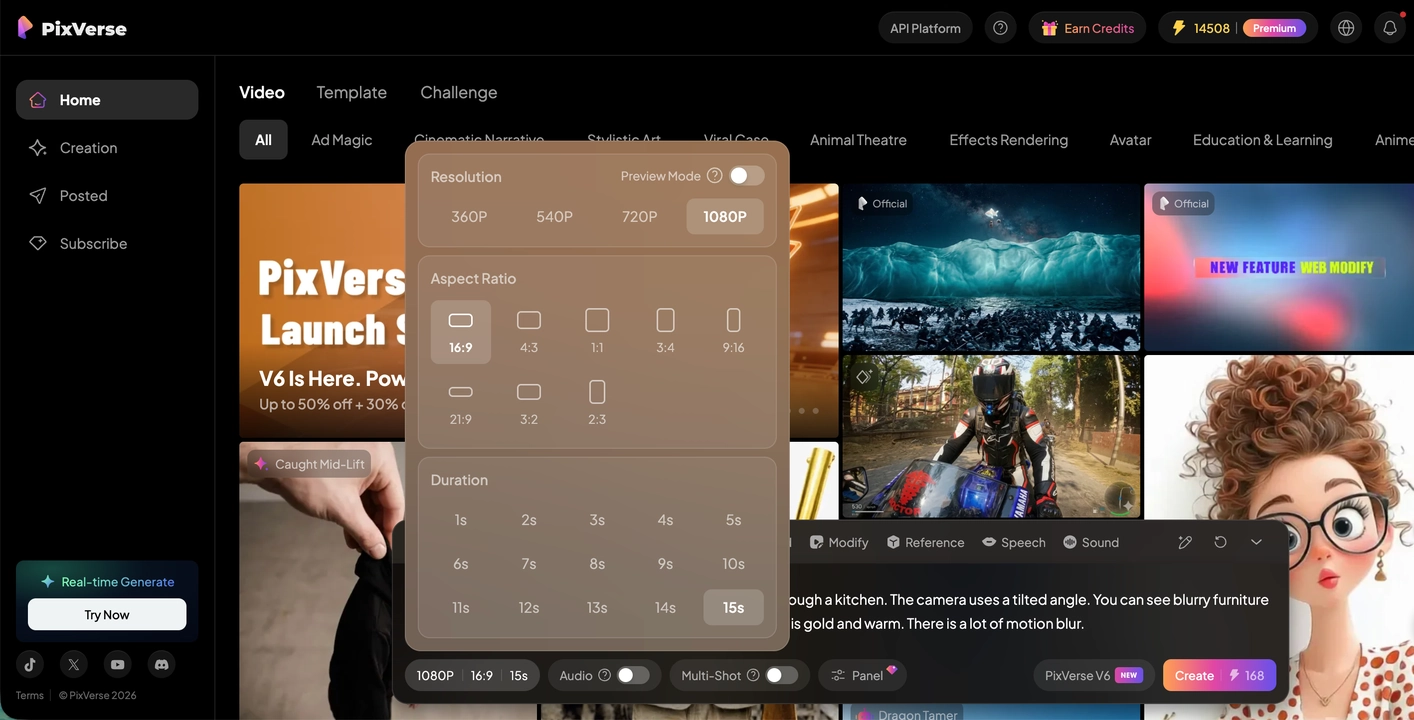

Kurze Clips und Nähte → Eine Generierung kann länger laufen (bis etwa 15 Sekunden), bis zu 1080p, mit gängigen Seitenverhältnissen von 16:9 bis 9:16. Weniger erzwungene Schnitte bedeuten weniger Stellen, an denen Look und Gesichtsgeometrie zwischen Dateien zurückgesetzt werden.

-

Identitäts-Drift nur mit Text → Text-zu-Video und Bild-zu-Video liegen im selben Flow. Derselbe Identitätsabsatz plus ein klares Porträt als Startframe hielt das Gesicht für uns besser im Rahmen als nur Text.

-

Isolierte Takes und schwache Shot-Logik → Integriertes Multi-Shot erlaubt mehrere Beats oder Winkel in einem Job, wenn die Szene mehr als einen Winkel braucht; Welt und Kostüm setzen sich nicht wie bei zusammengeklebten Exports zurück.

-

Zu enge Prompts → Ein großzügiges Prompt-Budget lässt Charakter- und Szeneblock in einem Feld leben mit weniger Hin- und Her zwischen Notiz-App und UI.

-

Audio getrennt vom Bild → Native Audio im selben Render, damit Ambiente und Spiel in einem Durchgang beschrieben werden können.

-

Ausdrucksgetriebene Stories → Das Modell ist auf glaubwürdige Bewegung von Stoff, Gewicht und Gesichtern ausgelegt—wichtig, wenn die Story von Nahaufnahmen getragen wird.

-

Iterationskosten → Die Web-Oberfläche bietet Preview- und Off-Peak-Modi, wenn wir günstigere Läufe vor einem vollen Render wollen.

Deshalb beziehen sich die folgenden Schritte auf PixVerse V6, obwohl die früheren Gewohnheiten überall gelten.

So erzeugen Sie charakterkonsistentes Video mit PixVerse V6

-

Anmelden beim PixVerse-Konto.

-

Video-Bereich im Erstellungspanel öffnen.

-

PixVerse V6 in der Modellliste wählen.

-

Parameter setzen: Dauer, Seitenverhältnis, Auflösung, Audio an/aus. Bewegungsstärke anpassen, wenn die UI es bietet und der erste Take zu wild wirkt.

-

Prompt eingeben — Charakter und Szene beschreiben. Ein passendes Porträt als Startframe für Bild-zu-Video hochladen. Multi-Shot-Felder nutzen, wenn vorhanden; wiederholte Kern-Beschreibungszeilen helfen der Ausrichtung.

-

Generieren klicken und prüfen.

Wenn reiner Text am Gesicht noch driftet, stabilisiert oft ein klares Referenzbild mehr als Adjektiv-Tuning.

Umsetzbare Prompts für KI-Charakterkonsistenz (mit Videoergebnissen)

Die folgenden deutschen Prompts entsprechen internen V6-Läufen für Mimik und Tanz. Pro Szenario gibt es ein Beispielvideo.

Emotionaler Close-up am Fenster

Prompt:

Eine junge Frau steht am Fenster und blickt durch die Scheibe nach draußen. Ihre Augen sind leicht gerötet. Die Kamera fährt langsam ein. Ihr Atem geht etwas schneller. Sie beißt sich auf die Lippe. Ihre Augen glänzen vor Tränen. Ihr Körper zittert vor Emotion.

Was wir sahen: Identität blieb stabil, wenn dasselbe Master-Still Bild-zu-Video anführte. Augenverhältnis und Kiefer blieben über zwei Reruns im plausiblen Rahmen. Ohne Still lieferte reiner Text einen weicheren Kiefer und andere Lidfalte. Bewegung war ruhig; Qualität hing vor allem an Referenzdisziplin, nicht an Motion Blur.

Trauriger Ausdruck mit Fächer

Prompt:

Ein Mädchen runzelt tief betrübt die Stirn. Tränen rollen langsam aus beiden Augen. Sie verbirgt die untere Gesichtshälfte mit einem Faltfächer, nur die Augen sind sichtbar.

Was wir sahen: Halbes Gesicht verdeckt ist ein Stresstest. Wenn die Fächerposition zwischen Versuchen passte, blieb die Augenregion stabiler. Nur Fächerfarbe im Prompt zu ändern, verschob leicht die Wangenschattierung. Merksatz: Accessoire-Formulierungen über Clips identisch halten, wenn das Accessoire ein Erkennungsmerkmal ist.

Tanz mit Gesichts-Finish

Prompt:

Kamera in Untersicht, neigt nach oben, während eine Frau in traditionellem chinesischen Kleid klassischen Tanz vorführt. Die Kamera fährt in eine Nahaufnahme ihres Gesichts. Sie lächelt und zwinkert in die Linse.

Was wir sahen: Große Körperbewegung plus Gesichts-Finish ist Multi-Shot-Terrain: eine Generierung kann Kostüm und Haar über Beats halten. Wir verglichen die Brauenform vor und nach dem Zwinkern. Ein Lauf zeigte leichte Asymmetrie—für Social ok, nicht für Hero-Key-Art.

KI für konsistente Charaktere: Wo PixVerse im Stack sitzt

Praktisch ist PixVerse ein Stack für konsistente Charaktere, weil Bild-, Video- und referenzgeführte Modelle ein Konto teilen. V6 deckt den narrativen Clip-Pfad; andere Modelle auf derselben Plattform andere Aufgaben. Sie wählen nicht per Checkbox „das beste“ Tool, sondern den Modus nach Deliverable: erst Stills, dann V6 für Bewegung, dann referenzstarke Videomodelle, wenn ein JPEG nicht reicht.

FAQ

Was ist konsistente Charakter-KI?

Jede Pipeline, die visuelle Identität über Generationen stabil hält—meist Textblock plus Referenzen.

Wie konsistente Charaktere mit wenig Budget?

Tages-Credits nutzen, um Referenz und festen Text zu prüfen, dann Länge oder Auflösung erhöhen.

Ist PixVerse V6 für jedes Projekt die beste Wahl?

Stark für kurzes Video mit Multi-Shot und Audio. Rein statische Pipelines können in Bild-Tools bleiben. Werkzeug ans Deliverable anpassen.

Wie hängen Tages-Credits, kostenloser Zugang und Preise mit einem konsistenten Charakter-Workflow zusammen?

Neue Konten erhalten in der Regel Tages-Credits für die Videoproduktion. Nutzen Sie sie, um Referenz-Stills und feste Prompt-Blöcke zu üben, bevor Sie Dauer oder Auflösung erhöhen. Spitzenqualität ohne Limit zum Nulltarif ist unrealistisch. Prüfen Sie vor Kundenzusagen die aktuellen Preise und Credit-Kosten in der App—etwa neben der Schaltfläche zum Generieren.

Fazit

Echte Charakterkonsistenz ist kein Zufallsprodukt eines magischen Prompts, sondern ein konstruierter Workflow. Bei PixVerse ist die Image-to-Video-Pipeline für uns die nicht verhandelbare Basis, Identität von Weitwinkel bis extremem Close-up zu sichern. Behandeln Sie Prompts nicht wie Lotterielose, sondern wie starre strukturelle Blueprints. Validieren Sie Shots in Preview-Modi und klären Sie Kamera-Logik, bevor Sie das Master-Charakterblatt anfassen—so eliminieren Sie Rätselraten. Charakterkonsistenz soll kein Glücksspiel sein; sie muss ein vorhersagbares, skalierbares System sein.