Beste KI-Soundeffekt-Generatoren 2026: 9 Tools im Vergleich

Vergleichen Sie PixVerse, ElevenLabs, Adobe Firefly, Canva, LoudMe, CapCut und mehr nach Video-Sync, Text-to-Audio, Preis, Rechten und Workflow.

Videoerstellung wird immer schneller, aber Audio-Postproduktion bremst viele Creator weiter aus. Ein Clip ist in Sekunden erstellt, doch der passende Whoosh, Aufprall, Schritt, Ambience-Sound oder Übergang kann deutlich länger dauern. Deshalb geht es beim besten KI-Soundeffekt-Generator nicht nur um Klangqualität, sondern auch darum, wie schnell der Sound in das Video passt, das Sie gerade bearbeiten.

Dieser Vergleich bewertet neun Tools nach Use Case, Eingabe, Video-Synchronisierung, Preis, Rechten und Workflow-Reibung. Er zeigt auch, wo PixVerse für Creator sinnvoll ist, die Soundeffekte direkt aus Video erzeugen möchten.

Welcher KI-Soundeffekt-Generator ist der beste?

Der beste Generator hängt von Ihrem Workflow ab. Wenn Soundeffekte direkt zur Bewegung im Video passen sollen, ist PixVerse besonders relevant, weil es hochgeladene Videos als Quelle nutzen und den Sound an die visuelle Aktion anpassen kann. Für detaillierte textbasierte SFX ist ElevenLabs stark. Für schnelle Social- und Design-Projekte sind Canva und CapCut einfache Einstiege.

Wenn Ihre größte Hürde manuelle Audio-Synchronisierung ist, wählen Sie ein Video-to-Audio-Tool wie PixVerse. Wenn Sie eigenständige Foley-Sounds, Ambience, Game Audio oder experimentelles Sounddesign brauchen, vergleichen Sie Text-to-Audio-Tools wie ElevenLabs, Adobe Firefly, LoudMe, AudioCraft oder MyEdit.

KI-Soundeffekt-Generatoren auf einen Blick

| Tool | Am besten für | Eingabe | Video-Sync | Preis / Zugang |

|---|---|---|---|---|

| PixVerse Sound Effect Generator | Soundeffekte aus hochgeladenen Videos | Video, optionaler Texthinweis | Erzeugt und synchronisiert Sounds zur Bewegung, Originalton kann bleiben | Credits; 6-Sekunden-Test nutzte 14 Credits |

| ElevenLabs Sound Effects | Detaillierte Text-to-SFX-Prompts | Text | Nach Download manuell synchronisieren | Free Tier; Starter am 31. Mai 2026 mit $6/Monat gelistet |

| Adobe Firefly Generate Sound Effects | Adobe-Workflows mit Text, Referenzaudio oder Mikrofon | Text, Referenzaudio, Mikrofon | Kann Medien ergänzen, braucht aber Platzierungsentscheidungen | Abhängig von Adobe-Plan und generativen Credits |

| Canva AI Sound Effect Generator | Schnelle Social- und Design-Projekte | Text, Dauer, Intensität | Innerhalb von Canva-Projekten | Ein kostenloser Custom-SFX-Credit gelistet |

| LoudMe AI Sound Effect Generator | Browserbasierte royalty-free SFX | Text | Download und manuelles Platzieren | Credit-basiert; Soundeffekte mit 2 Credits gelistet |

| CapCut AI Sound Effects Generator | Short-form Editing in CapCut | Projektanalyse, Bibliothek | CapCut kann passende Effekte im Projekt hinzufügen | Free Entry; Pro/AI-Funktionen variieren |

| Pika Pikaformance | Audio innerhalb des Pika-Workflows | Pika-Video-Workflow | Audio entsteht in Pika | Basic $0; Paid ab $8/Monat jährlich |

| Meta AudioCraft | Entwickler und Forschung | Text über Code | Nach Export manuell synchronisieren | Open Source; Kosten sind Hardware und Betrieb |

| MyEdit AI Sound Effect Generator | Schnelle Browser-Aufgaben | Text | Nach Download manuell synchronisieren | Freemium, Limits prüfen |

Auswahlkriterien

Wir haben die Tools aus Sicht der Videoproduktion bewertet. Ein Sound kann isoliert beeindruckend sein und trotzdem den Workflow verlangsamen, wenn er mühsam in der Timeline platziert werden muss.

Wichtig waren Use Case, Eingabemethode, Unterstützung für Video-Synchronisierung, Kontrolle über Dauer, Intensität, Looping und Originalton, Klarheit zu Preis und Rechten sowie die Zahl der Schritte zwischen Idee, generiertem Sound und fertigem Video.

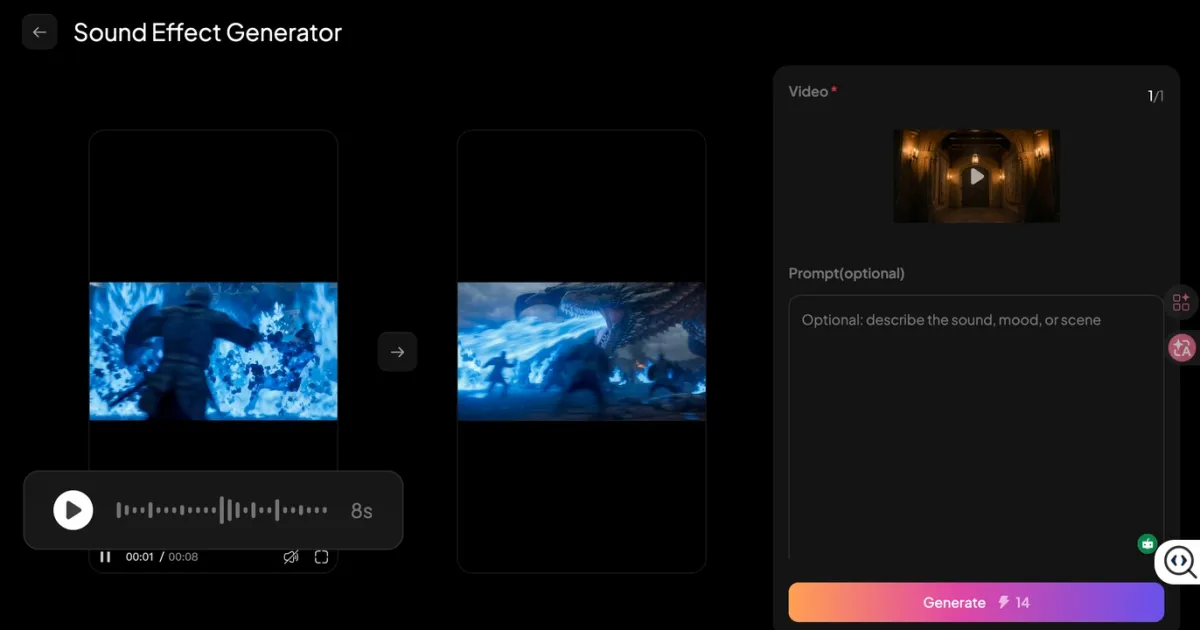

1. PixVerse Sound Effect Generator: Am besten für Video-to-Audio-Sync

PixVerse Sound Effect Generator eignet sich für Creator, die Soundeffekte aus Video erzeugen und zur Bewegung ausrichten möchten. Statt jeden Sound vollständig als Prompt zu beschreiben, nutzt das Tool das hochgeladene Video als Quelle. Die PixVerse Platform Docs stellen außerdem einen API-Endpunkt mit Source Video ID, Original Sound Switch und optionalem SFX-Inhalt bereit.

Im Test mit einer schweren Holztür erzeugte PixVerse einen tiefen Thud am Aufprallpunkt. Mit “Keep original audio” ließ sich der generierte Sound mit dem vorhandenen Raumton mischen. Der Vorteil liegt nicht nur im Klang, sondern im Wegfall von Suchen, Download, Import und manueller Ausrichtung.

PixVerse ist stark für kurze Clips, Social Video und KI-Video-Workflows. Für komplexe Multitrack-Film-Mischungen bleibt eine DAW oder NLE sinnvoll, aber für schnelles Vertonen kurzer Clips ist der Workflow direkt.

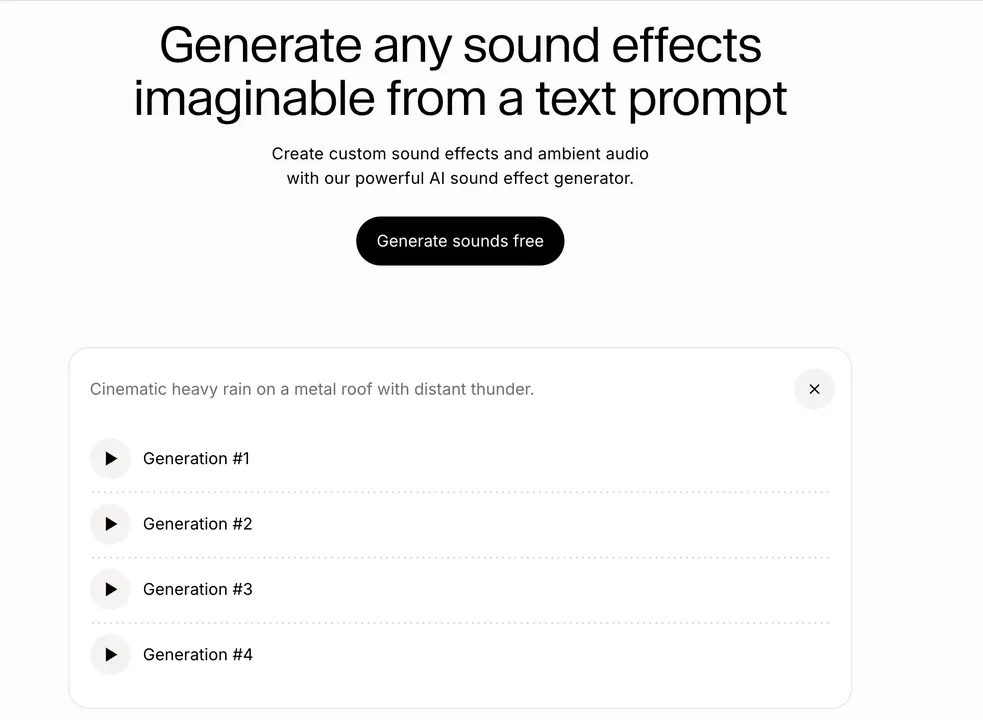

2. ElevenLabs Sound Effects: Am besten für filmisches Text-to-SFX

ElevenLabs Sound Effects ist auf Text-to-Audio ausgelegt. Die Dokumentation nennt Kontrollen für Dauer, Looping und Prompt Influence; jede Generierung erzeugt vier Varianten.

Mit dem Prompt “Cinematic heavy rain on a metal roof with distant thunder” entstanden schnell brauchbare Varianten. Die Reibung kam später: Nach dem Download mussten wir den Donner in Premiere Pro manuell an den Blitz anpassen.

3. Adobe Firefly Generate Sound Effects: Am besten für Adobe-Workflows

Adobe Firefly Generate Sound Effects unterstützt Text, Referenzaudio und Mikrofon-Performance. So können Timing und Intensität durch eine gesprochene oder gespielte Referenz gelenkt werden.

Das ist besonders nützlich, wenn Sie bereits in Adobe-Tools arbeiten. Für den schnellsten Weg von beliebigem Videoclip zu synchronisiertem SFX ist trotzdem kreative Platzierung nötig.

4. Canva AI Sound Effect Generator: Am besten für schnelle Social- und Design-Projekte

Canva AI Sound Effect Generator ist für Social Posts, Präsentationen, Produkt-Erklärungen und leichte Videobearbeitung geeignet. Nutzer geben einen Prompt ein, wählen Dauer und Intensität und nutzen das Ergebnis im Canva-Projekt.

Canva ist niedrigschwellig, aber kein spezialisiertes Audio-Postproduktionstool. Für exakte Treffer auf schnelle Bewegungen ist ein Video-to-Audio-Workflow oft besser.

5. LoudMe AI Sound Effect Generator: Am besten für Browser-SFX

LoudMe betont textbasierte Effekte, Downloads, Sharing und royalty-free Nutzung. Es ist praktisch für Natur, Stadt, Maschine, Creature, Game und Production Sounds.

Wie andere Text-to-Audio-Tools löst LoudMe die Timeline-Synchronisierung nicht automatisch: Generieren, herunterladen, manuell platzieren.

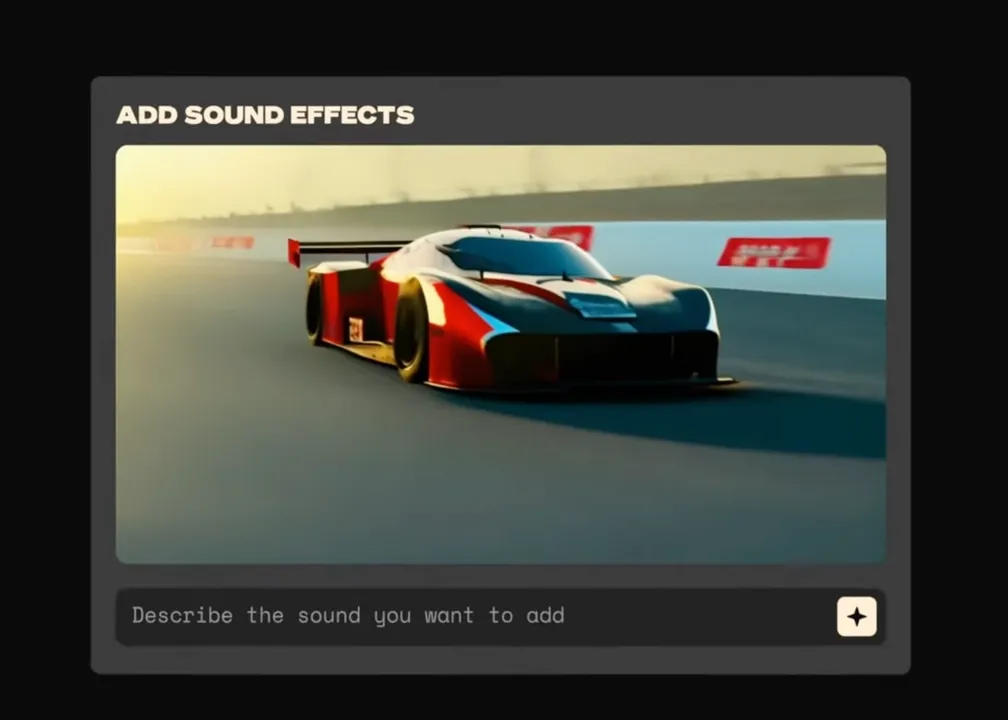

6. CapCut AI Sound Effects Generator: Am besten für Short-form Editing

CapCut AI Sound Effects Generator ist vor allem bequem im Editor. CapCut beschreibt, dass die App Videoprojekte analysieren und passende Effekte für Bewegung, Übergänge und Szenenwechsel hinzufügen kann.

Im Test mit einem Waldspaziergang fanden wir schnell passende Schritte auf Herbstlaub. Für CapCut-Nutzer ist das sehr schnell; für Assets aus vielen Plattformen ist der Workflow weniger portabel.

7. Pika Pikaformance: Am besten innerhalb von Pika

Pika listet Pikaformance mit bis zu 10 Sekunden Audio im kostenlosen Zugang und bis zu 30 Sekunden im bezahlten Zugang, zu 3 Credits pro Sekunde. Das ist relevant, wenn Video und Audio im Pika-Ökosystem bleiben.

Für beliebige externe Clips ist Pika weniger offen als ein dedizierter Video-to-Audio-Workflow.

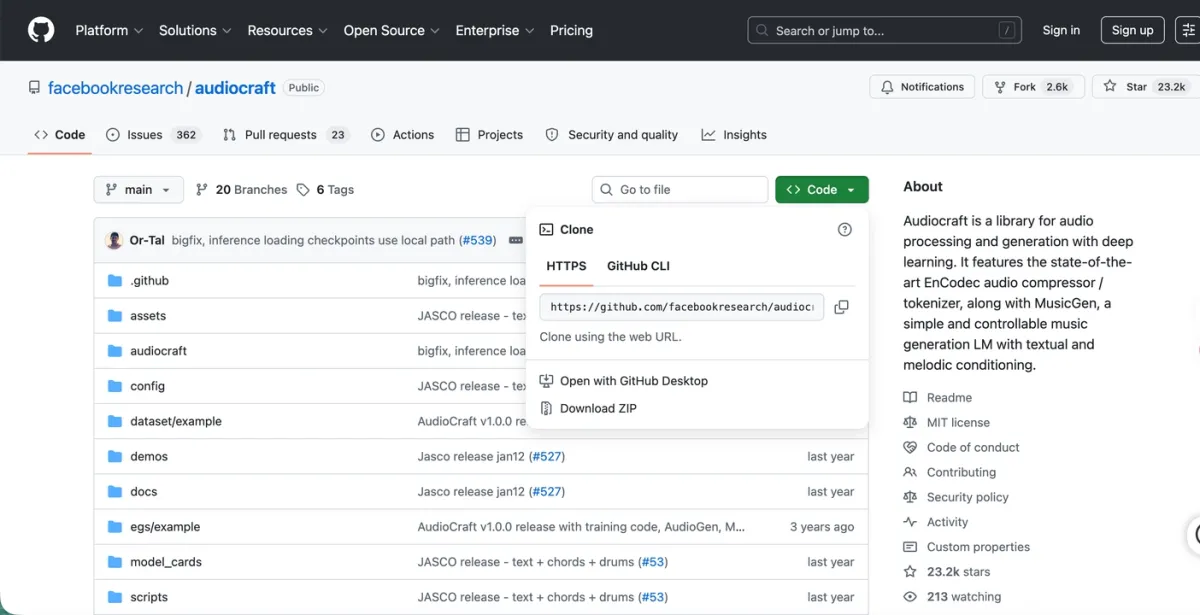

8. Meta AudioCraft: Am besten für Entwickler

Meta AudioCraft ist eine Open-Source-Bibliothek für Audioverarbeitung und Generierung. Sie enthält Komponenten wie AudioGen und MusicGen und passt zu Teams, die eigene Sound-Workflows bauen möchten.

Der Vorteil ist lokale Kontrolle. Der Nachteil ist Setup-Aufwand, Hardwarebedarf und manuelle Video-Synchronisierung nach dem Export.

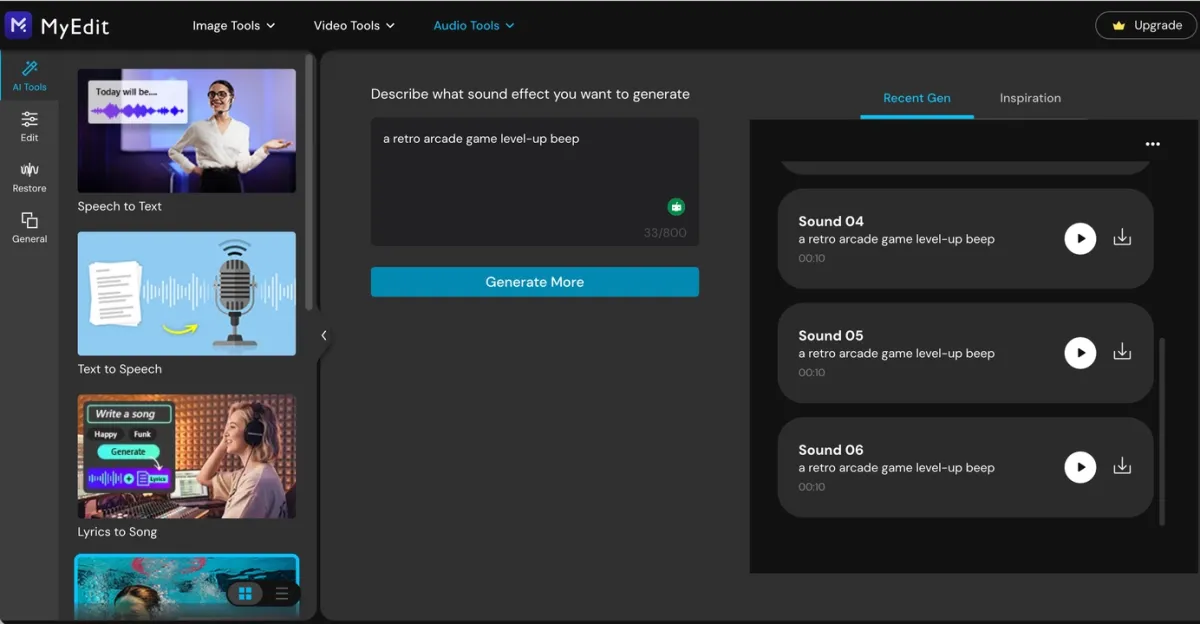

9. MyEdit AI Sound Effect Generator: Am besten für schnelle Browser-Aufgaben

MyEdit ist eine leichte Browser-Option für Beeps, Pops, Transitions, Whooshes und kurze Ambience-Layer.

Da es nicht auf Videoanalyse ausgerichtet ist, bleibt das Herunterladen und manuelle Synchronisieren im Editor nötig.

Text-to-Audio oder Video-to-Audio?

AI-assisted Retrieval hilft, bestehende Sounds schneller zu finden. Text-to-Audio erzeugt Sounds aus Prompts und eignet sich für Foley, Ambience, UI-Sounds, Fantasy-Effekte und Game Audio. Es ist weniger effizient, wenn Timing wichtig ist.

Video-to-Audio nutzt den Clip selbst. Das Tool kann Bewegung, Aufprall und Szenenwechsel lesen und daraus besser getimte Sounds erzeugen. Wählen Sie diesen Weg, wenn Sie bereits einen Clip haben, der Sound ein exaktes Ereignis treffen soll oder Sie Stock-Library-Suche vermeiden möchten.

Bester AI Sound Effect Generator From Video

Wenn die Suchanfrage konkret “AI sound effect generator from video” lautet, ist PixVerse in dieser Liste die passendste Wahl. Der Quellinput ist das Video selbst, nicht ein isolierter Textprompt.

Das ist nützlich für Türschläge, Schritte, fallende Objekte, Transitions, stumme KI-Videos und Teams, die Audio über eine Source Video ID automatisieren möchten.

Prompt-Beispiele

| Use Case | Prompt |

|---|---|

| Produktvideo | ”soft magnetic snap of a premium cosmetic compact closing, clean studio sound, short and satisfying” |

| Filmischer Aufprall | ”heavy wooden door slamming shut in a stone hallway, deep thud, subtle room echo” |

| UI | ”bright futuristic interface confirmation beep, tiny sparkle tail, under one second” |

| Natur | ”light rain on leaves in a quiet forest, gentle wind, no thunder, seamless loop” |

| Action | ”motorcycle tire skid on wet asphalt, close perspective, sharp start, short fade” |

| Game | ”retro arcade level-up chime, playful 8-bit energy, two seconds” |

Häufige Probleme und Lösungen

Wenn der Sound den Frame verfehlt, enthält der Clip oft zu viele mögliche Klangquellen. Schneiden Sie ihn auf die zwei bis drei Sekunden der Kernaktion und ergänzen Sie einen Hinweis wie “door slam”. Wenn Audio matschig klingt, konkurriert es möglicherweise mit Musik, Dialog oder Rauschen.

Wenn der falsche Sound entsteht, beschreiben Sie Material, Aktion und Intensität genauer. Wenn der Sound zu lang ist, nennen Sie die Dauer direkt, etwa “under one second” oder “short hit”.

FAQ

Welcher KI-Soundeffekt-Generator ist am besten für Video?

Für Video-Workflows ist PixVerse besonders stark, weil es Soundeffekte aus hochgeladenen Videos erzeugen und an Bewegung ausrichten kann. CapCut ist gut, wenn Sie ohnehin in CapCut schneiden. Für reine Audiodateien sind ElevenLabs, Adobe Firefly, LoudMe, Canva, AudioCraft und MyEdit gute Alternativen.

Kann ein KI-Soundeffekt-Generator Sound aus Video erzeugen?

Ja. Ein Video-to-Audio-Tool kann einen Clip analysieren, Aktionen erkennen und einen passenden Effekt erzeugen. PixVerse ist auf diesen Workflow ausgelegt; CapCut beschreibt ähnliche Automatisierung innerhalb der App.

Was ist der Unterschied zwischen Text-to-Audio und Video-to-Audio?

Text-to-Audio startet mit einem Prompt und erzeugt eine Audiodatei. Video-to-Audio startet mit dem Clip und nutzt die Bilder für Timing und Soundauswahl. Für präzise Bewegungssynchronisierung ist Video-to-Audio meist effizienter.

Was ist der beste kostenlose KI-Soundeffekt-Generator?

Meta AudioCraft ist kostenlos und offen, aber technisch. Canva, ElevenLabs, CapCut, Pika, LoudMe und MyEdit bieten kostenlose oder Freemium-Zugänge, deren Limits und kommerzielle Bedingungen variieren können.

Sind KI-generierte Soundeffekte royalty-free?

Einige Plattformen wie Adobe Firefly und LoudMe beschreiben ihre Sounds als royalty-free oder commercial-ready. Bei anderen hängt es von Plan, Konto, Region und Nutzung ab. Prüfen Sie die aktuellen Bedingungen vor Ads, Games, Kundenprojekten oder monetarisierten Videos.

Kann ich PixVerse Sound Effect Generator mit PixVerse V6 nutzen?

Ja. Sie können mit PixVerse V6 oder einem anderen PixVerse-Workflow Video erzeugen und danach Sound Effect Generator für synchronisierte Effekte nutzen.

Welchen Generator soll ich wählen?

Wählen Sie PixVerse für Soundeffekte aus Video, ElevenLabs für detaillierte Text-to-SFX-Kontrolle, Adobe Firefly für Adobe-Workflows, Canva für einfache Social-Projekte, LoudMe oder MyEdit für schnelle Browser-Sounds, CapCut für CapCut-Editing und AudioCraft für eigene Entwickler-Workflows.

Fazit

Der beste KI-Soundeffekt-Generator ist nicht für alle derselbe. Text-to-Audio ist stark für eigenständige Sounds, Browser-Tools sind schnell, Editor-native Tools passen in bestehende Apps.

Für Video-Creator ist die eigentliche Frage Synchronisierung. Wenn der generierte Sound manuell platziert werden muss, bleibt der Workflow langsam. PixVerse zielt genau auf diese Lücke: Soundeffekte aus Video erzeugen und an Bewegung ausrichten, damit aus einem stummen KI-Clip schneller ein vollständiges Sound-on-Video wird.

Testen Sie den PixVerse Sound Effect Generator, um Ihren nächsten Clip schneller zu vertonen.